Artículos

CorsiBot: Interfaz automática para la evaluación de la memoria de trabajo

CorsiBot: Automatic interface for working memory assessment

CorsiBot: Interfaz automática para la evaluación de la memoria de trabajo

Interdisciplinaria, vol. 40, núm. 3, pp. 17-18, 2023

Centro Interamericano de Investigaciones Psicológicas y Ciencias Afines

Recepción: 06 Septiembre 2021

Aprobación: 02 Mayo 2022

Resumen: La prueba de Bloques de Corsi es utilizada en Psicología y ciencias cognitivas para evaluar la memoria de trabajo visoespacial. La versión original era administrada por un/a investigador/a manualmente, lo cual podía facilitar la comisión de errores de evaluación, así como generar dificultades para reproducir la experiencia de manera precisa. A partir de ello, se desarrollaron diversas versiones digitales que usaban computadoras o tabletas, lo cual generó debates respecto de las posibles diferencias diagnósticas entre dichas versiones digitales y las mismas pruebas en versiones manuales. En este trabajo, se presenta el desarrollo del CorsiBot, una versión manual y automatizada que permite estudiar el desempeño y las estrategias de resolución de la prueba Bloques de Corsi. El trabajo tuvo como objetivo la comparación del desempeño de participantes adultos en una versión digital de la tarea de Corsi y el CorsiBot, así como comparar la experiencia subjetiva de los/as participantes al utilizar cada versión. El dispositivo se ha probado en una muestra de personas adultas con quienes se pudieron verificar similitudes y diferencias con una versión digital. En particular, los participantes obtuvieron una proporción similar de ensayos correctos en cada versión de Corsi, pero mostraron diferencias en los tipos de errores cometidos.

Palabras clave: automatización y captura con embebidos, interfaz humano-computadora, experiencia de usuario, Bloques de Corsi, memoria de trabajo.

Abstract: Nowadays some debates exist within psychological and neuropsychological assessment fields respecting differences between traditional testing (with pencil and paper) and the same tasks implemented via computer or Tablet programs. In this context, the Mode Effect is defined as the effect by which the same tasks, tested with different devices, may show different results. In addition, the Mode Effect might be associated with higher cognitive load, higher attentional requirements, fatigue and stress among others. The Corsi block-tapping test is widely used in psychology and cognitive sciences to assess visuospatial working memory. Originally, the stimuli sequence was manually set by a researcher which could entail a constraint to run the test accurately. Today, there are many digital versions available for computers or tablets and, although this meant a significant cut on manual steps, there are discussions on the impact these digital versions could have on working memory as opposed to traditional ones. This work focuses on the development of the CorsiBot: a new physical and automated version that enables researchers to assess performance and resolution strategies for the Corsi block-tapping test while combining the benefits of both tangible and digital versions. In addition, this work aimed to compare the performance of a sample of adults between a digital version of Corsi and our CorsiBot. Thirty adults where assessed with both devices with different protocols. After each assessment, participants completed the NASA-TLX questionnaire in order to explore the cognitive load required by each device. Results showed similarities and differences between each device. Specifically, participants showed a similar proportion of correct trials, while showing different types of errors for each version of Corsi. Such differences were related to path errors, where response sequence contains the correct blocks but pressed in an incorrect order. Analyses showed that SoftCorsi was more sensitive to those kind of errors. With respect to cognitive load, participants reported that CorsiBot elicited larger mental exigency than SoftCorsi. The present work aims make a relevant contribution to research and clinical teams interested in the assessment of spatial working memory. This work contributes theoretically with evidence on the behavior of memory under different processing contexts. In addition, it has practical implications related to diagnostic issues on the identification of individual differences under distinct assessment modes. Finally, the device showed effectiveness in the assessment and record of responses that permitted exporting, analyzing and visualizing the results. Schemes and source codes of the devices are openly available for free use for any interested research group or institution.

Keywords: automation and input capture in an embedded system, human-computer interface, user experience, Corsi block-tapping test, working memory.

Introducción

El mundo vive uno de los cambios tecnológicos más importantes de la historia: las tecnologías de la información y la comunicación (TICs), que ya se hicieron lugar en la vida cotidiana. En este contexto, diversas tareas manuales empezaron a ser asistidas, e incluso realizadas completamente, por computadoras. En particular, las investigaciones sobre el funcionamiento de la mente humana han podido capturar eventos antes imposibles de registrar (Dotan et al., 2019).

La prueba de Bloques de Corsi es utilizada en Psicología y Ciencias Cognitivas para evaluar la memoria de trabajo espacial (Pickering, 2001). Esta consiste en la presentación de una serie de estímulos visuales en un determinado orden que deben ser recordados y repetidos en el mismo orden por las personas evaluadas. La versión original del test estaba construida con nueve cubos de madera visualmente iguales y era un/a investigador/a (a partir de aquí, un investigador) quien señalaba con una varilla los bloques, para seguir un protocolo previamente definido. Cada ensayo estaba definido con dos partes: 1) el investigador señalaba, en un orden preestablecido, una secuencia de bloques y al terminar daba paso a que, 2) el/la participante (a partir de aquí, el participante) intentara repetir la misma secuencia que le fue mostrada. Mientras esto sucedía, el investigador registraba manualmente el desempeño y anotaba errores, tiempos y aciertos.

Desarrollos posteriores de los Bloques de Corsi incluyeron luces con pulsadores mediante los cuales el investigador iluminaba los cubos en lugar de tener que indicarlos con una varilla o con la mano. Sin embargo, la tarea de registro de las respuestas continuó de manera manual. Estos procesos de administración de la tarea y del registro manual del desempeño por parte de los investigadores implicó que hubiera reiteradas dificultades (errores de anotación, confusión de protocolos, etcétera) y la imposibilidad de reproducir la experiencia de manera precisa (distintos tiempos de exposición de estímulos, errores en la administración, etcétera) (Robinson y Brewer, 2016).

Para tratar de sortear esas dificultades, se han desarrollado diversas versiones digitales de la prueba de Bloques de Corsi administradas mediante computadoras o tabletas (Brunetti et al., 2014; Robinson y Brewer, 2016). De esta manera, es el software el que se encarga de reproducir las secuencias, registrar las respuestas de las personas evaluadas y determinar el avance en la prueba o su finalización mediante su configuración previa.

El uso de estas versiones, si bien ha significado un gran avance para reducir la cantidad de procesos manuales por parte de los investigadores, presenta un debate respecto a cómo impacta en la memoria de trabajo el uso de versiones digitales mediante dispositivos con pantalla, respecto de las mismas pruebas en versiones físicas (Carpenter y Alloway, 2019;Leeson, 2006).

En este trabajo se propuso construir un dispositivo físico y automatizado para la administración y registro de las pruebas, que permita estudiar el desempeño y las estrategias de resolución sin pantalla del test Bloques de Corsi. Esto es posible mediante la incorporación de una computadora embebida para la automatización de los procesos relacionados con el tablero de luces y pulsadores.

Con este nuevo dispositivo de Corsi se espera recuperar el aspecto motriz-espacial de la tarea original, pero con los beneficios de reproducir las secuencias de manera idéntica y de tener un registro con gran precisión de los eventos observables y, así, reducir el sesgo y los errores humanos en la administración. El desarrollo del dispositivo es público y de acceso libre para su construcción y uso. Se espera, de esta manera, dotar a diversos grupos de investigación de un dispositivo confiable.

Debates entre lo analógico y lo digital

Actualmente, existen algunos debates en torno a las equivalencias o diferencias entre los diferentes test realizados de una forma tradicional –con lápiz y papel– y las mismas pruebas realizadas mediante computadoras o tabletas. Así, el Mode Effect es definido como el efecto por el cual idénticas pruebas, evaluadas sobre diferentes dispositivos, pueden producir distintos resultados (Clariana y Wallace, 2002; Leeson, 2006).

Wastlund et al. (2005) realizaron experimentos para comparar la lectura y comprensión de textos en papel y pantallas. Las pruebas consistían en leer un texto, desde una pantalla o desde un material impreso en papel, y responder preguntas para verificar la comprensión del texto. En su estudio concluyen que los test presentados a través de una pantalla mostraron un menor rendimiento respecto a la versión en papel. A su vez, las primeras generaron un mayor estrés y cansancio en las personas participantes. De manera similar, Mayes y colegas (2001) realizaron experimentos para comparar la lectura de textos y encontraron casos en que los tiempos de lectura eran menores según los modos de presentación, aunque con desempeños más bajos en la comprensión de los textos en el caso de las versiones de pantalla. Por otra parte, Clariana y Wallace (2002) introducen a la familiaridad previa que las personas tengan con estos dispositivos un factor fundamental para el desempeño en los test realizados en computadora. Sin embargo, otros estudios no encontraron evidencias suficientes para afirmar una correlación entre ambos factores (Taylor et al., 1999; Yu, 2010).

En cuanto a la memoria de trabajo visoespacial, Carpenter y Alloway (2019) realizaron un trabajo empírico de relevancia en el que analizaron el desempeño de niños de entre 4 y 11 años en tareas con demanda de distintos tipos de memoria de trabajo y de corto plazo (verbal y no verbal). Dicho estudio comparó el desempeño en estas tareas respecto de una modalidad de evaluación manual, con lápiz y papel, y una modalidad de evaluación digital, con una computadora. Así, concluyeron que las tareas evaluadas con un soporte físico tuvieron un mejor rendimiento que aquellas proporcionadas mediante computadora. Las autoras plantean que las tareas en formato digital podrían haber mostrado menores valores de desempeño debido a factores tales como: una mayor carga cognitiva, diferencias en el uso de computadoras, el nivel socioeconómico, los mayores requerimientos atencionales y la fatiga por el uso de computadoras entre otros. Los estudios revisados dejan en evidencia la necesidad de seguir evaluando similitudes y diferencias de los distintos test realizados sobre diferentes plataformas para analizar el impacto del Mode Effect.

La tarea de Bloques de Corsi

La memoria de trabajo es definida como un sistema de capacidad limitada, dedicado al mantenimiento y procesamiento de la información para el sostenimiento de la cognición y la acción (Baddeley et al., 2020). El modelo multicomponente es el modelo de uso más extendido en la literatura actual y estaría integrado por, al menos, cuatro componentes principales. Por un lado, hay un componente ejecutivo central, encargado de guiar la atención y los recursos cognitivos hacia la información relevante y el uso de estrategias para la codificación, el almacenamiento y el recuerdo de la información. Vinculado a este componente, se encontraría el búfer episódico, que permitiría la asociación de información de distintas fuentes con la memoria de largo plazo. Finalmente, el modelo incluye un componente involucrado en el procesamiento verbal (el bucle fonológico) y otro involucrado en el procesamiento visoespacial (la agenda visoespacial) (Baddeley et al., 2020). Este último componente se asociaría a la puesta en funcionamiento de la llamada memoria de trabajo visoespacial, la cual se encargaría de mantener la información de este tipo en la memoria y procesarla más allá de la fuente del estímulo. La literatura resalta, además, la importancia de diferenciar entre dos tipos de actividades de la memoria de trabajo visoespacial: el procesamiento visual de colores, formas y texturas, y el procesamiento espacial referido a la identificación de la distancia, tamaño y posición de objetos y representaciones mentales.

La tarea de Bloques de Corsi (Pickering, 2001), mencionada anteriormente, requiere la utilización de procesos de memoria de trabajo espacial mediante el compromiso de procesos ejecutivos y atencionales para la representación y el mantenimiento de la información (Patt et al., 2014). Los parámetros de dificultad de la tarea están dados por la combinación de distintos factores, tales como la cantidad de bloques a recordar y las características del recorrido espacial realizado por la secuencia (Busch et al., 2005; De Lillo et al., 2016; Orsini et al., 2001, Orsini, 2004). La cantidad de bloques, por un lado, representa el parámetro de dificultad más estudiado en la literatura, asociado a la capacidad de almacenamiento de la memoria de trabajo. Sin embargo, diversos estudios han resaltado la importancia de estudiar el impacto de la estructura espacial de la secuencia a recordar. De Lillo et al., (2016), al retomar la literatura del tema, definieron los parámetros de dificultad asociados con la estructura espacial: 1) la estructura, que refiere a la ubicación de los sucesivos bloques, indica que una secuencia es estructurada cuando contiene ítems consecutivos ubicados en la misma fila, columna o diagonal del espacio; 2) la longitud de la secuencia, definida como la superficie recorrida por la línea imaginaria que cruza a los bloques de la secuencia (medida en centímetros o milímetros), y 3) la cantidad de intersecciones generadas por el camino imaginario trazado por la secuencia espacial a recordar.

En términos generales, las personas participantes de diversos estudios mostraron mayores desempeños en secuencias estructuradas, de menor longitud y con menos intersecciones, mientras que las secuencias menos estructuradas, con mayor longitud y más intersecciones mostraron más errores. Además, los estudios muestran que cada uno de estos parámetros afecta de forma independiente a la dificultad de la secuencia (Busch et al., 2005; De Lillo et al., 2016; Orsini et al., 2001, Orsini, 2004).

Versiones de Bloques de Corsi manual y digital

Un conjunto importante de estudios se dedicó a comparar la implementación de diferentes adaptaciones computarizadas de la tarea Bloques de Corsi, con la versión original de madera. Por ejemplo, Robinson y Brewer (2016) compararon una versión de pantalla táctil sobre tabletas con la versión de madera original en una muestra de jóvenes de entre 18 y 19 años. En ese caso, no encontraron diferencias significativas en el desempeño respecto de la cantidad de ensayos correctos. Resultados similares fueron concluidos por estudios análogos realizados por distintos grupos de investigación (Brunetti et al., 2014; Siddi et al., 2020). En términos concretos, concluyen que la versión computarizada de Corsi podría ser utilizada como reemplazo de la versión original en contextos clínicos y de investigación. Sin embargo, resulta relevante mencionar que en el trabajo de Robinson y Brewer (2016), los participantes tardaron menos tiempo en resolver la versión digital que la versión manual. Además, los participantes informaron que la versión manual les resultó más demandante en términos físicos y mentales, a la vez que generó mayores niveles de disfrute.

Por otro lado, Röser y colegas (2016) compararon una versión de pantalla táctil de los Bloques de Corsi con la versión Walking Corsi (en la cual las secuencias se realizan al caminar sobre un piso que contiene una representación 2D de los bloques). Los autores encontraron diferencias significativas entre las distintas modalidades de evaluación y mostraron menores niveles de desempeño en las versiones que incluyeron la utilización de bloques en el piso en comparación con las versiones de pantalla. En otro trabajo, (Perrochon et al., 2014), compararon versiones similares de Corsi digital y Walking Corsi en una muestra que incluyó personas sin antecedentes de salud mental y personas con Deterioro Cognitivo Leve (DCL). Allí, las personas con DCL mostraron la misma capacidad de memoria que las personas sin DCL en términos de ensayos correctos. Sin embargo, ambos grupos de participantes mostraron distintos tipos de errores. Finalmente, como caso excepcional, Nelson et al., (2000) compararon una versión manual y automatizada con la versión original del Corsi, pero no encontraron diferencias en los resultados. Este es el único desarrollo en el cual se planteó utilizar una versión manual y automatizada del Corsi, pero no fue retomado ni por el mismo grupo ni por otros grupos de investigación.

A partir de ello, la propuesta para el presente trabajo es: 1) construir una versión manual y automatizada del test Bloques de Corsi; 2) comparar el desempeño de una muestra de personas adultas entre dicha versión y una versión computarizada, y 3) comparar la valoración del esfuerzo y rendimiento requerido por los distintos dispositivos.

Metodología

Diseño de la investigación

Se implementó un diseño cuasiexperimental (Hernández Sampieri et al., 2014) en el cual se buscó comparar dos versiones de la tarea de Bloques de Corsi: una versión digital ya existente (SoftCorsi) y una nueva versión manual desarrollada por los autores (CorsiBot).

A cada una de las 30 personas se las evaluó con ambos dispositivos, cada uno con un protocolo diferente (corto y largo), uno a continuación del otro. La distribución de los protocolos y dispositivos se realizó de manera contrabalanceada según el orden por conveniencia en que fueron evaluadas las personas. A las pruebas realizadas con cada persona en el primer turno se las denominó toma 1 y a las pruebas realizadas por cada persona en segundo lugar se las denominó toma 2. Esto permitiría poder evaluar posteriormente si, en las pruebas realizadas en segunda instancia por cada persona, se obtenía una mejora en el rendimiento producto de un probable aprendizaje –a pesar de cambiar el protocolo– o si, por el contrario, se obtendría en segundo lugar una baja del rendimiento producto del cansancio. Más adelante se profundizará en las características de los protocolos y los dispositivos.

Finalmente, luego de cada toma, los participantes debían completar el cuestionario NASA-TLX (Hart y Staveland, 1988) con el fin de explorar la carga de trabajo cognitiva requerida por cada dispositivo.

Participantes

El muestreo fue realizado por conveniencia (Hernández Sampieri et al., 2014) e incluyó a 30 personas (16 mujeres y 14 varones) mayores de edad. Un total de 26 participantes manifestaron ser diestras, mientras que solo cuatro manifestaron ser zurdas. La edad promedio de los participantes fue de 33 años, con un máximo de 59 y un mínimo de 22 años. Respecto del nivel de estudios alcanzados, un 3.3 % manifestó tener secundario completo; 16.7 % el terciario incompleto; 16.7 % terciario completo; 33.3 % universitario incompleto, y 30 % universitario completo. Por otro lado, todos los participantes manifestaron utilizar computadoras cotidianamente. Por último, las personas evaluadas fueron ciegas a las hipótesis del experimento. El estudio fue realizado en cumplimiento con las normas éticas de la APA (American Psychological Association) y la declaración de Helsinski.

Instrumentos

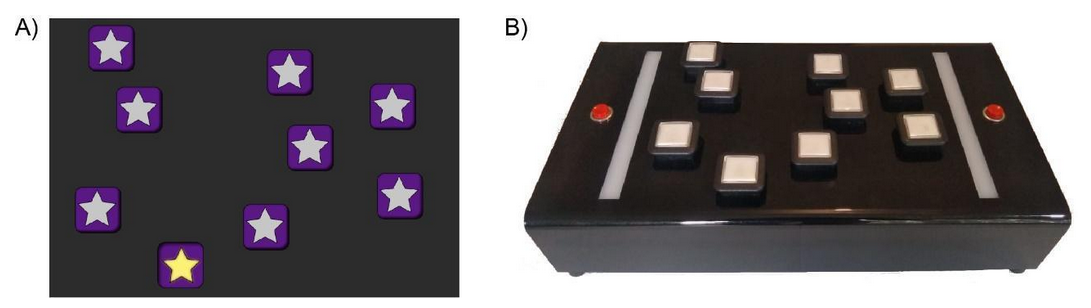

El SoftCorsi (dispositivo digital) fue administrado mediante una Notebook Samsung, modelo NP270E5E con una pantalla de 14 pulgadas. Los ensayos podían ser respondidos por los participantes mediante el uso de un mouse. Por otro lado, el CorsiBot (dispositivo manual) consistió en un gabinete de 390mm de ancho y 217mm de alto con nueve luces/botones que debían ser presionados luego de que se encendieran en el orden prescripto. Además, el gabinete incluía dos botones laterales para aceptar la secuencia presionada y para pasar al próximo ensayo.

El evaluador podía controlar el sistema de forma inalámbrica a partir de una computadora, tableta o teléfono inteligente. Lo dicho se podía realizar a partir de una interfaz web para la administración de las secuencias, ensayos y pruebas. El dispositivo en cuestión resultó de un relativo bajo costo (U$D 50) y permitió una rápida puesta en marcha y configuración inicial.

Figura 1.

Dispositivos utilizados para administrar la tarea de Bloques de Corsi.

A) SoftCorsi; B) CorsiBot

Procedimientos

Con el fin de comprender las diferencias entre los dispositivos a partir de distintos grados de dificultad, se generaron dos protocolos distintos. Estos protocolos consistieron en 14 secuencias (ensayos) que incrementaban la cantidad de estímulos a recordar (longitud) de forma creciente a cada dos ensayos (ensayos). Cada protocolo comenzaba con una longitud de dos estímulos y finalizaba con una de ocho.

Además de la longitud, también se consideraron otros parámetros de dificultad para la construcción de los protocolos: las intersecciones y la distancia. Se consideró que ocurría una intersección cuando el recorrido realizado para completar una secuencia implicaba atravesar un recorrido previamente realizado. Estudios previos (De Lillo, 2019;Orsini et al., 2001) mostraron que una secuencia con una o más intersecciones, podría tener una dificultad mayor que una que no las contuviera.

Los protocolos se diferenciaron a partir de la medida de distancia en un protocolo corto y un protocolo largo. La distancia total de una secuencia refiere a la suma total de las distancias físicas entre cada par de botones consecutivos. Estas distancias se corresponden con la ubicación de los botones en el tablero. A su vez, se incorporaron cuatro secuencias de práctica al comienzo de cada toma para que los participantes pudieran comprender la dinámica de la tarea antes de comenzar la evaluación.

El cuestionario tipo NASA-TLX, que cada persona debió completar al finalizar cada una de las tomas de datos, consistió en una valoración numérica en una escala del 1 al 20 para las variables de: exigencia mental, exigencia física, exigencia temporal, esfuerzo, rendimiento, nivel de frustración, y nivel de disfrute (Hart y Staveland, 1988).

Análisis de datos

Para cumplir con los objetivos del trabajo, se realizaron una serie de análisis estadísticos. En primer lugar, se calcularon los valores de media –desvío estándar–, mediana –valores mínimos y máximos para la cantidad de respuestas correctas–, y máxima longitud de secuencia correcta alcanzada, agrupadas por toma de datos, protocolo y dispositivo.

Posteriormente, se analizó la homogeneidad entre la toma 1 y la toma 2 para las condiciones de protocolo y dispositivo mediante la prueba de U de Mann-Whitney. Esto permitió establecer la similitud estadística entre las tomas 1 y 2 para verificar la posibilidad de sumarlas y generar análisis estadísticos más robustos en lo subsiguiente.

Luego de esto, se procedió a sumar ambas tomas de datos y comparar los valores de las variables de interés entre protocolos y dispositivos. Para esto, se realizaron comparaciones de mediana mediante el test de U de Mann-Whitney. Además, en todas las comparaciones se calcularon los tamaños del efecto mediante el estadístico r. Para cada uno de estos análisis se consideraron las siguientes variables de interés: proporción de ensayos correctos, máxima longitud de secuencia alcanzada, errores, errores con igual longitud de respuesta, errores de camino –respuestas que incluyen los estímulos correctos, pero en un orden diferente a la secuencia original. Luego, se procedió a comparar la valoración dada por los participantes en el cuestionario NASA-TLX a la experiencia con cada protocolo y dispositivo.

Resultados

Desempeño

Análisis de homogeneidad entre las tomas de datos

Se procedió a realizar los análisis de homogeneidad entre las tomas de datos 1 y 2, y entre los distintos dispositivos y protocolos. Los análisis (Tabla 1) mostraron que, tanto la proporción de respuestas correctas como la máxima longitud de secuencia correcta, fueron homogéneas para las tomas 1 y 2, en los dos protocolos utilizados (corto y largo) y en los dos dispositivos (CorsiBot y SoftCorsi). A partir de dichos resultados, se definió sumar los datos de ambas tomas de datos para los siguientes análisis.

| Protocolo corto | Protocolo largo | |||||||||||||

| Toma 1 | Toma 2 | p | Toma 1 | Toma 2 | p | |||||||||

| Med | Q25 | Q75 | Med | Q25 | Q75 | Med | Q25 | Q75 | Med | Q25 | Q75 | |||

| SoftCorsi | ||||||||||||||

| Cantidad de respuestas correctas | .67 | .64 | .71 | .71 | .64 | .81 | .36 | .71 | .53 | .75 | .71 | .64 | .73 | .81 |

| Máxima longitud de secuencia | 7 | 6 | 8 | 7 | 6.5 | 8 | .80 | 6 | 6 | 7 | 6.5 | 6 | 7 | .70 |

| CorsiBot | ||||||||||||||

| Cantidad de respuestas correctas | .64 | .62 | .75 | .64 | .64 | .71 | .80 | .64 | .64 | .71 | .67 | .55 | .80 | .95 |

| Máxima longitud de secuencia | 7 | 6.75 | 8 | 7 | 6 | 7 | .46 | 7 | 6.5 | 7.5 | 6 | 5.75 | 7 | .16 |

Análisis de desempeño entre dispositivos y protocolos

Los análisis del desempeño mostraron que las personas evaluadas no presentaron diferencias estadísticamente significativas en el desarrollo de la tarea con ambos dispositivos. De la misma manera, los análisis no arrojaron diferencias significativas en los desempeños en la tarea para los distintos dispositivos y protocolos administrados. Estos resultados fueron similares, tanto para la variable de proporción de ensayos correctos como en la máxima longitud de secuencia correcta (Tabla 2).

| SoftCorsi | CorsiBot | p | r | |||||

| Med | Q25 | Q75 | Med | Q25 | Q75 | |||

| Ambos protocolos | ||||||||

| Cantidad de respuestas correctas | .71 | .64 | .75 | .64 | .64 | .71 | .58 | .07 |

| Máxima longitud de secuencia | 7 | 6 | 7.75 | 7 | 6 | 7 | .88 | .01 |

| Errores de Camino | 2.5 | 1.25 | 3 | 2 | 1 | 3 | .23 | .15 |

| Protocolo corto | ||||||||

| Cantidad de respuestas correctas | .71 | .64 | .74 | .69 | .64 | .80 | .43 | .14 |

| Máxima longitud de secuencia | 7 | 6 | 8 | 7 | 6 | 7.5 | .59 | .09 |

| Errores de Camino | 2 | 1 | 3 | 2 | 1.5 | 3 | .98 | .007 |

| Protocolo largo | ||||||||

| Cantidad de respuestas correctas | .71 | .60 | .77 | .71 | .65 | .81 | .96 | .01 |

| Máxima longitud de secuencia | 6 | 6 | 7 | 7 | 6 | 7 | .79 | .05 |

| Errores de Camino | 3 | 2 | 3 | 1 | 1 | 2 | .03 | .39 |

Análisis de errores

A cada persona participante se le presentaron en total 28 secuencias, 14 por cada protocolo y dispositivo. Del total de las 840 secuencias fueron respondidas correctamente 570 (67.9 %), mientras que 270 respuestas fueron incorrectas (32.1 %). Además, de las 840 respuestas, 234 veces (27.9 %) las personas evaluadas respondieron erróneamente al presionar la misma cantidad de botones que la secuencia presentada, mientras que en 36 oportunidades lo hicieron con una cantidad de botones diferente a la longitud de la secuencia presentada, lo que representó un 4.3 % del total de respuestas. Dado que las respuestas incorrectas que mantuvieron la longitud de la secuencia fueron mayoritarias, los análisis posteriores se centraron en dichos errores.

Al discriminar los errores de camino por protocolo y dispositivo se encontraron diferencias estadísticamente significativas con el protocolo largo. Mientras que con el CorsiBot los errores de camino fueron solo 23/62 errores (37 %), con el SoftCorsi se cometieron una cantidad considerablemente mayor: 39/62 errores (63 %). Este fenómeno no se produjo con el protocolo corto.

Encuestas a personas evaluadas

Los análisis de las respuestas de las personas evaluadas con el cuestionario NASA-TLX mostraron que se realizó una valoración similar de los dispositivos en casi la totalidad de las variables. Sin embargo, se hallaron diferencias estadísticamente significativas en la valoración de la exigencia mental requerida por el protocolo largo. En particular, se reportó que el CorsiBot implicó una mayor exigencia mental que el SoftCorsi (Tabla 3). Por otro lado, los niveles de esfuerzo mostraron la misma tendencia a nivel descriptivo, aunque la diferencia no fue estadísticamente significativa.

| SoftCorsi | CorsiBot | p | r | |||||

| Med | Q25 | Q75 | Med | Q25 | Q75 | |||

| Ambos protocolos | ||||||||

| Exigencia mental | 12.5 | 11 | 15.75 | 14 | 11.25 | 16 | .24 | -15 |

| Exigencia Física | 4 | 2.25 | 7.5 | 4.5 | 3 | 8 | .49 | -.08 |

| Exigencia temporal | 9.5 | 8.52 | 13 | 9.5 | 6 | 11.75 | .45 | .09 |

| Esfuerzo | 13 | 11.25 | 14.75 | 13 | 12 | 15.75 | .80 | -.03 |

| Rendimiento | 10 | 7 | 11 | 10 | 9 | 12 | .25 | -.14 |

| Nivel de frustración | 9.5 | 5.25 | 13 | 10.5 | 7 | 12.75 | .59 | -.06 |

| Nivel de disfrute | 14 | 10 | 15.75 | 15 | 13 | 16 | .15 | -.18 |

| Protocolo corto | ||||||||

| Exigencia mental | 15 | 11 | 17.5 | 13 | 11 | 16 | .48 | .13 |

| Exigencia Física | 3 | 2.5 | 7 | 6 | 2 | 7.5 | .67 | -.08 |

| Exigencia temporal | 10 | 9 | 14 | 10 | 6.5 | 11.5 | .34 | .17 |

| Esfuerzo | 14 | 11.5 | 17.5 | 13 | 11.5 | 14.5 | .31 | .18 |

| Rendimiento | 10 | 7 | 11 | 11 | 9.5 | 13 | .07 | -.32 |

| Nivel de frustración | 10 | 7.5 | 13.5 | 12 | 10 | 13.5 | .49 | -.12 |

| Nivel de disfrute | 14 | 11 | 15 | 15 | 12.5 | 17 | .33 | -.17 |

| Protocolo largo | ||||||||

| Exigencia mental | 11 | 11 | 13.5 | 16 | 13 | 17 | .01 | -.43 |

| Exigencia Física | 4 | 2.5 | 7.5 | 4 | 3 | 8 | .78 | -.05 |

| Exigencia temporal | 9 | 5 | 12.5 | 9 | 6 | 12 | .98 | -.007 |

| Esfuerzo | 12 | 11.5 | 13 | 14 | 12.5 | 16 | .12 | -.28 |

| Rendimiento | 9 | 6.5 | 12 | 10 | 7 | 11 | .98 | .007 |

| Nivel de frustración | 9 | 5 | 12 | 10 | 6.5 | 11.5 | .90 | -.02 |

| Nivel de disfrute | 13 | 9 | 17.5 | 15 | 13 | 15.5 | .33 | -.17 |

Discusión y conclusiones

El desarrollo de versiones computarizadas del Bloques de Corsi, si bien ha significado un gran avance al automatizar los procesos de presentación de secuencias y registro de las respuestas, presenta un debate acerca de cómo los dispositivos con pantalla podrían impactar en la resolución de tareas con demanda de la memoria de trabajo (Carpenter y Alloway, 2019; Leeson, 2006).

En el presente trabajo, se ha desarrollado el CorsiBot: una versión manual y automatizada de Bloques de Corsi. El dispositivo en cuestión ha permitido realizar evaluaciones y registrar de forma eficiente las respuestas de distintas personas evaluadas, que luego permitieron la visualización de los resultados junto con la exportación de los datos para su posterior análisis. Los planos y códigos fuente del dispositivo se encuentran abiertos para su uso a través del siguiente enlace:

https://sites.google.com/view/defensa-maxi-urso/

En el experimento realizado, se buscó comparar el desempeño de una muestra de personas adultas entre una versión computarizada y el dispositivo desarrollado para la evaluación de procesos de memoria de trabajo. El análisis mostró valores de desempeño similares en ambos dispositivos para la mayor parte de las variables de interés. Específicamente, no se encontraron diferencias significativas entre los dispositivos para la cantidad de respuestas correctas ni para la máxima longitud de secuencia respondida correctamente, tal como se observó en la sección Desempeño.

Sin embargo, la comparación de los errores cometidos por las personas evaluadas evidenció algunas diferencias de acuerdo al dispositivo utilizado. En forma específica, los tipos de errores cometidos por los participantes difirieron de acuerdo al dispositivo utilizado. Al momento de analizar los ensayos que fueron respondidos incorrectamente, pero respetando la longitud de la secuencia presentada, se encontraron diferencias significativas en la cantidad de errores de camino cometidos con cada dispositivo. Este tipo de errores implicó que las personas evaluadas presionaron los botones correctos de la secuencia a recordar, pero en un orden diferente al de presentación. Los resultados mostraron que cuando los participantes utilizaron el SoftCorsi, cometieron más errores de camino que con el CorsiBot.

Este tipo de errores podrían ser explicados a partir de procesos asociados a la codificación de la secuencia. El estudio de De Lillo (2016) apoya la hipótesis de que las personas construyen imágenes mentales del camino realizado por la secuencia a recordar. Esta estrategia funcionaría mejor con caminos estructurados y con menos intersecciones, al formar figuras geométricas familiares. Los errores de camino reportados en este estudio podrían estar asociados a una codificación de las secuencias en un orden diferente al presentado, pero consistentes con una simplificación de la figura trazada por la secuencia. Esto concuerda con lo reportado en estudios de Orsini (Orsini et al., 2001, Orsini, 2004) en los que se refiere a la simplificación como el proceso por el cual las personas evaluadas recuerdan la secuencia presentada en un orden diferente al otorgado y evitan las intersecciones presentes en la secuencia original. Sin embargo, el tamaño de la muestra utilizada no permitió profundizar el análisis que pueda determinar el origen de los errores de camino.

Por otro lado, estos tipos de errores fueron menores en el caso de las personas evaluadas que utilizaron el CorsiBot. De acuerdo a lo observado, entre los estudios que compararon el desempeño en modalidad manual y digital del Corsi, este es el primero que encontró diferencias en los tipos de errores cometidos por las personas evaluadas, si bien, al igual que en la literatura del tema, las personas evaluadas mostraron una proporción similar de ensayos correctos y presentaron errores cualitativamente diferentes. Estos resultados podrían ser consecuencia del Mode Effect mencionado previamente, por lo que hay que resaltar la necesidad de continuar el estudio del impacto de las distintas modalidades de intervención utilizadas en la práctica clínica.

El trabajo de Perrochon et al. (2014), constituye un posible ejemplo del impacto del Mode Effect en los tipos de errores en una tarea con demanda de memoria de trabajo espacial. En dicho estudio compararon el desempeño de una muestra de personas adultas mayores con DCL en una versión SoftCorsi y en una versión del Walking Corsi. Sus resultados mostraron que las personas con DCL evaluadas tenían la misma capacidad de memoria que las personas evaluadas sin DCL, en términos de ensayos correctos. Sin embargo, ambos grupos de participantes mostraron distintos tipos de errores y que quienes no padecían DCL tendían a presentar errores de un bloque, mientras que quienes padecían DLC erraban en más de dos. Próximos trabajos podrían profundizar en estos resultados con una mayor cantidad de casos para determinar con mayor precisión el tipo de errores que son afectados por el Mode Effect y las implicancias que ello podría tener para la práctica clínica.

Respecto de las valoraciones que realizaron las personas evaluadas de su experiencia con los dispositivos, se evidenciaron diferencias en los ítems de exigencia mental y el esfuerzo. Particularmente, las personas que realizaron el protocolo largo con el CorsiBot presentaron valores superiores a quienes fueron evaluadas con el SoftCorsi. Al respecto, los próximos trabajos podrían profundizar el análisis y tomar una mayor cantidad de casos para despejar la variable de haber realizado dos tomas de datos, lo cual podría haber influido en esta valoración superior cuando realizaron el protocolo largo con el CorsiBot, luego de haber realizado el protocolo corto con el SoftCorsi.

El trabajo presenta algunas limitaciones más que deberían ser tenidas en cuenta a futuro. La primera limitación tiene que ver con el tamaño muestral. En próximos trabajos deberían incluirse muestras más grandes con mayor poder estadístico que permitan hacer análisis más complejos y más generalizables. En relación con esto, otra limitación del estudio tiene que ver con el hecho de haber sido realizado en un contexto de laboratorio y con una muestra con características acotadas. Los próximos estudios podrían incorporar otros contextos (escolares, recreativos, clínicos) y otras muestras (e.g. niños, personas con patologías, personas de diversos contextos socioeconómicos). Otra limitación del estudio tuvo que ver con la falta de análisis de validez y fiabilidad, debido al tamaño de la muestra incluida. Este es un aspecto clave a tener en cuenta en próximos trabajos para que la tarea sea escalable a otros contextos. Por último, en este trabajo, la tarea de Corsi digital fue realizada por los participantes a partir del uso de un mouse y no mediante pantalla táctil como en estudios contemporáneos. Este es un aspecto a ser resuelto y abordado en la presente línea de investigación. Si bien la muestra de 30 personas evaluadas fue acotada, los análisis presentan nuevos interrogantes y abren la posibilidad de seguir experimentando para evaluar el impacto de las distintas formas de administrar el test de Bloques de Corsi en relación al denominado Mode Effect (Leeson, 2006). Lo dicho podría ser un aporte de relevancia, tanto para grupos de investigación como profesionales clínicos, que utilizan tareas de memoria de trabajo espacial en su práctica cotidiana. El modo de evaluación podría ser relevante en términos teóricos, al aportar evidencia sobre el comportamiento de la memoria de trabajo bajo distintos contextos de procesamiento. También podría ser relevante en términos prácticos y diagnósticos al permitir la identificación de diferencias individuales en distintas modalidades de evaluación.

En el presente trabajo se construyó un dispositivo automatizado para la evaluación de la prueba Bloques de Corsi. Este esfuerzo va en consonancia con el proceso que vive el mundo, en el cual la tecnología y los dispositivos electrónicos se encuentran cada vez más presentes, y poder evaluar su impacto de manera crítica. El presente aporte se encuentra disponible bajo licencia libre para su uso, reproducción y mejora para toda la comunidad científica.

Referencias

Baddeley, A., Hitch, G. y Allen, R. (2020). A Multicomponent Model of Working Memory. En R. Logie, V. Camos, y N. Cowan (Eds.), Working Memory: The state of the science (pp. 10–44). Oxford University Press.

Brunetti, R., Del Gatto, C. y Delogu, F. (2014). eCorsi: Implementation and testing of the Corsi block-tapping task for digital tablets. Frontiers in Psychology, 5(AUG), 1–8. https://doi.org/10.3389/fpsyg.2014.00939

Busch, R. M., Farrell, K., Lisdahl-Medina, K. y Krikorian, R. (2005). Corsi Block-Tapping task performance as a function of path configuration. Journal of Clinical and Experimental Neuropsychology, 27(1), 127–134. https://doi.org/10.1080/138033990513681

Carpenter, R. y Alloway, T. (2019). Computer Versus Paper-Based Testing: Are They Equivalent When it Comes to Working Memory? Journal of Psychoeducational Assessment, 37(3), 382–394. https://doi.org/10.1177/0734282918761496

Clariana, R. y Wallace, P. (2002). Paper–based versus computer–based assessment: key factors associated with the test mode effect. British Journal of Educational Technology, 33(5), 593–602. https://doi.org/10.1111/1467-8535.00294

De Lillo, C. (2019). Variations in the beneficial effects of spatial structure and serial organisation on working memory span in humans and other species. En T. Hodgson, T. (Ed.), Processes of Visuospatial Attention and Working Memory. Current Topics in Behavioral Neurosciences (Vol 41). Springer, Cham. https://doi.org/10.1007/7854_2019_97

De Lillo, C., Kirby, M. y Poole, D. (2016). Spatio-temporal structure, path characteristics, and perceptual grouping in immediate serial spatial recall. Frontiers in Psychology, 7, 1–18. https://doi.org/10.3389/fpsyg.2016.01686

Dotan, D., Pinheiro-Chagas, P., Al Roumi, F. y Dehaene, S. (2019). Track It to Crack It: Dissecting Processing Stages with Finger Tracking. Trends in Cognitive Sciences, 23(12), 1058–1070. https://doi.org/10.1016/j.tics.2019.10.002

Hart, S. G. y Staveland, L. E. (1988). Development of NASA-TLX (Task Load Index): Results of empirical and theoretical research. Advances in psychology, (52), 139–183. https://doi.org/10.1016/S0166-4115(08)62386-9

Hernández Sampieri, R., Fernández Collado, C. y Baptista, M. P. (2014). Metodología de la Investigación. Mc Graw Hill.

Leeson, H. V. (2006). The Mode Effect: A Literature Review of Human and Technological Issues in Computerized Testing. International Journal of Testing, 6(1), 1–24. https://doi.org/10.1207/s15327574ijt0601_1

Mayes, D. K., Sims, V. K. y Koonce, J. M. (2001). Comprehension and workload differences for VDT and paper-based reading. International Journal of Industrial Ergonomics, 28(6), 367–378. https://doi.org/10.1016/S0169-8141(01)00043-9

Nelson, R. E., Dickson, A. L. y Baños, J. H. (2000). An automated administration of Corsi’s Block-tapping Test. Perceptual and Motor Skills, 91(2), 578–580. https://doi.org/10.2466/pms.2000.91.2.578

Orsini, A., Pasquadibisceglie, M., Picone, L. y Tortora, R. (2001). Factors Which Influence the Difficulty of the Spatial Path in Corsi’s Block-Tapping Test. Perceptual and Motor Skills, 92(3), 732–738. https://doi.org/10.2466/pms.2001.92.3.732

Orsini, A., Simonetta, S. y Marmorato, M. S. (2004). Corsi’s block-tapping test: Some characteristics of the spatial path which influence memory. Perceptual and Motor Skills, 98(2), 382–388. https://doi.org/10.2466/pms.98.2.382-388

Patt, V. M., Thomas, M. L., Minassian, A., Geyer, M. A., Brown, G. G. y Perry, W. (2014). Disentangling working memory processes during spatial span assessment: A modeling analysis of preferred eye movement strategies. Journal of Clinical and Experimental Neuropsychology, 36(2), 186–204. https://doi.org/10.1080/13803395.2013.877123

Perrochon, A., Kemoun, G., Dugué, B. y Berthoz, A. (2014). Cognitive Impairment Assessment through Visuospatial Memory Can Be Performed with a Modified Walking Corsi Test Using the Magic Carpet. Dementia and Geriatric Cognitive Disorders Extra, 4(1), 1–13. https://doi.org/10.1159/000356727

Pickering, S. J. (2001). The development of visuo-spatial working memory. Memory, 9(4–6), 423–432. https://doi.org/10.1080/09658210143000182

Robinson, S. J. y Brewer, G. (2016). Performance on the traditional and the touch screen, tablet versions of the Corsi Block and the Tower of Hanoi tasks. Computers in Human Behavior, 60, 29–34. https://doi.org/10.1016/j.chb.2016.02.047

Röser, A., Hardiess, G. y Mallot, H. A. (2016). Modality dependence and intermodal transfer in the Corsi Spatial Sequence Task: Screen vs. Floor. Experimental Brain Research, 234(7), 1849–1862. https://doi.org/10.1007/s00221-016-4582-z

Siddi, S., Preti, A., Lara, E., Brébion, G., Vila, R., Iglesias, M., Cuevas-Esteban, J., López-Carrilero, R., Butjosa, A. y Haro, J. M. (2020). Comparison of the touch-screen and traditional versions of the Corsi block-tapping test in patients with psychosis and healthy controls. BMC Psychiatry, 20(1), 1–10. https://doi.org/10.1186/s12888-020-02716-8

Taylor, C., Kirsch, I., Jamieson, J. y Eignor, D. (1999). Examining the relationship between computer familiarity and performance on computer‐based language tasks. Language Learning, 49(2), 219–274. https://doi.org/10.1111/0023-8333.00088

Wästlund, E., Reinikka, H., Norlander, T. y Archer, T. (2005). Effects of VDT and paper presentation on consumption and production of information: Psychological and physiological factors. Computers in Human Behavior, 21(2), 377–394. https://doi.org/10.1016/j.chb.2004.02.007

Yu, G. (2010). Effects of presentation mode and computer familiarity on summarization of extended texts. Language Assessment Quarterly, 7(2), 119–136. https://doi.org/10.1080/15434300903452355