Artículos de Investigación

Estilector: un sistema de evaluación automática de la escritura académica en castellano

Estilector: an automatic evaluation system for academic writing in Spanish

Estilector: un sistema de evaluación automática de la escritura académica en castellano

Perspectiva Educacional, vol. 62, no. 2, pp. 37-59, 2023

Pontificia Universidad Católica de Valparaíso, Facultad de Filosofía Educación, Escuela de Pedagogía.

Received: 15 October 2022

Accepted: 29 December 2022

Resumen: Se describe Estilector, un sistema de retroalimentación automática de escritura académica en castellano. El software está orientado principalmente a la detección de problemas textuales, aunque también incorpora, en menor medida, correcciones gramaticales y ortográficas. Pretende apoyar el aprendizaje de la escritura aportando feedback formativo, y proporciona referencias bibliográficas y sugerencias de revisión más extensas que las de los procesadores de texto. El programa funciona actualmente en línea y es de acceso gratuito. En sus años de existencia, ha tenido gran número y variedad de usuarios, y se ha ido adaptando a un público que requiere apoyo básico y transversal a la hora de escribir. En este artículo ofrecemos una descripción del estado actual del proyecto con sus métodos de detección y revisión de errores además de algunas reflexiones finales, incluyendo sus limitaciones y posibilidades de desarrollo futuro.

Palabras clave: Edición de textos, enseñanza superior, escritura, nuevas tecnologías, retroalimentación.

Abstract:

Estilector is a free online system for the automatic proofreading of academic writing in Spanish. It works by indicating possible errors in the text and, in some cases, suggesting their correction. Not always the issues that the program finds are necessarily incorrect from the normative point of view, but they are aspects that could be improved from the point of view of the requirements of an academic text, especially the textual and discursive aspects. Along these lines, the software is designed primarily for the detection of textual problems, although it also incorporates, to a lesser extent, some lexical, grammatical, and spelling corrections. In addition to offering corrections, it supports the learning of writing skills by providing formative feedback, so it falls into the category of a writing support tool of the automated writing evaluation type or AWE (Strobl et al., 2019). In that line, it provides bibliographic references to facilitate the learning of the aspects considered improvable and explanations which exceed the traditional concept of correction of word processors (cf. Dale & Viethen, 2021), such as Microsoft Word or Google Docs. In its years of existence, it has had a large number and variety of users and has been adapting to an audience that requires basic, cross-cutting support when writing. In this article, we offer a description of the current status of the project with its methods of error detection and revision as well as some final thoughts, including its limitations and some possibilities for future development, such as the following: 1) Adapting the software as a tool for writing assessment. It is necessary to incorporate modules that allow the program to be used as a support for the formal assessment of writing tasks in universities, in order to make the program more effective as a tool to support the learning of writing (Conijn et al., 2020). This implies at least considering the discursive genre variable, providing the teacher and the student with a quantitative and qualitative summary of the latter's performance, or the teacher being able to add comments to the feedback that the program provides automatically. 2) Incorporating different types of users. In line with the above, Estilector is projected as a tool that assumes that writing is, to a greater or lesser extent, a collective activity, in which the writer consults, submits for reading, and is evaluated by others (Hayes, 2012). For this reason, we plan that the program will be accessed by a user who can be assigned various roles, e.g., tutor or student. 3) Improving precision of the existing rules and incorporating new ones for the detection of different types of errors. The results of the evaluation presented in the paper offer insight into what aspect should be improved, which will be added to the lines of research already open.

Keywords: Editing, feedback, higher education, new technologies, writing.

1. Introducción

Estilector (www.estilector.com) es un sistema en línea y gratuito orientado a la revisión automática de escritura académica en castellano. Funciona indicando posibles errores en el texto y, en algunos casos, sugiriendo su corrección. No siempre las cuestiones que releva el programa son necesariamente incorrectas desde el punto de vista normativo, pero sí son aspectos que podrían ser mejorables desde el punto de vista de los requerimientos de un texto académico, especialmente los aspectos textuales-discursivos.

En esa línea, el software está diseñado principalmente para la detección de problemas textuales, aunque también incorpora, en menor medida, algunas correcciones de léxico, gramática y ortografía. Además de ofrecer correcciones, apoya el aprendizaje de la escritura al aportar feedback formativo, por lo que entra en la categoría de herramienta de apoyo al aprendizaje de la escritura del tipo automated writing evaluation, AWE (Strobl et al., 2019). En esa línea, proporciona referencias bibliográficas para facilitar el aprendizaje del aspecto considerado mejorable y explicaciones, lo que sobrepasa el concepto tradicional de corrección de los procesadores de texto (cf.Dale & Viethen, 2021), como Microsoft Word o Google Docs.

En el presente artículo se expone, en el apartado 2, la concepción de la escritura como un proceso complejo y recursivo y en el que se combinan aspectos cognitivos y del entorno social del estudiante, concepción que subyace en el diseño del programa; en el apartado 3 se presenta Estilector en el marco de los programas de apoyo a la redacción académica; en el apartado 4 se describe los métodos implementados para su funcionamiento; en el apartado 5 se exponen los resultados de la evaluación del programa realizada por el equipo de investigadores, y en el apartado 6 se aportan unas conclusiones y programa de trabajo futuro.

2. Marco teórico

2.1 Dimensiones del proceso de escritura

La escritura es una actividad enormemente compleja, con alta demanda cognitiva y una importancia histórica y social como pocas invenciones humanas. Allen et al. (2016) indican que averiguar qué está mal en un texto es más complejo que hacerlo en una ecuación matemática, y Kellogg (1994) indica que la escritura es la actividad humana más cognitivamente demandante junto con el ajedrez. Es una destreza fundamental que se requiere en casi todos los ámbitos de la vida, ligada a la comunicación y registro de las ideas, la reflexión, la persuasión, las relaciones sociales, la imaginación y el manejo emocional (Graham, 2019). La escritura de trabajos académicos resulta desafiante para estudiantes universitarios de grado y posgrado, y desempeña un papel crucial en sus carreras (Chen et al., 2021; Conijn et al., 2020). En el mundo profesional, muchos puestos de trabajo requieren utilizar la escritura (ej., en el ámbito de la administración) o bien esta es la protagonista de una determinada profesión (ej., el periodismo o la abogacía) (Lea & Street, 2006; Shriver, 2012). El avance industrial y tecnológico no ha hecho más que aumentar la interacción del ser humano con procesos de escritura de diversos tipos en su vida personal, académica y profesional (Flower, 1994; Williams & Beam, 2019). La escritura es, por tanto, una actividad imprescindible, transversal y cotidiana en la vida del ciudadano del mundo actual, que debe ser enseñada y aprendida como habilidad per se transformadora del conocimiento, y no solo como un vehículo de conocimiento (Bereiter & Scardamalia, 1987).

La escritura es un proceso cognitivo compuesto de varios subprocesos que alternan recursivamente a lo largo de la tarea de redacción (Flower & Hayes, 1981; Hayes & Flower, 1980): la planificación, o el conjunto de tareas para la concepción estratégica del texto; la traducción (también adaptada al español como textualización), o traspaso de las ideas al texto, y la revisión, o el conjunto de tareas que se realizan para ajustar el borrador a los propósitos retóricos del texto. Desde las primeras investigaciones con protocolos en voz alta aplicados a la escritura (Hayes & Flower, 1980) hasta las más recientes con eye trackers o keystroke loggers (De Smet et al., 2018, entre muchos otros), se ha observado que el redactor cambia de tarea múltiples veces a lo largo del proceso de escritura, reorganizando su planificación, textualizando y revisando múltiples veces hasta finalizar el escrito. La escritura, por tanto, no es un proceso en que sus diversas etapas se observan claramente separadas entre sí a lo largo de la confección del texto, de manera lineal (como se proponía en Rohman, 1965).

La teoría sobre el proceso de escritura ha ido incorporando aspectos relacionados con el entorno social, material y emocional del sujeto escritor en su proceso de redacción, incluida la colaboración e interacción con la comunidad en que se inserta, y otorgando mayor relevancia a los aspectos tecnológicos que median entre el escritor y el producto escrito (Brand, 1987; Graham, 2018; Hayes, 1996, 2012; Hayes & Olinghouse, 2015). Los softwares de apoyo se incorporan en los modelos de proceso de escritura como un tipo de tecnología especializada en colaborar con el redactor para mejorar el texto, en cualquiera de sus subprocesos y en las múltiples dimensiones que componen la escritura (Strobl et al., 2019). Sin embargo, son escasas aún las propuestas teóricas para adaptar los modelos clásicos sobre el proceso de escritura a estos nuevos entornos altamente tecnologizados, en los que los softwares de apoyo a la redacción van más allá del traspaso mecánico de las ideas al código escrito, como podrían hacerlo una máquina de escribir o un procesador de texto en la década de 1980.

2.2 La revisión automatizada de textos académicos

La escritura académica puede definirse como “any writing that fulfills a purpose of education in a college or university” (Thaiss & Zawacki, 2006, p. 4). Por tanto, un texto académico se puede elaborar a partir de una tarea asignada por el profesor, pero también puede corresponder a textos publicados por los académicos en revistas de investigación o en actas de congresos. El proyecto Estilector, dado que tiene como público objetivo estudiantes noveles, se ocupa solamente del primer tipo de texto académico de los dos mencionados por Thaiss y Zawacki (2006). La revisión de Sologuren (2020) revela una gran variedad de géneros académicos universitarios destinados a evaluar al estudiante, como distintos tipos de informes, ensayo argumentativo, ejercicio, estudio de caso, análisis, trabajos de fin de grado o tesis, entre otros: en estos géneros se enfoca Estilector, aunque los aspectos vinculados a cada género en específico están aún en desarrollo (a modo de ejemplo, la investigación de Castro [2023] se enfoca exclusivamente en corrección automática de informes de Ingeniería Civil Informática).

La revisión automatizada de textos resulta de gran ayuda para el desarrollo de las habilidades del escritor durante el proceso de creación de su texto, especialmente en su etapa de formación universitaria (Allen et al., 2016; Link et al., 2020). Al proporcionar feedback inmediato y específico al estudiante a través de estas herramientas, este puede aprender acerca de las destrezas de redacción durante su proceso de escritura y antes de ser evaluado por el profesor, lo que resulta más efectivo que recibir feedback alejado en el tiempo de la producción del texto, y una vez este ya se ha terminado de redactar. Esto no solo contribuye al aprendizaje de la escritura por parte del estudiante, sino que disminuye la carga del profesor a la hora de proporcionar feedback formativo escrito. Esta tarea, si bien es necesaria para aportar una evaluación completa sobre el desempeño del estudiante, requiere mucho tiempo por parte del docente, que está habitualmente sobrecargado de trabajo (Allen et al., 2016). Una herramienta automatizada de apoyo a la escritura, por tanto, es un acompañamiento sincrónico al aprendizaje del estudiante y un complemento (no una sustitución) de la labor del profesor.

Pueden establecerse cuatro tipos de herramientas para el apoyo a la escritura, que se presentan a continuación. Las tres primeras son propuestas por Allen et al. (2016) y la cuarta es añadida por Strobl et al. (2019):

-

Automated essay scoring (AES) o puntaje automático de trabajos. Las herramientas tipo AES analizan un texto académico comparándolo con el gold standard y le adjudican un puntaje. Esto orienta al estudiante y aligera la carga al profesor, pero no proporciona feedback acerca de los problemas del texto, por lo que resulta menos efectivo a la hora de aprender a escribir.

-

Automated writing evaluation (AWE) o evaluación automatizada de la escritura. Las herramientas tipo AWE consisten en revisiones automatizadas de textos a las que se suma un feedback formativo escrito, lo que hace que estos programas sean un complemento para la formación en escritura de los estudiantes, porque les permiten aprender de sus errores.

-

Intelligent tutoring systems for writing (ITS) o sistemas de tutores inteligentes para la escritura. Los sistemas tipo ITS son los más completos y ofrecen una guía personalizada acorde con las necesidades específicas de cada estudiante.

-

Interactive writing platforms (IWP) o plataformas interactivas de escritura. Las herramientas tipo IWP se enfocan en ofrecer orientaciones generales sobre el proceso de escritura y facilitan la interacción con el profesor, pero no procesan los textos, de modo que no pueden proporcionar un feedback específico ni sobre el error ni con respecto al estudiante.

En cuanto a los aspectos del texto que revisan las herramientas automatizadas, Strobl et al. (2019) establecen dos grandes categorías: las revisiones en el micronivel textual y las revisiones en el macronivel textual. Las primeras corresponden a aspectos vinculados al nivel léxico y oracional (gramática, ortografía, puntuación, vocabulario, etc.) y las segundas a aspectos relacionados con el párrafo, el apartado o el texto íntegro (estructura, cohesión textual, rasgos del género textual, etc.). Las correcciones de micronivel son más propias de los procesadores de textos como Word o Google Docs, y pueden dividirse en los siguientes tipos:

-

La corrección ortográfica y las erratas (spelling)

-

La corrección gramatical

-

La corrección de estilo

-

La corrección del léxico

Dale y Viethen (2021) proponen los tipos a), b) y c) (aunque la corrección de estilo, como se ha dicho, es aún muy menor en los procesadores de texto), y nosotros añadimos el d) porque los aspectos léxicos sobrepasan las tres dimensiones anteriores y constituyen un requisito importante en los procesos de enseñanza-aprendizaje.

Estos factores microtextuales son más transversales a todos los textos que los macroestructurales, y por ello son el foco de atención de los procesadores de texto, que son herramientas genéricas. En comparación con los aspectos propiamente textuales o discursivos, resultan computacionalmente menos costosos, y puede ser el motivo por el que la mayoría de las herramientas pedagógicas revisadas por Strobl et al. (2019) proporcionan más feedback sobre aspectos microtextuales que macrotextuales.

3. Estilector en el panorama de las herramientas de apoyo a la escritura

Estilector fue creado como una herramienta de apoyo a los estudiantes noveles, en concreto, estudiantes de primer año de la carrera de Pedagogía en Castellano y Comunicación de la Pontificia Universidad Católica de Valparaíso (PUCV), en el marco de dos proyectos consecutivos (2014 y 2015) de innovación en docencia universitaria financiados por la propia universidad. El equipo de trabajo, formado por profesores y estudiantes de la PUCV, observó la necesidad de un programa que acompañara a los estudiantes noveles debido a su bajo desempeño en escritura al iniciar su etapa universitaria. En el corpus textual examinado por el equipo a lo largo de varias generaciones de estudiantes, se observan problemas que van más allá de los errores ortográficos o gramaticales, y que se relacionan con la dificultad para organizar las ideas en el texto, comprender las funciones retóricas de cada apartado y adecuarse al nivel de complejidad y los objetivos de un texto académico. La mayoría de los estudiantes chilenos tiene un nivel de escritura muy mejorable en la etapa escolar, con dificultad para producir textos coherentes y bien estructurados (Bañales et al., 2018), lo que se traslada al inicio de su etapa universitaria. En concreto, con respecto a la carrera de Castellano y Comunicación, la evaluación diagnóstica inicial (implementada por la PUCV para todas las carreras en el primer semestre del grado) de 2021 mostró que un 86% de los estudiantes de dicho grado presentaban un nivel “No logrado” en producción escrita. Junto con ello, la universidad, en su modelo educativo (vigente en 2022), presenta la “comunicación oral y escrita”, el “uso de las tecnologías” y la “capacidad de aprender a aprender” como “habilidades transversales para el siglo xxi que deben fortalecerse en la educación universitaria” (p. 7). En este contexto, pues, Estilector se concibe como un complemento gratuito, accesible y fácil de usar que no sustituye la labor del profesor, pero sí tiene por objetivo acompañar al estudiante a lo largo de su proceso de inserción disciplinar, en el que la escritura es un medio de transmisión del conocimiento, pero también una poderosa herramienta epistémica (Navarro, 2019).

Desde su creación, Estilector ha ido aumentando el número y el tipo de usuarios, de modo que actualmente es utilizado por redactores de casi cualquier parte del mundo, especialmente Latinoamérica. El equipo de trabajo, a través de diversas investigaciones (como la de Castro, 2023), ha ido advirtiendo muchos problemas comunes en la escritura de estudiantes de diversas carreras, no solo la de Castellano; por ello, trabaja actualmente para ampliar el tipo de usuario, aunque enfocándose siempre en escritura académica.

Las reglas que hasta ahora se han aplicado en el programa consideran, pues, la necesidad de que la precisión sea alta para evitar falsos positivos o ultracorrecciones, es decir, que el sistema corrija un segmento que en realidad estaba correctamente redactado. Si bien es cierto que la precisión nunca puede ser del 100% en un sistema de corrección automática (Dale & Viethen, 2021), no debería producir inseguridad en un usuario que, si está usando el programa, es porque tiene dudas acerca de su propio desempeño como escritor.

El feedback que recibe el usuario a través de la herramienta consiste generalmente en tres tipos de información:

-

Una indicación sobre el tipo de error detectado y, de ser necesario, una explicación que ayude al estudiante a entender por qué se trata de un error.

-

Una sugerencia sobre la corrección (si es pertinente).

-

Bibliografía de apoyo en la mayoría de los casos.

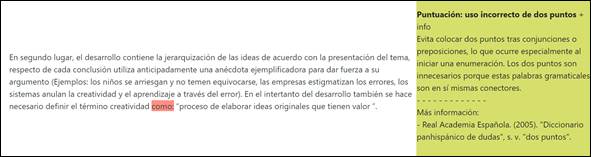

En la Figura 1 se muestra un ejemplo de corrección realizada por el programa. A la izquierda está el cuadro de texto con el fragmento incorrecto señalado en un color, y a la derecha, en el cuadro verde, se encuentran los tres tipos de información señalados. La referencia bibliográfica es un enlace al recurso electrónico.

Figura 1

Ejemplo de revisión realizada por Estilector.

En relación con los modelos de escritura mencionados en el apartado 2, la información de a) facilita al usuario la tarea de revisión o revising y la información de b) facilita la tarea de corrección o editing (Flower & Hayes, 1981). Con respecto a c), el programa contempla que las tareas de escritura van acompañadas por consulta de textos complementarios al borrador que se está redactando, como parte de los materiales de la tarea, y que la creación de un texto académico va siempre acompañada de la consulta de documentación complementaria al propio texto redactado (Hayes, 2012; Kellogg, 1994; O’Hara et al., 2002).

Como ya se indicó al inicio de este apartado, Estilector está por el momento más centrado en atender problemas textuales relacionados con la puntuación, uso de marcadores discursivos o estructura del párrafo, entre otros, debido a que los estudiantes ya tienen correctores automáticos de ortografía y gramática a su disposición. Sin embargo, estas revisiones en el micronivel textual no son suficientes para considerar una revisión de un texto como completada (Chukharev-Hudilainen & Saricaoglu, 2016) y, además, contribuyen solo modestamente a la construcción del texto por parte de los estudiantes (McCarthy et al., 2022). No obstante, dada la abundancia de faltas y erratas que los profesores suelen observar en los textos de sus alumnos pese al uso de Word o Google Docs, también se está trabajando en algunos aspectos formales que han sido tradicionalmente desatendidos por los procesadores de textos, como la corrección de tildes en los casos en que las formas con y sin tilde existen en el vocabulario (ej., ejercito, ejército, ejercitó) (Atserias et al., 2012). También se está en proceso de integrar en Estilector investigaciones previas sobre enseñanza-aprendizaje de las colocaciones (Ferraro et al., 2014) y corrección automática de aspectos gramaticales (López-Ferrero et al., 2014; Nazar & Renau, 2012). A partir de los resultados de esas investigaciones previas, se pretende ahora ofrecer una solución aplicada mediante la implementación de una herramienta concreta.

Strobl et al. (2019), en su revisión sobre 44 herramientas pedagógicas de apoyo a la escritura, señalan cuatro grandes categorías para su análisis:

-

Especificaciones generales de las herramientas, como el tipo de público al que se dirigen, nivel de estudios del usuario o L1 o L2 del usuario.

-

Aspectos relacionados con el enfoque instruccional, como el nivel macro o micro de la revisión, el subproceso de escritura involucrado en la revisión, entre otros aspectos.

-

Las especificaciones técnicas, como la estrategia empleada para la automatización de la tarea de revisión.

-

El tipo de feedback que proporcionan: automático + humano, autorregulado, específico o general, etc.

Si se considera esta taxonomía, Estilector posee las características que se muestran en la Tabla 1:

Fuente: Elaboración propia.

De estas características, destacamos, en primer lugar, el tipo de herramienta según la clasificación mencionada en el apartado 3: AWE. Ello significa que el programa aporta correcciones en el momento de escribir, acompañando al estudiante en su proceso de redacción del texto antes de ser entregado. Destacamos también el hecho de que esté dirigido a estudiantes que tienen el español como L1, porque en la revisión de Strobl et al. (2019) no se menciona ninguna herramienta AWE para español como L1: de hecho, de las 44 herramientas que presentan, solamente Redactext (Álvarez Angulo et al., 2015) está disponible para el español, y se trata de una IWP, es decir, una web que ofrece indicaciones y ejercicios para la guía del estudiante en su proceso de redacción, pero no proporciona feedback personalizado de ningún tipo. Debemos mencionar, no obstante, que sí existen al menos dos herramientas automatizadas de apoyo a la escritura académica: ArText (Da Cunha, 2020), para trabajos de final de grado, y PEUMO (http://www.redilegra.com/peumo), para textos académicos de Ingeniería.

4. Metodología

En este apartado se exponen las características del software desde el punto de vista de su implementación computacional; es decir, sus “características técnicas” (ver Tabla 1).

Estilector es un sistema basado en reglas que especifican patrones de error frecuentes en la redacción de textos. Estas reglas se agrupan en categorías como ortografía, gramática, puntuación, léxico y estructura textual. Reglas recientemente añadidas apuntan, entre otros aspectos, a problemas de acentuación diacrítica ya mencionados, es decir, se enfocan en complementar los procesadores de textos que emplean los estudiantes, cuando estos no aportan feedback suficientemente especializado, o simplemente no lo aportan.

4.1. Funcionamiento del sistema

Para el usuario, el funcionamiento del sistema supone disponer previamente de un texto de su autoría redactado en un procesador de texto común. Ese texto se revisa con Estilector seleccionando y copiando desde el procesador para pegarlo en la web Estilector.com. Al pulsar la tecla “Enviar”, el sistema despliega el mismo texto, pero ahora con una serie de anotaciones al margen que dan cuenta de todas las observaciones que el programa ha realizado. Estas anotaciones se pueden expandir mediante la selección del botón “Más info”, para obtener el despliegue de más información acerca del aspecto encontrado, además de algunas referencias y recomendaciones.

El usuario puede, si lo desea, realizar modificaciones al texto en la propia web de Estilector clicando sobre dicho párrafo y corrigiendo lo que desee en el cuadro de texto abierto a tal efecto. A continuación, pulsa “Revisar” y el sistema actualiza los cambios. Idealmente, tras toda la revisión del texto por parte del estudiante con la asistencia del programa, este no debería arrojarle ningún comentario más. El texto modificado se puede copiar y pegar de nuevo en el procesador de textos para darle formato o continuar la redacción.

El usuario tiene además la opción de avisar a los desarrolladores en caso de que una recomendación efectuada no sea correcta. Para ello cuenta con un formulario en que puede explicar la naturaleza del error producido o por qué la sugerencia del programa puede considerarse inapropiada en ese caso específico. Además, es posible incorporar nombre y correo electrónico, con el objeto de poder hacer el seguimiento del aviso y entrar en diálogo con los desarrolladores en caso de ser necesario. Este último sistema de aviso de errores ha sido de gran utilidad para la detección efectiva de bugs en el software y para tener datos sobre el modo como los usuarios interaccionan con el programa.

4.2. Arquitectura del sistema

En este apartado se describen las reglas en las que se basa el sistema agrupándolas en módulos. Estos módulos se aplican de manera secuencial sobre el texto analizado; es decir: el sistema comienza detectando la lengua del texto, luego analiza algunos aspectos de la estructura textual, tras lo cual puede iniciar el análisis de la puntuación. A continuación, realiza el barrido de los aspectos gramaticales que, por el momento, puede abordar, y termina con los aspectos léxicos.

Las normas que se aplican en el programa están tomadas de manuales, diccionarios y otras obras de referencia que indican aspectos normativos de la escritura en general y de la escritura académica en particular -Cassany (1995), Gómez Torrego (2011) o Montolío (2014) son algunas de ellas-. Estas obras son consulta recurrente en las aulas universitarias del ámbito panhispánico, forman parte de la bibliografía básica de numerosas asignaturas de redacción en la PUCV, y el programa facilita su uso y comprensión, además de proporcionar la referencia bibliográfica concreta relacionada con un error específico detectado (a modo de ejemplo, ver Figura 1).

4.2.1. Detección de la lengua del texto de entrada

Debido a que Estilector por el momento solo funciona en castellano, resulta necesario asegurarse, como primera medida, que el texto de entrada está en esta lengua. Caso contrario, el sistema despliega un mensaje de error indicando el hecho, y el proceso se detiene.

Para el desarrollo del detector de lengua nos basamos en Linguini (http://www.tecling.com/linguini), un sistema de creación propia para la detección de la lengua principal de un texto, así como de fragmentos en otras lenguas dentro de un texto escrito en una lengua principal. Este sistema está basado en una biblioteca de muestras de texto de medio centenar de lenguas, aquellas con mayor presencia internacional. Por medio de un cálculo de similitud, compara y detecta la intersección de vocabulario entre el texto analizado y las muestras, señalando así la lengua más probable.

Una vez detectada la lengua principal del texto, el sistema analiza cada párrafo del texto con el fin de detectar fragmentos en una lengua distinta a la principal. Este sería el caso, por ejemplo, del resumen redactado en inglés en el caso de artículos científicos en castellano, entre otros. Gracias a este sistema, si Estilector detecta que un párrafo está en otra lengua, lo señala, pero no hace correcciones en dicho párrafo, ya que se entiende que las reglas del sistema están concebidas únicamente para el castellano.

La eficacia de la clasificación por lenguas es casi del 100% suponiendo que los textos analizados tienen un tamaño suficiente, con un mínimo de aproximadamente 400 palabras de extensión. La clasificación es menos confiable cuando se clasifican textos de menor tamaño.

4.2.2. Análisis textual

El análisis textual contempla, por el momento, aspectos vinculados con la estructura de títulos y párrafos, y la puntuación. Así pues, entre las primeras rutinas de análisis del programa se presenta el control del formato del título y estructura del párrafo. Aquí se aplican reglas como controlar que no existan títulos con punto final. En este caso, el desafío es cómo detectar títulos y subtítulos en el texto. La característica de un buen título es que resuma la idea del texto, pero computacionalmente esto no es sencillo de determinar, y por ello este aspecto continúa en desarrollo. Otras cuestiones relacionadas con el párrafo es la prevención del párrafo-frase (es decir, un párrafo formado por una sola frase), la ausencia de punto final a la frase, entre otras como la extensión excesiva de oraciones o párrafos.

En cuanto a los aspectos vinculados con la puntuación, se corrigen aspectos como el signo de interrogación o exclamación seguido de punto o el uso de mayúsculas después de signos distintos al punto (coma, punto y coma, dos puntos); el uso de paréntesis, corchetes o llaves de apertura sin espacio o, a la inversa, si existe espacio incorrecto entre una palabra y signo de puntuación; conector seguido de dos puntos; espacio entre palabra y signo de puntuación; paréntesis sin espacio; punto antes del cierre de comillas, uso de doble espacio, etc. Al detectar errores de este tipo, el sistema da el aviso e indica cuál debería ser la forma correcta en ese contexto.

4.2.3. Algunos aspectos gramaticales y léxicos

El sistema detecta también algunos aspectos vinculados con la gramática. Detecta cuando algunos verbos se escriben sin la preposición del complemento de régimen y contiene además un registro de expresiones o locuciones comúnmente utilizadas en la escritura académica (como por ejemplo, caer en la cuenta de, a causa de, en relación con, dar la impresión de, con base en, etc.). Gracias a este registro, el programa detecta variaciones en estos patrones cuando van más allá de la conjugación del verbo, tales como la omisión o intercambio de una preposición u otro elemento, dando el aviso correspondiente. Además de los ejemplos correctos, el programa posee también un registro de construcciones inadecuadas que se encuentran frecuentemente en textos (variantes incorrectas de las anteriores o bien otras como jugar un papel, secuencias como en contra/en frente + posesivo, entre otras), además de otros patrones gramaticales considerados incorrectos, como pronombre relativo precedido de un artículo, quesuismo, queísmo, dequeísmo, etc.

Las reglas vinculadas con el vocabulario son muy específicas. El sistema señala algunas palabras excesivamente genéricas (como cosa, ver, hacer, importante, etc.), cuyo uso resulta inapropiado en los textos académicos ya que pueden ser muy vagas o imprecisas. En esos casos, el programa sugiere otros elementos léxicos con los que se podría sustituir la palabra detectada según el contexto.

Otra regla ofrece el control de la repetición de palabras. Este es uno de los temas en que no es posible señalar que sea incorrecto gramaticalmente, sino que es más bien conveniente evitar la repetición de palabras cercanas en el texto porque atenta contra la riqueza léxica. Este aspecto del léxico está vinculado en realidad con la dimensión textual-discursiva del escrito.

4.2.4 Módulos actualmente en desarrollo

En el momento de redactar este artículo estamos poniendo a prueba una nueva serie de módulos que proyectamos incorporar a la brevedad. Entre otras ideas, estamos incorporando un módulo de clasificación de textos por género, ya que para los objetivos del programa es fundamental enfocar la revisión en función del género del texto analizado. En función del género pretendemos llegar también a un grado de análisis superestructural, en que también se detecten elementos tales como título, subtítulos, metadatos, pie de figuras y tablas, secciones y referencias bibliográficas. Sobre este, a su vez, planeamos alcanzar un análisis macroestructural del texto, donde además se haga un mejor barrido de elementos extraoracionales tales como los marcadores discursivos.

En paralelo, nos encontramos afinando también el sistema de corrección ortográfica de Estilector, para lo cual nos basamos fundamentalmente en análisis estadístico tomando como corpus de referencia los listados de enegramas de Google Books (Michel et al., 2010). Con base en ese mismo material, pretendemos luego implementar un mejor detector de errores gramaticales en la línea de una investigación anterior (Nazar & Renau, 2012), en la que se detecta la secuencia infrecuente de palabras frecuentes. Por último, estamos experimentando actualmente con el análisis de la subjetividad del vocabulario, utilizando un léxico de polaridad que marca las palabras como positivas o negativas (ej., afortunadamente, desgraciadamente), para fomentar la objetividad que es propia de la escritura académica (Montolío, 2000).

5. Resultados y discusión

En este apartado, presentamos una evaluación humana experta del programa. En concreto, se revisó el desempeño del software en 10 trabajos académicos de asignaturas de Literatura y Lingüística de la carrera de Castellano y Comunicación de la PUCV, libremente escogidos y entregados por sus autores, y que corresponden al género ensayo. A modo orientativo, se revisó también el desempeño de los mismos textos por parte de Word y Google Docs, los dos procesadores de textos más populares entre los estudiantes. Esto no se realizó para comparar la precisión de los tres sistemas, porque los estudiantes habían producido los textos en alguno de los dos procesadores, lo que significa que habían tenido acceso a las correcciones proporcionadas por uno de los dos programas, o por ambos. Sin embargo, dado que la meta de Estilector es complementar las correcciones de un procesador de textos, el objetivo de la evaluación era valorar la cantidad y calidad de las revisiones suplementarias que el programa podía ofrecer. En todos los casos se evaluaron aspectos que al menos uno de los programas sí detecta, y se dejaron de lado posibles correcciones que quedan fuera del alcance de los tres sistemas, como aspectos relacionados con el contenido del texto, errores conceptuales, omisiones bibliográficas, etc.

Se evaluaron las siguientes dimensiones: aspectos textuales-discursivos (texto), puntuación (se consideró independientemente porque está a medio camino entre la ortografía y los aspectos textuales-discursivos), léxico, gramática, referencias (bibliográficas) y otros casos (ej., cadenas de palabras incorrectas). Se indicó “Correcto” cuando el programa evaluado detectaba correctamente un error y, en tal caso, si los otros dos programas no lo detectaban o su revisión era incorrecta, se indicaba “Incorrecto”. Se reservó “No detectado” como una indicación neutra cuando un programa no había detectado algo que otro programa había detectado incorrectamente (y, por tanto, no se lo penalizó en la evaluación). Ello significa que las indicaciones “Incorrecto” y “No detectado” son excluyentes. De este modo, se evaluó la precisión de Estilector en las mencionadas dimensiones, y se deja para trabajo futuro la evaluación de la cobertura, que es una medición más compleja que requiere de otro diseño y sobrepasa los objetivos del presente trabajo.

En total, los tres programas proporcionaron 189 propuestas de revisión, aunque en el recuento se omitió la ortografía porque en el corpus se produjeron insuficientes casos para una estadística (n = 5). El resto (184 propuestas subdivididas en seis tipos) se presentan en la Tabla 2.

Fuente: Elaboración propia.

La Tabla 3 muestra los resultados de la evaluación desagregados por cada dimensión, y, al final de la tabla, el total de casos correctos, incorrectos y no detectados de cada programa.

Fuente: Elaboración propia.

Los datos muestran desempeños desiguales según la dimensión, en términos de número de indicaciones y de porcentaje de estas correctamente realizadas por el software. Estilector tiene un desempeño muy bajo en las correcciones gramaticales, referencias bibliográficas y “otros”. En el primer caso, el programa aún no tiene implementada una revisión gramatical exhaustiva (por ejemplo, no tiene incorporado un etiquetador morfosintáctico), de modo que solo corrige aspectos muy puntuales de la gramática. En el caso de las referencias bibliográficas, estas se basan en el modelo APA y, claramente, el algoritmo no responde bien a la creatividad con que los estudiantes modifican estas pautas. Ambas dimensiones las consideramos importantes en un software de apoyo a la escritura académica, y los datos indican que debe trabajarse para mejorar estas cifras. Ahora bien, el desempeño de Word y Google Docs en la corrección gramatical (no corrigen referencias) es solo un poco mejor, con abundantes casos incorrectos. El apartado “Otros” está compuesto exclusivamente por cadenas de palabras incorrectas que detecta Google Docs, probablemente gracias a su enfoque de machine learning (es decir, a través del cómputo de enormes cantidades de correcciones humanas realizadas en el programa, que se utilizan para entrenar los algoritmos de revisión); ej., “a lo largo de historia literaria” (por “a lo largo de la historia literaria”). Se trata de correcciones que Estilector no está preparado para hacer y no se espera una mejora al respecto en el corto plazo. La precisión debe mejorar también a la hora de detectar errores de puntuación. Por ejemplo, al no incorporar el parser sintáctico, no puede detectar la coma entre sujeto y verbo que, en algunos casos, sí detectan los otros dos programas: ej., “El existencialismo, intenta evaluar…” (esta coma incorrecta es detectada por Word y Docs pero no por Estilector). Estilector realiza correctamente un 61,90% de las revisiones de aspectos léxicos, lo que supone una precisión que es necesario mejorar, pero supera en mucho a la de los otros dos programas. Ej., en el fragmento “Las metáforas cumplen un rol sumamente importante en el poema…”, se sugiere al estudiante:

En este fragmento se utilizan algunas unidades demasiado genéricas como importante, que se pueden sustituir por otras más concretas semánticamente, como considerable, conveniente, enorme, fundamental, notable, primordial, significativo, sustancial, trascendental, valioso, vital, etc. (concretar según el contexto).

- - - - - - - - - - - - -

Más información:

- VV. AA. (2005). Diccionario de sinónimos y antónimos. Madrid: Espasa-Calpe.

En este caso, el estudiante puede, por ejemplo, sustituir el adjetivo genérico importante por significativo o trascendental.

En la dimensión textual-discursiva, Estilector ofrece 82 (88,17%) de revisiones correctas. Es una cifra positiva tanto en la cantidad de revisiones ofrecidas como en su precisión, y muestra que el objetivo principal del programa, que es justamente ofrecer este tipo de feedback, se cumple. Muchas de ellas corresponden a varias palabras repetidas en el mismo párrafo (estos casos se contaron como una sola revisión). Ej., “Interpretar la portada del cuento, para inferir la trama del cuento”. En casos como este, el programa señala:

Hay expresiones repetidas en un fragmento breve del texto. Para obtener la riqueza léxica requerida, deja dicha expresión o secuencia como está una vez y cambia el resto por una equivalente.

- - - - - - - - - - - - -

Más información:

- VV. AA. (2005). Diccionario de sinónimos y antónimos. Madrid: Espasa-Calpe.

- Cassany, D. (1997). La cocina de la escritura. Barcelona: Anagrama, p. 141. “Las reglas: 1. No repetir”.

La detección de palabras que se repiten en el mismo caso en algunos párrafos puede ser un recurso retórico que fomente la claridad expositiva, pero en general afecta a la riqueza léxica, que es un objetivo de aprendizaje importante en un aprendiz de cualquier nivel. En esta dimensión, también son frecuentes las indicaciones sobre la coincidencia de una sola frase como contenido total del párrafo, lo que afecta negativamente a la cohesión textual.

En total, Estilector realiza 114 (61,96%) revisiones correctas, lo que es una cifra que, si bien es mejorable, también es prometedora al ofrecer una alta precisión en aspectos textuales (88,17%). Así pues, esta evaluación muestra los aspectos mejorables del programa, pero también su potencial como complemento de los procesadores de texto utilizados habitualmente por los estudiantes.

6. Conclusiones y trabajo futuro

El programa de trabajo que se planea en el corto plazo se relaciona con adecuar Estilector a las necesidades de estudiantes y profesores de enseñanza superior. Se prevén, al menos, las siguientes líneas de trabajo:

-

Estilector como apoyo a la evaluación de la escritura. Es necesario incorporar módulos que permitan que el programa pueda ser usado como un apoyo a la evaluación formal de tareas de escritura en las universidades, para que el programa sea más efectivo como herramienta de apoyo al aprendizaje de la escritura (Conijn et al., 2020). Ello implica, al menos, tener en cuenta la variable de género discursivo, ofrecer al profesor y al alumno un resumen cuantitativo y cualitativo del desempeño de este último o que el profesor pueda añadir comentarios al feedback que el programa proporciona de manera automática.

-

Incorporación de usuarios de distintos tipos. En línea con lo anterior, Estilector se proyecta como una herramienta que asume que escribir siempre es una actividad, en mayor o menor medida, colectiva, en tanto que el escritor consulta, da a leer y es evaluado por otros (Hayes, 2012). Por ese motivo, proyectamos que al programa se acceda mediante usuario al que pueda asignarse varias funciones, ej., tutor o alumno.

-

Mejora de la precisión de la herramienta. La evaluación expuesta en el apartado 4 ofrece pistas acerca de los aspectos que deben mejorarse del programa y, en conjunto con las líneas de trabajo ya abiertas (ver apartado 4.2.4), ofrece un buen punto de partida para la mejora de la precisión del programa.

Referencias

Allen, L. K., Jacovina, M. E., & McNamara, D. S. (2016). Computer-based writing instruction. En Ch. A. MacArthur, S. Graham & J. Fitzgerald (Eds.), Handbook of Writing Research (2.ª ed., pp. 310-329). Guilford Press.

Álvarez Angulo, T., Mateo Girona, T., Serrano Almodóvar, M. P., & González Serrano, M. Á. (2015). Diseño de la plataforma RedacText 2.0 para ayudar a escribir textos académicos e investigar sobre enseñanza y aprendizaje de la escritura. Revista Complutense de Educación, 26(2), 425-445. https://doi.org/10.5209/rev_RCED.2015.v26.n2.43359

Atserias, J., Fuentes, M., Nazar, R., & Renau, I. (2012). Spell checking in Spanish: the case of diacritic accents. En N. Calzolari et al. (Eds.), Proceedings of the Eight International Conference on Language Resources and Evaluation (LREC’12) (pp. 737-742). European Language Resources Association.

Bañales, G., Ahumada, S., Martínez, R., Martínez, M., & Messina, P. (2018). Investigaciones de la escritura en la Educación Básica en Chile: revisión de una década (2007-2016). Revista de Lingüística Teórica y Aplicada, 56(1), 59-84. https://doi.org/10.4067/S0718-48832018000100059

Bereiter, C., & Scardamalia, M. (1987). The Psychology of Written Composition. Erlbaum.

Brand, A. (1987). The why of cognition: emotion and the writing process. College Composition and Communication, 38(4), 436-443. https://doi.org/10.2307/357637

Cassany, D. (1995). La cocina de la escritura. Anagrama.

Castro, A. (2023). Hacia la detección automática de circunloquios verbales que afectan la concisión de textos académicos producidos por estudiantes de Ingeniería Civil Informática [Tesis de magíster, Pontificia Universidad Católica de Valparaíso].

Chen, H.-J. H., Lai, S.-L-., Lee, K.-Y., & Yang, C. T.-Y. (2021). Developing and evaluating an academic collocations and phrases search engine for academic writers. Computer Assisted Language Learning. https://doi.org/10.1080/09588221.2021.1937229

Chukharev-Hudilainen, E., & Saricaoglu, A. (2016). Causal discourse analyzer: improving automated feedback on academic ESL writing. Computer Assisted Language Learning, 29(3), 494-516. https://doi.org/10.1080/09588221.2014.991795

Conijn, R., Martínez-Maldonado, R., Knight, S., Buckingham Shum, S., Van Waes, L., & Van Zaanen, M. (2020). How to provide automated feedback on the writing process? A participatory approach to design writing analytics tolos. Computer Assisted Language Learning. https://doi.org/10.1080/09588221.2020.1839503

Da Cunha, I. (2020). Una herramienta TIC para la redacción del Trabajo de Fin de Grado (TFG). ELUA, 34, 39-72. https://doi.org/10.14198/ELUA2020.34.2

Dale, R., & Viethen, J. (2021). The automated writing assistance landscape in 2021. Natural Language Engineering, 27(4), 511-518. https://doi.org/10.1017/S1351324921000164

De Smet, M. J. R., Leijten, M., & Van Waes, L. (2018). Exploring the process of reading during writing using eye tracking and keystroke logging. Written Communication, 35(4), 411-447. https://doi.org/10.1177/0741088318788070

Ferraro, G., Nazar, R., Alonso-Ramos, M., & Wanner, L. (2014). Towards advanced collocation error correction in Spanish learner corpora. Language Resources and Evaluation, 48, 45-64. https://doi.org/10.1007/s10579-013-9242-3

Flower, L. (1994). The Construction of Negotiated Meaning A Social Cognitive Theory of Writing. University of Southern Illinois Press. https://doi.org/10.2307/358881

Flower, L., & Hayes, J. (1981). A cognitive process theory of writing. College Composition and Communication, 32(4), 365-387. https://doi.org/10.2307/356600

Gómez Torrego, L. (2011). Hablar y escribir correctamente (4.ª ed.). Arco Libros.

Graham, S. (2018). A revised writer(s)-within-community model of writing. Educational Psychologist, 53(4), 258-279. https://doi.org/10.1080/00461520.2018.1481406

Graham, S. (2019). Changing how writing is taught. Review of Research in Education, 43(1), 277-303. https://doi.org/10.3102/0091732X18821125

Hayes, J. (1996). A new framework for understanding cognition and affect in writing. En C. M. Levy & S. Ransdell (Eds.), The Science of Writing: Theories, Methods, Individual Differences, and Applications (pp. 1-27). Erlbaum.

Hayes, J. (2012). Modeling and remodeling writing. Written Communication, 29(3), 369-388. https://doi.org/10.1177/0741088312451260

Hayes, J., & Flower, L. (1980). Identifying the organization of writing processes. En L. Gregg & E. Steinberg (Eds.), Cognitive Processes in Writing: An Interdisciplinary Approach (pp. 3-30). Erlbaum.

Hayes, J., & Olinghouse, N. G. (2015). Can cognitive writing models inform the design of the common core state standards? Elementary School Journal, 115(4), 480-497. https://doi.org/10.1086/681909

Kellogg, R. T. (1994). The Psychology of Writing. Oxford University Press.

Lea, M. R., & Street, B. V. (2006). The “Academic Literacies” Model: theory and applications. Theory Into Practice, 45(4), 368-377. https://doi.org/10.1207/s15430421tip4504_11

Link, S., Mehrzad, M., & Rahimi, M. (2020). Impact of automated writing evaluation on teacher feedback, student revision, and writing improvement. Computer Assisted Language Learning, 35(4), 605-634. https://doi.org/10.1080/09588221.2020.1743323

López-Ferrero, C., Nazar, R., Renau, I., & Torner, S. (2014). Computer-assisted revision in Spanish academic texts. Procedia. Social and Behavioral Sciences, 141, 470-483. https://doi.org/10.1016/j.sbspro.2014.05.083

McCarthy, K. S., Roscoe, R. D., Allen, L. K., Likens, A. D., & McNamara, D. S. (2022). Automated writing evaluation: Does spelling and grammar feedback support high-quality writing and revision? Assessing Writing, 52, 100608. https://doi.org/10.1016/j.asw.2022.100608

Michel, J.-B., Shen, Y. K., Aiden, A. P., Veres, A., Gray, M., Pickett, J. P., . . . Aiden, E. L. (2010). Quantitative analysis of culture using millions of digitized books. Science, 331(6014), 176-182. https://doi.org/10.1126/science.1199644

Montolío, E. (Ed.). (2000). Manual práctico de escritura académica. Ariel.

Montolío, E. (Dir.ª). (2014). Manual de escritura académica y profesional. Ariel.

Navarro, F. (2019). Más allá de la alfabetización académica: las funciones de la escritura en educación superior. Leer, Escribir y Descubrir, 1(9), 38-56.

Nazar, R., & Renau, I. (2012). Google Books N-gram Corpus used as a Grammar Checker. Proceedings of the Second Workshop on Computational Linguistics and Writing (CL&W 2012): Linguistic and Cognitive Aspects of Document Creation and Document Engineering (pp. 27-39). Association for Computational Linguistics.

O’Hara, K., Taylor, A., Newman, W., & Sellen, A. J. (2002). Understanding the materiality of writing from multiple sources. International Journal of Human-Computer Studies, 56, 269-305. https://doi.org/10.1006/ijhc.2001.0525

Pontificia Universidad Católica de Valparaíso. (2022). Modelo Educativo. https://www.pucv.cl/uuaa/site/edic/base/port/modelo_educativo.html

Rohman, D. G. (1965). Pre-writing: The stages of discovery in the writing process. College Composition and Communication, 16, 106-111. https://doi.org/10.2307/354885

Shriver, K. (2012). What we know about expertise in professional communication. En V. W. Berninger (Ed.), Past, Present, and Future Contributions of Cognitive Writing Research to Cognitive Psychology (pp. 275-312). Psychology Press.

Sologuren, E. (2020). Prácticas de escritura en la Universidad: Géneros de formación académica en la carrera de ingeniería civil informática [Tesis doctoral, Pontificia Universidad Católica de Valparaíso]. Catálogo de Recursos Bibliográficos PUCV. https://catalogo.pucv.cl/cgi-bin/koha/opac-main.pl

Strobl, C., Ailhaud, E., Benetos, K., Devitt, A., Kruse, O., Proske, A., & Rapp, C. (2019). Digital support for academic writing: A review of technologies and pedagogies, Computers & Education, 131, 33-48. https://doi.org/10.1016/j.compedu.2018.12.005

Thaiss, C., & Zawacki, T. (2006). Engaged Writers and Dynamic Disciplines: Research on the Academic Writing Life. Boynton/Cook.

Williams, C., & Beam, S. (2019). Technology and writing: Review of research. Computers & Education, 128, 227-242. https://doi.org/10.1016/j.compedu.2018.09.024

Author notes

(*) Autor para correspondencia: Rogelio Nazar. Pontificia Universidad Católica de Valparaíso, Brasil 2950, Valparaíso. Correo de contacto: rogelio.nazar@pucv.cl