Comunicaciones

ANÁLISIS ESTRUCTURAL DEL CONOCIMIENTO DIDÁCTICO DEL CONTENIDO CIENTÍFICO ESCOLAR EN FUTUROS MAESTROS DE PRIMARIA

STRUCTURAL ANALYSIS OF PRE-SERVICE TEACHERS’ PEDAGOGICAL CONTENT KNOWLEDGE ON PRIMARY SCHOOL SCIENCE

UMA ANÁLISE ESTRUTURAL DO CONHECIMENTO DIDÁTICO DO CONTEÚDO EM CIENCIAS NO FUTUROS PROFESSORES DO ENSINO PRIMÁRIO

ANÁLISIS ESTRUCTURAL DEL CONOCIMIENTO DIDÁCTICO DEL CONTENIDO CIENTÍFICO ESCOLAR EN FUTUROS MAESTROS DE PRIMARIA

Interciencia, vol. 42, núm. 7, pp. 446-450, 2017

Asociación Interciencia

Recepción: 12 Julio 2016

Aprobación: 07 Julio 2017

Resumen: El Conocimiento Didáctico del Contenido (CDC) en ciencias es el conocimiento profesional específico de un profesor que lo caracteriza y lo diferencia de otro profesional formado en ciencias. La investigación desarrollada a nivel internacional los últimos años muestra variedad en su definición por expertos y en su composición. Esa variedad ha dado lugar a una multiplicidad de instrumentos diseñados para su evaluación. Parece conveniente explorar si tras dicha variedad subyace una estructura conceptual estable para el CDC de ciencias que pueda revelarse a partir de indicadores empíricos, confirmando o refutando los variados criterios expertos. Dada la complejidad del constructo, conviene considerar situaciones acotadas y simplificadas. Por ello, el presente trabajo analiza la posible estructura del CDC de ciencias que muestran los futuros maestros escolares antes de adquirir experiencia profesional. Dos estudios independientes fueron desarrollados con sendas muestras de maestros de primaria en formación inicial en dos años distintos. El CDC en ciencias escolares fue evaluado mediante CoRe, un instrumento utilizado internacionalmente para ese fin. Los resultados del análisis de estructura muestran una estructura estable subyacente, con dos factores asociados con ‘análisis didáctico’ y ‘acción didáctica’, respectivamente. Las relaciones obtenidas entre componentes del CDC en ciencias fueron conceptualmente similares a las observadas en estudios empíricos anteriores.

Palabras clave: Análisis Estructural, Conocimiento Didáctico del Contenido, Educación Científica, Formación de Profesores de Ciencias.

Abstract: Pedagogical Content Knowledge (PCK) in science is the specific professional knowledge of a teacher, which characterizes and differentiates this type of professional from other science-based professionals. Recent research at an international level shows certain diversity in its definition by experts and also in their suggested composition. This diversity has generated a multiplicity of instruments for assessing PCK. It seems convenient to explore whether or not this variety of proposals hides a convergent underlying and steady structure. If this conceptual structure existed, it could be revealed in empirical studies, confirming or rejecting experts’ criteria. As the construct of PCK is so complex, simplified situations should be considered first. Therefore, the present study analyses the possible underlying structure of PCK in elementary science shown by primary school teachers prior to acquiring professional expertise. Two independent studies were conducted in different years with pre-service primary school teachers. PCK in elementary science was assessed with CoRe, an instrument used in many international studies. Results show a steady bi-factorial structure grouping ‘instructional analysis’ (factor 1) and ‘instructional action’ (factor 2) components. Between-component relationships were conceptually analogous to those observed in previous empirical studies.

Resumo: O Conhecimento Didático do Conteúdo (CDC) em ciência é o conhecimento profissional específico que caracteriza a um professor e o torna diferente dos outros profissionais formados em ciência. Pesquisas desenvolvidas nos passados anos mostram a variedade em a sua definição por especialistas, e em a sua composição. Esta variedade tem resultado em uma multiplicidade de instrumentos concebidos para a sua avaliação. Parece oportuno explorar se após esta variedade, encontra-se uma estrutura conceitual estável do CDC na ciência que pode revelar-se em estudos empíricos, confirmando ou refutando os critérios de peritos. Dada a complexidade da construção, deve ser limitado e situações simplificada. Portanto, este artigo analisa a estrutura possível da ciência escola CDC mostrando futuros professores antes de adquirir experiência profissional. Dois estudos independentes foram desenvolvidos com amostras individuais de professores do ensino primário na formação inicial em dois anos diferentes. O CDC na ciência escola foi avaliada por Kore, um instrumento utilizado em estudos internacionais. Os resultados da análise mostram estrutura estável estrutura subjacente com dois factores associados com ‘análise formação’ e ‘acção de ensino’ respectivamente. As relações entre os componentes CDC ciência obtidos foram conceptualmente semelhante aos observados em estudos empíricos anteriores.

Introducción

El Conocimiento Didáctico del Contenido en ciencias (CDC) es el tipo de conocimiento que distingue a un profesor de un científico. En su núcleo está la manera en que transforma los contenidos científicos para enseñarlos (Shulman, 1987). De la importancia del CDC da idea el abundante número de artículos publicados sobre dicho constructo desde la década de los 90, aparecidos en revistas de alto índice de impacto en educación (Hashweh, 2005; Abell, 2008; Park y Oliver, 2008; Kind, 2009).

Los investigadores en el campo educativo han utilizado el CDC como un objeto conceptual útil, tanto para mejorar al profesorado en activo como para formar a los futuros profesores. Sin embargo, el CDC es un conocimiento tácito (Kind, 2009) y, consecuentemente, difícil de determinar. Sin embargo, establecer qué elementos hacen que un profesor sea más eficiente que otros ayudaría a mejorar la alfabetización científica en la sociedad.

Aunque el concepto es aceptado por la comunidad científica, su definición no muestra aún total convergencia. Prueba de ello son las variadas definiciones del CDC que han sido propuestas (Magnusson et al., 1999; Loughran et al., 2001; Hashweh, 2005; Ball et al., 2008; Park y Oliver, 2008). También hay variabilidad en las propuestas para la operativización del concepto, concebido como un conjunto de componentes en interacción (Grossman, 1990; Marks, 1990; Van Driel et al., 1998; Magnusson et al., 1999; Park y Oliver, 2008). Entre esos componentes, generalmente se propone conocimiento sobre el currículum, sobre los estudiantes, orientaciones para la enseñanza de las ciencias, conocimiento sobre estrategias instruccionales y sobre evaluación. A partir de las diversas concepciones operacionales han surgido variados instrumentos para su evaluación: cuestionarios de lápiz-y papel (Mavhunga y Rollnick, 2011), entrevistas individuales (Park y Chen, 2012) y mixtos (Morrison y Luttenegger, 2015).

El propósito del presente trabajo es indagar si más allá de la multiplicidad de propuestas para definir y operacionalizar el CDC, sugeridas por criterios expertos, se oculta una estructura estable (relaciones entre componentes) identificable a partir de indicadores empíricos. Si diferentes estudios empíricos replicasen una misma estructura en este constructo, éste se podría considerar válido más allá de los instrumentos usados para su medición y evaluación. En ese caso, los esfuerzos podrían concentrarse en los aspectos subyacentes más fundamentales. Algunos trabajos precedentes han obtenido evidencias de interacciones entre componentes del CDC (Kaya, 2009; Padilla y van Driel, 2011; Park y Chen, 2012; Aydin y Boz, 2013), lo que apoyaría la existencia del constructo CDC, pero sin definir con claridad su estructura subyacente.

Dada la complejidad del CDC en ciencias, manifestada por la cantidad de componentes que se asocian con él, parece conveniente comenzar por considerar situaciones simplificadas. En este trabajo nos centraremos en el CDC en ciencias elementales que manifiestan los maestros de primaria en formación inicial. Por tanto, no consideraremos la aportación de la experiencia profesional, que se sumaría como factor adicional en estudios posteriores.

Metodología

Se desarrollaron dos estudios empíricos independientes con el fin de evaluar componentes del CDC en ciencias de maestros escolares en formación inicial, establecer su posible estructura subyacente y estudiar la estabilidad de la misma.

Muestras

Ambas muestras se formaron a partir de grupos intactos de estudiantes de Magisterio, tras su formación en contenido en ciencias, en didáctica de las ciencias experimentales y en didáctica general. La primera muestra se compuso de 185 sujetos de ambos sexos con un promedio de edad de 20,3 años. Un total de 56 sujetos de similares características, con una edad promedio de 20,1 años, participaron en el estudio 2.

Instrumentos y medidas

Uno de los instrumentos más sencillos y fáciles de aplicar para evaluar el CDC es el CoRe (Eames et al., 2011). Este instrumento muestra un fenómeno o situación del mundo natural típica del estudio de las ciencias y, a partir de ella, propone preguntas abiertas relacionadas con componentes propios del CDC. La relevancia creciente de CoRe en la investigación queda ref lejada en el gran número de trabajos que lo han empleado desde su aparición (Bertram y Loughran, 2012; Chapoo et al., 2014; Alvarado et al., 2015), también en contextos de habla hispana (Brines et al., 2016).

En este trabajo se utilizó una adaptación del instrumento a maestros de primaria españoles, donde las preguntas para los componentes quedaron formuladas del siguiente modo (muy similar al original):

- 1.

1) ¿Qué intentarías que los niños aprendiesen sobre esta situación particular (objetivos)?

2) ¿Por qué crees importante que los estudiantes aprendan lo que has expuesto anteriormente (relevancia del tema o situación)?

3) ¿Conoces las posibles dificultades de aprendizaje de los niños o sus ideas alternativas sobre esta situación?

4) ¿Conoces las dificultades o limitaciones en la enseñanza de los aspectos mencionados antes?

5) ¿Qué metodología de enseñanza utilizarías para obtener un mayor aprendizaje de los estudiantes en el caso planteado? ¿Qué actividades concretas plantearías?

6) ¿Cómo evaluarías si los estudiantes han alcanzado realmente los objetivos planteados al principio?

El participante debe escribir todo cuanto sepa para responder, siempre respecto a la situación propuesta al comienzo. Cada uno de los seis aspectos se puntuó del modo más sencillo posible. Por cada idea completa relacionada con el aspecto didáctico preguntado se asignó 1 punto. Por cada idea incompleta pero correcta se asignó 0,5 puntos. La puntuación total en cada apartado fue la suma de todas las ideas puntuadas. No se limitó el máximo valor para cada apartado ni se hizo ponderación alguna entre apartados.

El instrumento CoRe presenta una clara limitación: explora el CDC de una situación científica particular. El conocimiento previo de los sujetos sobre la situación concreta planteada podría dar lugar a diferencias importantes en sus respuestas. Con el fin de que se pudieran manifestar los efectos sobre la posible estructura del CDC debidos al mayor o menor conocimiento previo, en el segundo estudio se propusieron situaciones mejor conocidas por los participantes (mayor conocimiento previo: flotación; fases de la luna) que en el estudio 1 (menor conocimiento previo: órbita de la Luna; combustión de alcohol). Si la hipotética estructura subyacente del CDC cambiase por esta razón, no podríamos aceptarla como válida, pues estaría asociada fuertemente a temas concretos.

Procedimiento

Tras solicitar y obtener los permisos oportunos, se acudió a cada grupo intacto en horario de clase normal. Se informó que la participación era voluntaria y los datos destinados a mejorar la futura formación de maestros de primaria en ciencias. Se repartieron individualmente las instrucciones escritas y el instrumento en papel. En la primera página se ofrecieron opciones sobre la situación científica a trabajar, a elegir por cada participante. Se leyeron en voz alta las instrucciones sobre la tarea a realizar y se subrayó la necesidad de ajustar las respuestas a la situación científica concreta elegida. Tras resolver algunas dudas los estudiantes comenzaron la tarea. El tiempo para ejecutarla se situó típicamente entre 45 y 55min. Dos jueces puntuaron independientemente un subconjunto de 50 participantes. El valor del indicador Kappa fue 0,76.

Análisis estadísticos

Se realizó un análisis de ecuaciones estructurales utilizando el software Mplus (Muthén y Muthén, 1998-2012), utilizándose máxima verosimilitud como método de estimación. Para valorar la calidad del modelo para reproducir los datos observados se utilizaron varios indicadores (Hu y Bentler, 1999). Como índices de ajuste absoluto se utilizaron los estadísticos χ2 de Pearson y la raíz promedio de los residuos estandarizados (SRMR; Hooper et al., 2008). A su vez, se valoró el indicador RMSEA que tiene en cuenta la parsimonia del modelo y los índices comparativos CFI (Bentler, 1990) y TLI (Tucker y Lewis, 1973).

Resultados

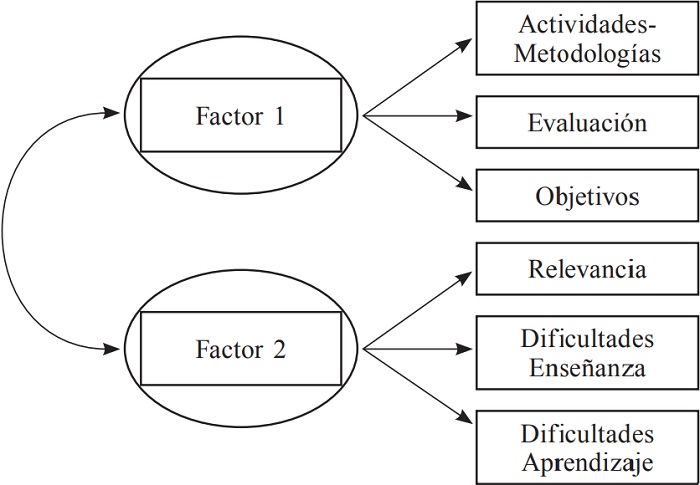

El proceso de análisis de estructura y de su estabilidad se realizó siguiendo varios pasos. Cada uno de los componentes contemplados en el instrumento CoRe (Objetivos, Relevancia, Dificultades de aprendizaje, Dificultades de enseñanza, Actividades-Metodología, Evaluación) fue considerado como una variable observada. En primer lugar, se ajustó el modelo de medida (factorial) más sencillo compatible con los datos. Está representado en la Figura 1.

Figura 1

Modelo de medida.

A continuación se probó que el modelo ajustase correctamente en ambos grupos por separado, o sea que la estructura factorial propuesta reproduzca correctamente las matrices de correlaciones de las dos muestras de estudio. Los datos mostraron un ajuste razonablemente bueno en ambos grupos: χ2(140)= 21,14, p=0,098; RMSEA= 0,065, CFI= 0,948; TLI= 0,888 y SRMR= 0,042, con 14 grados de libertad iniciales= 54 parámetros observados (6 varianzas + 15 covarianzas + 6 medias= 27 en cada grupo) - 40 parámetros estimados a ajustar (12 pesos factoriales, ya que 2 se fijan arbitrariamente para establecer la métrica de cada factor +12 varianzas residuales +12 interceptos +2 medias de factores y 2 correlaciones entre factores). Las medidas de ajuste indican que, conjuntamente, el modelo factorial es capaz de reproducir bien ambas matrices de correlaciones. Asumiendo la existencia de dos factores, éstos pueden dar cuenta, explicar o reproducir de forma correcta las relaciones observadas entre las variables.

Seguidamente, se ajustó el modelo que impone pesos factoriales iguales en ambas muestras de estudio. Los resultados no mostraron un desajuste significativo del modelo (ahora con 35 parámetros a ajustar): χ2 (19)= 22,25, p=0,272; RMSEA= 0,038, CFI= 0,976; TLI= 0,963 y SRMR= 0,045. La diferencia en χ2 no fue significativa entre ambos modelos: Δχ2 (5)= 1,11, p=0,953. Por lo tanto, cabe concluir que el significado de los factores fue el mismo en las dos muestras, obteniéndose una validación cruzada del modelo factorial en dos muestras distintas.

En tercer lugar se ajustó el modelo forzando que los interceptos fuesen iguales. Los resultados mostraron que ahora el modelo desajustó significativamente: χ2 (23)= 75,39, p<0,001; RMSEA= 0,137, CFI= 0,618; TLI= 0,501 y SRMR= 0,105. La diferencia en χ2 fue significativa: Δχ2(4) = 53,14, p<0,001. El desajuste se produjo porque los promedios de las variables ‘Objetivos’, ‘Actividades-Metodología’ y ‘Dificultades de Aprendizaje’ aumentaron en el segundo estudio respecto del primer estudio, mientras en las otras variables, ‘Evaluación’, ‘Relevancia’ y ‘Dificultades de Enseñanza’, los promedios fueron similares en ambos estudios.

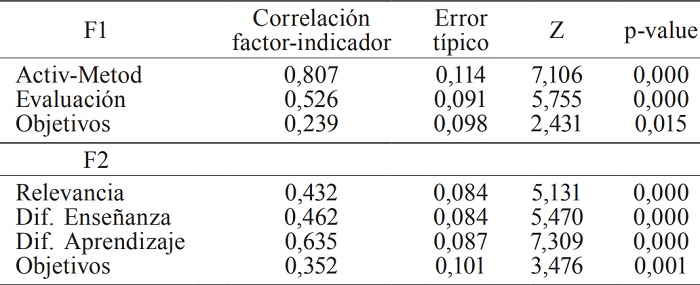

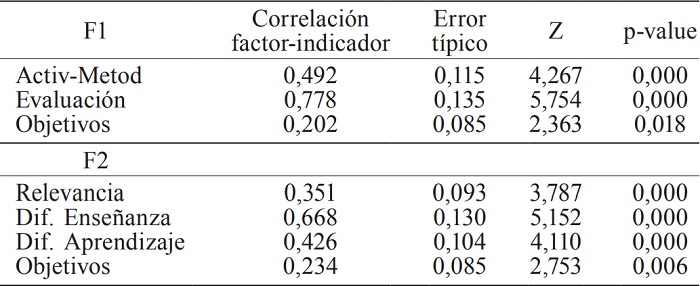

Las Tablas I y II muestran los datos de las soluciones factoriales para los estudios 1 y 2, respectivamente.

La correlación entre el Factor 1 y el Factor 2 fue de 0,385 en el estudio 1, y de 0,536 en el estudio 2, lo cual muestra que ambos factores están relacionados de forma moderadamente elevada.

En resumen, se puede aceptar un modelo de dos factores que establece pesos factoriales iguales en ambos grupos. Este es el modelo más parsimonioso que ajusta los datos.

Conclusiones

Los resultados del análisis muestran que se puede suponer en ambos estudios la misma estructura con dos factores, que ajusta correctamente los datos: el Factor 1 explicaría las puntuaciones de las variables ‘Objetivos’, ‘Actividades-Metodología’ y ‘Evaluación’; el Factor 2 explica las puntuaciones de las variables ‘Objetivos’, ‘Relevancia’, ‘Dificultades de aprendizaje’ y ‘Dificultades de enseñanza’. Los pesos factoriales se pueden asumir iguales en ambos estudios, por lo que además de mantenerse la estructura factorial, también se mantuvo la intensidad de la relación del factor con sus variables observadas. Esto sugiere que el significado de los factores no se altera en ambos estudios, además de hallarse cierta estabilidad en la estructura bifactorial encontrada, lo cual aporta solidez al modelo obtenido.

En cuanto a la interpretación del modelo, el Factor 1 revelado parece dar cuenta de aspectos asociados con ‘acción didáctica’, mientras el Factor 2 daría cuenta del ‘análisis didáctico’. La variable observada ‘Objetivos’ apareció implicada en ambos factores, algo perfectamente explicable cuando se asume que el planteamiento de objetivos educativos es el componente base y la guía tanto para el análisis como para las acciones instruccionales.

Cuando se intentó asumir la igualdad de interceptos, el modelo desajustó. Por tanto, no se puede asumir que los promedios de las diferentes variables observadas cambiasen en la misma medida al comparar los estudios 1 y 2; parece que tener menor (estudio 1) o mayor (estudio 2) dominio del contenido en ciencias sobre el CDC provoca un aumento del promedio en algunas variables observadas, pero sin alteración significativa de la estructura subyacente. En concreto, un mayor conocimiento del contenido implicó más y mejores objetivos de aprendizaje planteados, más y mejores actividades para el aprendizaje del contenido y una mejor conciencia de los posibles obstáculos de aprendizaje de los alumnos. Aunque la dependencia de la estructura del CDC con el conocimiento del contenido no puede establecerse a partir de los dos estudios implicados en este trabajo, el resultado obtenido matizaría las conclusiones de Park y Chen (2012), quienes afirmaron que la integración de componentes depende del (dominio del) tema que se trate.

Las correlaciones mayores en nuestros estudios se dieron en las parejas ‘Objetivos/Dificultades de Aprendizaje’, ‘Objetivos/Actividades-Metodología’ y ‘Dificultades de Aprendizaje/ Actividades-Metodología’. Las correlaciones menores se produjeron en las parejas ‘Relevancia/Dificultades de Enseñanza’, ‘Relevancia/Evaluación’ y ‘Dificultades de Enseñanza/ Evaluación’. Padilla y van Driel (2011) obtuvieron que ‘Orientaciones para la Enseñanza’ se vinculó con ‘Conocimiento de los Estudiantes’ y con ‘Estrategias de Enseñanza’. Si estos componentes se pudieran hacer corresponder con los componentes ‘Objetivos’, ‘Dificultades de Aprendizaje’ y ‘Actividades/Metodología’ respectivamente, tal y como se contemplan en este trabajo, entonces se podría afirmar que hay convergencia en los resultados de nuestro estudio con los de Padilla y van Driel (2011). Los componentes ‘Objetivos’, ‘Dificultades de Aprendizaje’ y ‘Actividades-Metodología’ son los que presentaron mayor vinculación global (mayor correlación promedio) con el resto de componentes, mientras ‘Dificultades de Enseñanza’, ‘Relevancia’ y ‘Evaluación’ son los que mostraron menor vinculación global, coincidiendo en estos dos últimos con lo obtenido por Aydin y Boz (2013).

En futuros estudios se intentará replicar la estructura encontrada para el CDC en ciencias básicas, y se analizará si ésta se modifica substancialmente al considerar la experiencia profesional de los maestros.

REFERENCIAS

Abell SK (2008) Twenty years later: Does pedagogical content k nowledge remain a useful idea? Int. J. Sci. Educ. 30: 1405-1416.

Alvarado C, Cañada F, Garritz A, Mellado V (2015) Canonical pedagogical content knowledge by CoRes for teaching acid-base chemistry at high school. Chem. Educ. Res. Pract. 16: 603-618.

Aydin S, Boz Y (2013) The nature of integration among PCK components: A case study of two experienced chemistry teachers. Chem. Educ. Res. Pract. 14: 615-624.

Ball DL, Thames MH, Phelps G (2008) Content Knowledge for Teaching. What makes it special? J. Teacher Educ. 59: 389-407.

Bentler PM (1990) Comparative fit indexes in structural models. Psychol. Bull. 107: 238-246.

Bertram A, Loughran J (2012) Science teachers’ views on CoRes and PaP-eRs as a framework for articulating and developing pedagogical content knowledge. Res. Sci. Educ. 42: 1027-1047.

Brines A, Solaz-Portolés JJ, Sanjosé V (2016) A comparative exploratory study of pre-service and in-service high school teachers’ pedagogical content knowledge in galvanic cells. Enseñ. Cs. 34: 107-127.

Chapoo S, Thathong K, Halim L (2014) Biology teachers’ Pedagogical Content Knowledge in Thailand: Understanding & practice. Procedia -Soc. Behav. Sci. 116: 442-447.

Eames C, Williams J, Hume A, Lockley J (2011) CoRe: A Way to Build Pedagogical Content Knowledge for Beginning Teachers. Teaching and Learning Research Initiative. Wellington. www.tlri.org.nz/sites/default/files/projects/9289_summaryreport.pdf (Cons. 10/056/2016).

Grossman PL (1990) The Making of a Teacher: Teacher Knowledge and Teacher Education. Teachers College Press. Nueva York, EEUU. 185 pp.

Hashweh MZ (2005) Teacher pedagogical constructions: a reconfiguration of pedagogical content knowledge. Teachers Teaching: Theory Pract. 11: 273-292.

Hooper D, Coughlan J, Mullen MR (2008) Structural equation modelling: Guidelines for determining model fit. J. Bus. Res. Meth. 6: 53-60.

Hu LT, Bentler PM (1999) Cutoff criteria for fit indexes in covariance structure analysis: conventional criteria versus new alternatives. Struct. Equat. Model. 6: 1-55.

Kaya ON (2009) The nature of relationships among the components of pedagogical content knowledge of pre service science teachers: ‘Ozone layer depletion’ as an exemple. Int. J. Sci. Educ. 31: 961-988.

Kind V (2009) Pedagogical content knowledge in science education: potential and perspectives for progress. Stud. Sci. Educ. 45: 169-204.

Loughran J, Milroy P, Berry A, Gunstone R (2001) Documenting science teachers’ pedagogical content knowledge through PaP-eRs. Res. Sci. Educ. 31: 289-307.

Magnusson S, Krajcik L, Borko H (1999) Nature, sources and development of pedagogical content knowledge. En GessNewsome J, Lederman NG (Eds.) Examining Pedagogical Content Knowledge. Kluwer. Dordrecht, Holanda. pp. 95-132

Marks R (1990) Pedagogical content knowledge: From a mathematical case to a modified conception. J. Teacher Educ. 41: 3-11.

Mavhunga ME, Rollnick M (2011) The development and validation of a tool for measuring topic specific pck in chemical equilibrium. Proc. ESERA Conf. 2011. Lyon, France www.esera.org/media/ebook/strand3/ebook-esera2011_MAVHUNGA-03.pdf

Muthén LK, Muthén BO (1998- 2012) Mplus User’s Guide. Los Angeles, CA, EEUU.

Morrison AD, Luttenegger KC (2015) Measuring pedagogical content knowledge using multiple points of data. Qualit. Rep. 20: 804-816.

Padilla K, Van Driel J (2011) The relationships between PCK components: the case of quantum chemistry professors. Chem. Educ. Res. Pract. 1: 367-378.

Park S, Chen Y (2012) Mapping out the integration of the components of pedagogical content knowledge (PCK): examples from high school biology classrooms. J. Res. Sci. Teach. 49: 922-941.

Park S, Oliver JS (2008) Revisiting the conceptualisation of Pedagogical Content Knowledge (PCK): PCK as a conceptual tool to understand teachers as professionals. Res. Sci. Educ. 38: 261-284.

Shulman LS (1987) Knowledge and teaching: Foundations of the new reform. Harv. Educ. Rev. 57: 1-22.

Tucker LR, Lewis C (1973) A reliability coefficient for maximum likelihood factor analysis. Psychometrika 38: 1-10.

Van Driel JH, Verloop N, De Vos W (1998) Developing science teachers’ pedagogical content knowledge. J. Res. Sci. Teach. 35: 673-695.