ALGUNOS ASPECTOS MATEMÁTICOS DE LOS SISTEMAS DE CONTROL LINEALES A TRAVÉS DE UN PROBLEMA DE OPTIMIZACIÓN

SOME MATHEMATICAL ASPECTS OF LINEAL CONTROL SYSTEMS THROUGH AN OPTIMIZATION PROBLEM

ALGUNS ASPECTOS MATEMÁTICOS DOS SISTEMAS DE CONTROLE LINEARES ATRAVÉS DE UM PROBLEMA DE OPTIMIZAÇÃO

ALGUNOS ASPECTOS MATEMÁTICOS DE LOS SISTEMAS DE CONTROL LINEALES A TRAVÉS DE UN PROBLEMA DE OPTIMIZACIÓN

Interciencia, vol. 42, núm. 9, pp. 556-562, 2017

Asociación Interciencia

Recepción: 27 Febrero 2017

Aprobación: 28 Agosto 2017

Resumen: A través de un problema específico de optimización, desarrollamos con algún detalle los principales ingredientes de la teoría matemática de los sistemas de control lineales sobre espacios euclidianos. Abordamos los conceptos de controlabilidad, observabilidad y un caso particular del Principio del Máximo de Pontryagin para esta clase de sistemas. Con los resultados establecidos, desarrollamos la solución del problema de optimización propuesto. El principal objetivo de este artículo es mostrar a la comunidad científica ciertas técnicas matemáticas que pudieran ser replicadas en distintas disciplinas de interés para los lectores de Interciencia.

Palabras clave: Funciones de Mapeo, GNSS, Posicionamiento, Retardo Troposférico.

Abstract: Through a specific optimization problem, we develop in some detail the main ingredients of the mathematical theory of linear control systems on Euclidean spaces. We address the concepts of controllability, observability and a particular case of the Pontryagin Maximum Principle for this kind of systems. With the results established, we explain how to solve the proposed problem. The main objective of this article is to show to the scientific community certain mathematical techniques that could be replicated in different disciplines of interest for Interciencia’s readers.

Resumo: Através de um problema específico de optimização, desenvolvemos com algum detalhe os principais ingredientes da teoria matemática dos sistemas de controle lineares sobre espaços euclidianos. Abordamos os conceitos de controlabilidade, observabilidade e um caso particular do Principio do Máximo de Pontryagin para esta classe de sistemas. Com os resultados estabelecidos, desenvolvemos a solução para o problema de optimização proposto. O principal objetivo deste artigo é mostrar para a comunidade científica certas técnicas matemáticas que poderiam ser replicadas em distintas disciplinas de interesse para os leitores da Revista Interciência.

Sea X una ecuación diferencial sobre un conjuntoto de estados M de dimención n y que modela un sistema físico, químico, aeroespacial, biológico, el funcionamiento de un órgano humano, la dosificación de fármacos en quimioterapia, el volumen de un bosque de pinos, una dieta alimenticia, el volumen semanal de peces en un vivero, una matriz energética, la dinámica de un móvil 1dimensional, etc. Podemos pensar esta ecuación diferencial como un conjunto de f lechas ‘definidas sobre M’ (campo de vectores), cuyas direcciones determinan las únicas posibilidades de movimiento de la dinámica. Dada una condición inicial x0 M, la única solución posible x(t) de dicha ecuación partiendo de x0 debe satisfacer la siguiente propiedad: para cada tiempo t, el vector tangente ẋ(t) a la curva en el estado x(t) debe coincidir con la dirección preestablecida por X en x(t). Un sistema de control sobre M puede modificar el comportamiento del campo de vectores X de acuerdo a diferentes estrategias denominados controles, que el sistema permite considerar. Desde un punto de vista de la geometría diferencial, un sistema de control Σ= (M,D) puede ser establecido como una familia de campos de vectores D definidos sobre M y que intervienen sobre las direcciones de X. Los elementos de D provienen de una familia de ecuaciones diferenciales controlada

donde X es el campo a controlar, los campos de vectores Yj, j=1, ..., p son definidos sobre el espacio de estados M y ponderados por la familia de controles admisibles U=Lloc1R,Ω⊂Rp(), de funciones localmente integrables a valores en el conjunto Ω cerrado, convexo con 0 intΩ. El espacio de estados M debe ser de una naturaleza tal que permita asegurar la existencia y unicidad de cada ecuación diferencial en D; esto es, para cada control u Uy para cada condición inicial x0. Entonces, M debe ser una variedad diferenciable.

Dado un sistema Σ surgen de manera natural varios problemas matemáticos interesantes y de compleja solución. El primero de ellos es: sea x0un estado inicial de M, e y M arbitrario, ¿existe una combinación de estrategias del sistema de tal modo que el estádo x0 pueda ser transferido al estado y en el sentido natural del tiempo, o sea, en un tiempo t≥0 En caso de una respuesta afirmativa, se dice que y es accesible desde x0 vía Σ. Un sistema Σ se dice controlable, si dados dos estados arbitrarios de M, cada uno de ellos es accesible desde el otro vía Σ. Obviamente, no todos los sistemas son controlables. En realidad, la propiedad de controlabilidad es muy difícil de obtener y sobre todo de caracterizar. Por ejemplo, para problemas de aplicación en donde interviene la energía calórica X, se sabe de la segunda ley de la termodinámica que X f luye solo en la dirección de decrecimiento de la temperatura. Se trata entonces de encontrar e imponer condiciones topológicas, analíticas y sobre todo algebraicas sobre M y D que permitan decidir si un cierto sistema es controlable o no.

Un sistema de control con observación es definido por la data Σ0= (M, D, h, Rs), con h: M→Rs diferenciable y s<n= dim(M).Estudiamos aquí el problema de observabilidad. Esto es, la posibilidad de determinar el comportamiento del sistema sobre M a través de una información parcial que entrega la función de observación h, con una economía del orden de ns variables. Como veremos, hay ciertas funciones de observación h que permiten recuperar la información completa del sistema, en cuanto que otras no lo hacen

Consideremos el siguiente problema de optimización: Detener un tren en una estación en tiempo mínimo. Surgen aspectos matemáticos interesantes de considerar: ¿existe solución? Y si existe, ¿cómo encontrar la estrategia óptima? Además, ¿será posible computar esta solución solo a través de h?En Ledzewicz y Shattler (2006) se estudia el siguiente problema: Controlar las dosis de quimioterapia para minimizar los daños colaterales, que es modelado como sistema de control bilineal.

La solución de los problemas de optimización mencionados depende fuertemente del Principio del Máximo de Pontryagin. Los esfuerzos del Instituto Steklov, plasmados en una serie de publicaciones, culminaron con el libro Mathematical Theory of Optimal Processes (Pontryagin et al., 1961), que es considerado un standard de la teoría del control optimal hasta los días de hoy y fue galardonado con el Premio Lenin. Los alcances de la teoría desarrollada en este libro han tenido repercusiones gigantescas. Inicialmente las aplicaciones fueron dirigidas al campo militar. Sin embargo, a poco andar estas técnicas de optimización se tornaron importantes en la aeronáutica y en una gran gama de aplicaciones industriales, siendo una muestra concreta de como la disciplina matemática ayuda a la sociedad a construir futuro.

El presente trabajo persigue dar a conocer ciertas técnicas matemáticas entre la comunidad científica de la región, a través de la exposición y desarrollo de un problema específico cuya solución se obtiene aplicando los métodos matemáticos referidos, y que pudieran ser replicadas dentro de las distintas disciplinas de interés. Tras una breve motivación que describe los problemas de aplicación mencionados y el rol de la teoría de los sistemas de control, se estudian las propiedad de controlabilidad y observabilidad para la clase de los sistemas de control lineales sobre espacios euclideanos. Luego se da una breve descripción del Principio del Máximo de Pontryagin (PMP), para terminar con la solución del problema del tren. En la lista de referencias se incluyen trabajos que pudieran servir de guía al lector interesado, incluyendo contribuciones de nuestro grupo de investigación.

Motivación

La publicación de Pontryagin et al. (1961) representa un clásico de la literatura matemática soviética. Además del inmenso caudal de investigación científica que ha generado el PMP, ha sido una fuente de aplicación en una gran variedad de disciplinas. El lector interesado puede apreciar el poder de este resultado en un número relevante de problemas que se resuelven con este principio (Dubins, 1957; Shell, 1968; Axelby, 1973; Gustavsson, 1975; Leitmann, 1982; Sussmann y Willems, 1997; Subbaram, 2002; Shattler y Ledzewicz, 2006, 2012; Pesch y Plail, 2009, 2012). En concreto, la aplicación de este principio genera en muchos casos una receta, un algoritmo preciso para sintetizar el control optimal, permitiendo su implementación como veremos en el caso del tren.

Tiempo mínimo para alcanzar un objetivo y el sistema de control asociado

Imagine el lector que dirige un tren por una línea férrea y necesita detenerlo en la próxima estación en tiempo mínimo. Considere el caso ideal sin roce de una línea férrea recta y la estación como siendo su origen. Denote por x(t) la distancia del tren a la estación en el instante t. De acuerdo a ley fundamental de Newton, la fuerza del sistema viene dada por F= ma. En este estudio cualitativo, podemos considerar m= 1. Obtenemos un sistema de ecuaciones ẋ(t)= y(t), ẏ (t)= a(t), controladas por los diferentes tipos de aceleración y freno a(t) que denotamos por u(t). Cada función de control del sistema.

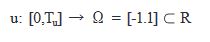

se asume localmente integrable. Aquí y es la velocidad del tren y 1 representa su velocidad máxima normalizada.

Para este problema la solución óptima existe y es posible computar en forma precisa la estrategia que determina la trayectoria de tiempo mínimo del móvil. Mostraremos además que si se conoce la función de distancias a la estación de una cierta estrategia, es posible computar explícitamente la función de velocidades asociada a esta estrategia. Sin embargo, la recíproca no es válida. O sea, no es posible recuperar las distancias si solo se conocen las velocidades involucradas. Este problema será tratado en detalles en la última sección de este trabajo.

Minimizar daños colaterales en el tratamiento de la quimioterapia

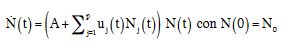

A pesar de que no será expuesto aquí en detalle, el problema tratado por Ledzewicz y Schattler (2002a, b; 2006) en relación a la quimioterapia en cáncer es descrito para mostrar como la teoría de control aparece de manera natural en problemas de aplicación relevantes y por que, además, cabría ser desarrollado con algún detalle en un trabajo futuro. Los autores proponen un sistema bilineal ndimensional compartimental del tipo

Las componentes N(t) del estado N= (N1, N2, ..., Np) en el instante t, denotan el número promedio de células cancerosas en el compartimiento respectivo. Los controles son considerados funciones Lebesgue medibles y representan los diferentes tipos de dosis posibles de combinar con las drogas consideradas en el tratamiento. Para cada j= 1, 2, ..., p, el control uj∈ [j, j] ⊂ [0,∞) es acotado. Las matrices A y Nj describen la transición de entrada y salida del f lujo de células entre los diferentes compartimentos. Se asume que para cada control u la matriz (4) posee solo entradas negativas en la diagonal y entradas positivas fuera de la diagonal. Con esta hipótesis, se asegura que el primer ortante de Rⁿ es positivamente invariante por el f lujo del sistema. Esto es, si N0 es una condición inicial en el primer ortante, para cada control u la solución N(u, t, N0) del sistema bilineal permanecerá allí. El funcional a optimizar es

Los vectores filas r, q, s Rⁿ son considerados pesos tales que ri>0, qi≥0, Si≥0 y tal como antes u= (u1, u2, ..., up) dosifica la cantidad de cada droga. Incluir el peso promedio qN en la integral permite que la cantidad de células no crezca más allá de una cantidad aceptable. El término ‘su’ mide el efecto colateral de agentes que participen como bloqueadores o reclutadores de células latentes Obviamente, el objetivo central es que al término de la terapia se obtenga el menor número de células cancerosas y con el menor daño colateral posible. Este y varios problemas de este tipo pueden ser resueltos a través del PMP, sobre el cual se dan para otras referencias más adelante.

El rol de la teoría de los sistemas de control

Los problemas de motivación propuestos pueden resolverse a través de la teoría de los sistemas de control. Para enfrentar un problema de optimización, se debe ser capaz de determinar variables de estado y direcciones de control realmente significativas que, por una parte, permitan definir un modelo que represente la situación de manera genuina, y que por otra, la estructura matemática del modelo sea posible de manejar con las técnicas existentes. O desde un punto de vista de la investigación matemática, avanzar la teoría en la disciplina para enfrentar de mejor manera los problemas de aplicación. Entonces, es importante tener acceso a referencias de resultados matemáticos teóricos que se adapten al problema. Por este motivo, en este trabajo ampliamos el espectro de referencias incluyendo trabajos sobre sistemas de control que no serán estudiados aquí, como los sistemas bilineales sobre espacios euclideanos, e invariantes y lineales sobre grupos de Lie.

Si un estado y es accesible desde x, significa que existe al menos un control u y un tiempo t>0, que transfiere x a y a través de una trayectoria del sistema en tiempo positivo. El conjunto de accesibilidad desde x es constituido por todos los elementos accesibles desde x. El sistema se dice controlable desde x si el conjunto de accesibilidad desde x coincide con la variedad de estados. El sistema se dice controlable si es controlable desde cada estado del sistema. La propiedad de ‘controlabilidad’ juega un papel esencial en la teoría. Evidentemente, la forma de transferir x a y no es necesariamente única, ni por el control, ni por el tiempo (el lector puede imaginar muchas maneras distintas de transferir el tren al origen, o muchas maneras de dosificar un tratamiento médico). Surge entonces la idea de ‘optimalidad’: de entre todas la trayectorias que transfieren x a y, ¿cuál es la que minimiza el gasto de energía?, ¿cuál de ellas es la que optimiza cierta ganancia?, ¿cuál de ellas optimiza un cierto funcional J?

Adicionalmente, si el sistema posee una función de observación h, ¿es el sistema observable? Esto es, ¿es posible reconstruir estados y trayectorias del sistema con la información que entrega h, con un número menor de variables? Si un sistema no satisface esta última propiedad, ¿es posible caracterizar las clases de equivalencia de los estados ‘inobservables’?, ¿es posible construir un nuevo sistema que se comporte como el inicial y que sea observable?, ¿localmente observable?

La teoría de los sistemas de control estudia en forma sistemática las estructuras matemáticas subyacentes a cada uno de estos problemas y muchos otros desde hace al menos 70 años. Existen clases de sistemas con características analíticas, topológicas, algebraicasy diferenciales propias, sobre las cualeshay una extensa literatura. Véase, por ejemplo, Dubins, 1957; Brockett, 1972; Jurdjevic y Sussmann, 1972; Hermann y Krener, 1977; Wonham, 1979; Jurdjevic y Kupka, 1981; Hilger et al., 1985; Ayala, 1994; Jurdjevic V, 1997a, b; Ayala y Tirao, 1999; Colonius y Kliemann, 2000; Ayala y San Martín, 2001; Jouan, 2010, 2011; Ayala y Da Silva, 2016, 2017; Ayala y Jouan, 2016; Ayala et al., 2014, 2017

Sistemas de Control Lineales sobre Espacios Euclideanos. Controlabilidad

El estudio cualitativo de la clase de los sistemas de control lineales proviene de la necesidad de redirigir el comportamiento dinámico determinado por una ecuación diferencial inducida por una matriz A real de orden n. Este control se realiza a través de una matriz B de orden n x p denominada matriz de costo, y cuyas columnas determinan p campos de vectores constantes bj que intervienen sobre A. En forma precisa,

Definición C1. Un sistema de controllineal sobre el espacio euclideanoRⁿ= {x= (x1, x2, ..., xn): xj R, i= 1, ..., n}, es determinado por la dinámicaẋ(t)= Ax(t) + Bu(t), x Rⁿ, u U.En este contexto, U=Lloc1R,Ω,⊂Rp()es la familia de controles admisibles, en donde es un conjunto cerrado, convexo con 0 int().

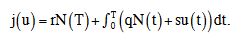

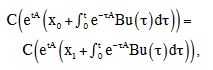

Dada una condición inicial x0 Rⁿ y un control u U, la solución del sistema existe y viene dada por la fórmula de variación de parámetros ( Won ha m, 1979):

Definición C2

Un estado y Rⁿ se dice accesible desde x a través de en T unidades de tiempo (en exactamente T unidades de tiempo), si existen u U, t [0,T] tales que x(x,u,t)= y, (x(x,u,T)= y), respectivamente. Los conjuntos de accesibilidad desde x en T unidades de tiempo y en exactamente T unidades de tiempo, se denotan por S(x,T) y E(x,T) respectivamente. El conjunto de accesiblidad de Σ desde x es definido comoS(x)= UT≥0S(x,T). El sistema se dice controlable desde x si S(x)= Rⁿ. se dice controlable si es controlable desde cada estado del sistema.

Denote <A, B> el menor subespacio Ainvariante de Rⁿ que contiene la imagen de B

Teorema C1

Sea Σ un sistema de control lineal irrestricto (Ω =Rp). Son equivalentes Σ es controlable desde cada x Rⁿ Existe x Rⁿ tal que Σ es controlable desde x Σ es controlable desde el origen si T>0, S(0,T)= Rⁿ si T>0, E(0,T)= Rⁿ Rⁿ= <A, B>. Para una demostración, véase Wonham, 1979, o Ayala y Zegarra, 2001.

Observación. Podemos describir <A, B> explícitamente. Sean b1, b2, ..., bp las columnas de B. Entonces,<A,B>= {Ak bj= 1, 2, ..., p, k= 0, 1, 2, ...}.Debido al Teorema de CalleyHamilton, no es necesario computar Akbj para k≥n. En efecto, para cada k≥n, Ak es combinación lineal de las potencias anteriores. Así, <A, B>={Akbj: j= 1,2, ..., p, k= 0,1,2, ..., n1}

Te ore ma C2 (de Kalman; Wonham, 1979). Sea Σ un sistema de control lineal irrestricto. Entonces, Σ es controlable rango (B AB ....An1B)= n.Un sistema de control lineal Σ se dice restricto, si Ω es compacto, convexo y contiene el origen en su interior. Denote por cl(K) la clausura de un conjunto K.Definición C3 (Colonius y Kliemann, 2000). Sea Σ un sistema de control lineal restricto. Un conjunto no vacío C Rⁿ se dice un ‘conjunto de control’ de Σ si 1) para cada x C existe u U tal que x(x0, u, t) C para todo t≥0; 2) para cada x C, C cl(S(x)); y 3) C es maximal con respecto a las propiedades 1 y 2.

Antes de enunciar el siguiente resultado, recordamos algunas nociones básicas de estabilidad. Una matriz A es hiperbólica si su espectro Spec(A) no posee autovalores con parte real 0. Por otro lado, si Spec(A) posee solo autovalores con parte real negativa, entonces A es asintóticamente estable.En otras palabras, para cada x Rⁿ, limt→∞eτAx→0. O sea, el sistema tiende al equilibrio en el largo plazo.

Teorema C4. Sea Σ un sistema de control lineal restricto sobre Rⁿ. Suponga que la condición de Kalman está satisfecha. En estas condiciones, existe un único conjunto de control C con interior no vacío conteniendo el origen 0. Explícitamente, el conjunto de control viene dado porC= cl(S(0)) S_(0), donde S_(0) es el conjunto de estados que pueden ser transferidos al origen en tiempo no negativo. Además, de la forma del conjunto de control se deduce lo siguiente.Te ore ma C5. Sea Σ un sistema de control lineal restricto sobre Rⁿ. Suponga que la condición de Kalman está satisfecha. Entonces, 1) C es limitado ⇔ A es un operador hiperbólico; 2) Ces invariante si A es asintóticamente estable y en este caso C= cl(S(0)); y 3) C= Rⁿ ⇔ Spec(A) ∩ R= {0}.

Observamos que el ítem 3) es una condición de controlabilidad para sistemas restrictos. Aplicaremos este resultado al problema del tren. Este teorema tiene una extensión para los sistemas lineales sobre grupos de Lie (Ayala y Da Silva, 2017).

Sistemas de Control Lineales sobre Espacios Euclideanos. Observabilidad

Dada una observación parcial de un sistema sobre un intervalo de tiempo finito, ¿es posible determinar totalmente el comportamiento del sistema durante ese período de tiempo a partir de esta información? La importancia de este concepto es teórica y práctica. Para sistemas generales la observabilidad local se relaciona con la integración de familias de formas diferenciales (Ayala et al., 20 01). La observabilidad global está íntimamente relacionada con la generalización obtenida en Sussmann (1975) de un teorema profundo de la teoría de Lie, el teorema del subgrupo cerrado de Cartan. Desde el punto de vista de las aplicaciones, esta propiedad permite reconstruir la dinámica de estados del sistema a través de una función de observación con una economía al reducir el número de variables. Introducimos a continuación el concepto de sistema con función de observación

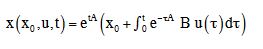

Definición O1. Un sistema de control lineal con observación ΣO es determinado por ẋ (t) = Ax(t) + Bu(t), x Rⁿ, u U, donde h: Rⁿ → Rs es una transformación lineal cuya matriz en las bases canónicas denotamos por C.Si F: Rⁿ → Rs es una transformación lineal, el kernel y la imágen de F son subespaciosKer(F)= {x Î Rⁿ: F(x)= 0} Rⁿ, eIm(F)= {y Î Rs: x Î Rⁿ con y = F(x)} Rs. Introducimos ahora el concepto de ‘inobservabilidad’, que permite descomponer el espacio de estados en clases de equivalencia, las que contienen toda la información de aquellos elementos que no pueden ser distinguidos entre sí por h a través de la dinámica del sistema para tiempos no negativos.

Definición O2. Dos estados x0, x1Î Rⁿse dicen indistinguibles por ΣO six1 x0 Ker(C(etA)), ∀ t ≥0.

Observación.El hecho que la función de observación C no distingue los estados x0y x1 a través de la dinámica del sistema se traduce en que para cada u Î U y t>0

de donde se deduce de inmediato la definición de ‘indistinguibilidad’.

De la propia Definición O2 se deduce el siguiente resultado.

Te ore ma O1. Sea ΣO un sistema lineal con observación. Entonces, 1) I es una relación de equivalencia; y 2) Si I(x) denota la clase de equivalencia de x por la relación I, se obtiene: a) I(0) = ∩t≥0 Ker (CetA); b) I(x)= x + I(0); y c) si O es la matriz transpuesta de (C CA ... CAn1): Σ es observable ⇔ dim (O)= n.

Una prueba del Te ore ma O1 se encuentra en Wonham (1979). Aplicaremos este resultado al problema del tren con dos funciones: distancia y velocidad

Principio del Máximo de Pontryagin

Los ejemplos de la sección anterior y las referencias allí incluidas muestran la necesidad de estudiar estructuralmente ciertos modelos matemáticos que representan problemas específicos en diferentes disciplinas, planteando una serie de preguntas relevantes e importantes de responder. Por ejemplo, en el problema del tren ¿es posible alcanzar el origen desde cualquier estado inicial? O en el problema de la quimioterapia, si ε>0 representa un número de preferencia pequeño ¿es posible dosificar el tratamiento con daño colateral menor que ε?

Considere una familia de ecuaciones diferenciales controladas y una condición inicial x en un espacio de estados M. Nos preguntamos por la naturaleza matemática del conjunto de los estados S(x), que pueden ser alcanzados desde x siguiendo todas las posibles estrategias del sistema en tiempo no negativo, y también por el conjunto G(x) construido como S(x), pero considerando tiempos en la recta real R. ¿Tienen estos conjuntos interior no vacío?, ¿son subvariedades regulares del espacio de estados?, ¿bajo qué condiciones alguno de ellos podría coincidir con M? Si M posee alguna estructura matemática especial, ¿bajo qué condiciones estos conjuntos podrían heredar dicha estructura? Para la naturaleza de G(x) sugerimos la lectura de Sussmann (1973), donde se establece un primer resultado fundamental: el Teorema de Órbitas de Sussmann, que reduce el espacio de estados a un ambiente menor en donde la propiedad de controlabilidad del sistema tiene perfecto sentido. Sobre cada órbita el sistema es transitivo. En forma precisa, dados dos estados arbitrarios de la órbita, cada uno de ellos puede ser alcanzado desde el otro a través de soluciones del sistema utilizando tanto tiempos positivos como negativos. Este resultado no es otra cosa que la extensión del Teorema de Frobenius para distribuciones regulares, a distribuciones con singularidades (Warner, 1971).

En particular, estamos interesados en la deformación de los conjuntos de accesibilidad del sistema a través del tiempo. Denote por d la métrica euclideana usual y por dH la métrica de Hausdorff definida sobre conjuntos compactos P, Q Rⁿ por dH(P,Q) = max {d1, d2}, donde d1= maxxÎQ minxÎQ, d (x, y).En Pontryagin et al. (1961) los autores prueban el siguiente resultado fundamental para la teoría de sistemas de control:Te ore ma P1.

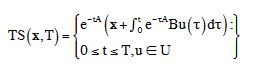

Sea Σ un sistema de control lineal restricto sobre el espacio euclideano Rⁿ. Para cada x Î Rⁿ y T>0, el conjunto de accesibilidad desde el estado inicial x hasta el tiempo:

es compacto, convexo y se deforma continuamente con la métrica de Hausdorff.Este teorema es solo parte de la versión geométrica del PMP, pero es ‘suficiente para nuestros propósitos’. Es importante destacar que para el cómputo del control optimal es necesario considerar el levantamiento hamiltoniano del sistema y la estructura simpléctica del fibrado cotangente de la variedad de estados (Jurdjevic, 1997), asunto que escapa del horizonte de estas notas. En realidad, tenemos la esperanza de que la visión geométrica que vamos a entregar de este principio no deje duda alguna sobre el control optimal que debe ser considerado, al menos en el ejemplo del tren.

El principio de máximo sobre variedades diferenciables (Jurdjevic, 1997a) es un resultado poderoso en la solución de problemas concretos en una enorme gama de disciplinas. Véase Jurdjevic (1997a, b) para aplicaciones de la mecánica, Lee et al. (1982) para el control de vehículos, Leitmann (1982) y Subbaram (2002) para el control de sistemas espaciales, y Shell (1968) para problemas en economía.Dado un estado inicial x, un subconjunto compacto y convexo Ω con 0 int(Ω), las propiedades de la aplicación multivaluada S(x): t→S(x,t) enunciadas en el Te ore ma P1 constituyen el pilar geométrico del principio, al menos para problemas de tiempo óptimo. En efecto, estas propiedades permiten sintetizar el control optimal. En primer lugar, cada conjunto de accesibilidad S(x,t) es compacto. Podemos aplicar entonces la métrica de Hausdorff dH para tiempos t sobre un intervalo y concluir según el teorema que S(x,t) se deforma continuamente con t. Así, dado ε>0, existe un δ>0 tal que d(t,s)<δ se traduce en que dH (S(x,t), S(x,s))<ε.

En otras palabras, si t* es el tiempo asociado al control optimal u* que transfiere el estado inicial x al estado deseado x(t*, x, u*) en tiempo óptimo, entonces x(t*, x, u*), debe pertenecer a la frontera de S(x, t*)! De otra manera, o x(t*, x, u*) estaría fuera de ese conjunto de accesibilidad, o entonces sería un punto interior de S(x, t*), contradiciendo la supuesta optimalidad. En efecto, debido a la deformación continua de los conjuntos de accesibilidad, sería posible alcanzar el estado x(t*, x, u*), en un tiempo levemente menor! Podemos concluir que el estado deseado debe pertenecer a la frontera del conjunto de accesibilidad, esto es x(t*, x, u) ∈∂ S (x, t*).

Como S(x, t*) es un conjunto convexo, la versión geométrica del Teorema de Hahn Banach (Brezis, 1984), asegura que existe un hiperplano H= H(t*) que pasa por x(t*, x, u*) y que deja al conjunto de accesibilidad S(x, t*) de un mismo lado de H. Entonces, existe un covector ηt*, ortogonal a H de tal forma que < ηt*, ξ > ≤ 0 para cada ξ ∈ S(x, t*)

Mejor aún, el máximo se alcanza y es igual a zero exactamente en x(t*, x, u*), que corresponde al origen del referencial. En efecto, con excepción del estado deseado, el ángulo que se produce entre ηt*, y cada vector en S(x, t*) en el nuevo referencial es mayor a 90 grados,Debido al Principio de Optimalidad de Belman (Bellman, 1957), cada estado intermedio x(t0, x, u*) de la trayectoria optimal x(t, x, u*)) con t ∈ [0, t*], debe ser un punto optimal de cada curva que separa, para el mismo problema optimal pero con estados iniciales y finales descritos por los extremos. Esto es, entre [0, t0] y [t0, t*]. Como t0 es arbitrario, existe un grupo a 1parámetro de covectores {ηt: 0 ≤ t ≤ t*}, objeto que es uno de los principales ingredientes del PMP, que en muchas situaciones permite sintetizar en forma explícita la estrategia optimal y resolver el problema.

El Ejemplo del Tren. Controlabilidad, Solución Optimal y Observabilidad

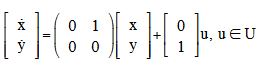

Problema optimal: Detener un tren en una estación en tiempo mínimo. Este problema se puede modelar a través del sistema de control lineal

representando las ecuaciones de manera estructurada como en la Definición C1, con funciones de control u: [0,Tu] →Ω = [1.1] R, y en donde y(t) es la velocidad del tren en el instante t. Como siempre, U es la clase de funciones localmente integrables garantizando existencia y unicidad de la solución para a cada estado inicial (x0, y0) y para cada u ∈ U. Obviamente, este sistema es restricto

Controlabilidad

Geometricamente, el problema de accesibilidad se traduce entonces en transferir el tren desde el estado inicial (x0, y0) al origen (0,0) del plano. Si por ejemplo y0>0, se entiende que al pasar por x0 el tren se mueve con velocidad y0 en la dirección de la estación. Si y0<0 el tren se mueve en la dirección contraria a la estación, situación que es perfectamente posible, si por ejemplo, han llamado al conductor a volver a la estación de origen.

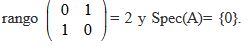

Antes de iniciar la búsqueda de una solución óptima es necesario saber si el sistema de control lineal restricto es controlable. Según el Te ore ma C5, necesitamos calcular el rango de la matriz de Kalman y el espectro de A. Un cómputo inmediato muestra que rango (B AB) =

Entonces, el sistema restricto es controlable. En particular, cualquier condición inicial puede ser trasladada al origen y el problema de optimal tiene perfecto sentido.

Optimalidad

El lector puede fácilmente imaginar que existen muchas formas distintas de transferir la condición inicial al origen. Sin embargo, desde el punto de vista de optimización, se necesita encontrar un control optimal que u* t ranspor te (x0, y0) al origen en tiempo mínimo. Es importante destacar que las transferencias entre estados no se realizan a través de curvas arbitrarias; si no, solo a través de aquellas que satisfacen las ecuaciones diferenciales asociadas al sistema de control Σ. De acuerdo al PMP, las únicas estrategias óptimas posibles para nuestro problema se encuentran en la frontera del conjunto de los estados accesibles. Esta información crucial, trasladada a las funciones de control se reduce a dos posibilidades a considerar: o bienu(t) es constante e igual a 1, o bien u(t) es constante e igual a 1.

Obviamente, el traspaso de esta información desde la frontera ∂S(x, t) a la frontera ∂[1,1] no es inmediato. En realidad, se deduce de las ecuaciones diferenciales parciales asociadas al sistema hamiltoniano del PMP, que como hemos dicho, escapa al horizonte de estas notas.El mismo principio establece que una combinación adecuada de estos dos controles entrega la curva optimal con un máximo de n1 cambios de control. En este caso, n= 2, de modo que a lo más se necesita un cambio: de u= 1 a u= 1 o recíprocamente.

Obsérvese que este principio reduce a priori y de manera notable la búsqueda de una solución óptima desde un universo infinito de posibilidades contenidas en el conjunto de dimensión infinita Lloc1R,Ω=−1.1[](), a una combinación reducida de controles constantes por pedazos. Con esta información ¿cómo obtener la solución óptima? En primer lugar, debemos computar las soluciones de las dinámicas asociadas a los controles bangbang. Para u= 1, obtenemos la ecuación diferencial ẋ(t)= y(t), ẏ(t)= 1, cuyas soluciones son parábolas centradas en el eje y abriéndose hacia la derecha, o sea, convexas respecto del eje y. Por otra parte, para el control u= 1 se obtiene el sistema ẋ(t)= y(t), ẏ(t)= 1, cuyas soluciones son parábolas centradas en el eje y, abriéndose hacia la izquierda, esto es, cóncavas respecto del eje y. De entre estas dos familias de curvas, existen dos trayectorias que son esenciales, aquellas que nos trasladan al origen. Denote por u_ la intersección de la curva que nos traslada al origen con control u= 1, con el semiplano y>0. Denote por u_ la intersección de la curva que nos traslada al origen con control u= 1, con el semiplano y<0. Entonces, la concatenación (unión) a través del origen de las semicurvas u+ con u+ que denotamos por α, es una curva continua que divide el plano en dos componentes conexas: (R²) y (R²)+, a la izquierda y a la derecha de la curva α, respectivamente.

Considere, por ejemplo, un estado inicial (x0, y0) ∈ (R²)– con y0>0. Entonces, usted se dirige hacia la estación con una velocidad y0 desde una distancia x0. Según el principio deberá acelerar al máximo siguiendo la trayectoria optimal determinada por el control u= 1. Geométricamente, Ud. viajará por la única parábola que pasa por (x0, y0) para la ecuación diferencial determinada por u= 1, y que se dirige al encuentro de la semiparábola u–. En el punto de intersección de ambas parábolas Ud. debe cambiar de estrategia y se trasladará al origen en tiempo mínimo vía u–. En otras palabras, siguiendo la estrategia optimal, Ud. acelerará al máximo durante un período de tiempo para después frenar al máximo durante otro período de tiempo. ¿Cómo saber en qué momento cambiar de estrategia? Esto es equivalente a preguntar ¿cómo calcular el punto en donde debo pasar de la aceleración al freno? Bueno, el principio entrega esta información de manera automática. En realidad las curvas u– y u+ son conocidas, y dada cualquier condición inicial del plano las trayectorias de los sistemas conu= 1 y con u= 1 también. Cualquier ordenador entrega de inmediato el punto de intersección. La proyección sobre el eje x de ese punto de intersección informa al maquinista exactamente donde aplicar, en este caso, el freno.

Invitamos al lector a analizar la estrategia optimal para (x0, y0) ∈(R²)+ con y0>0. Obsérvese que podría darse el caso de que el tren viniera con alta velocidad y encontrarse muy cerca de la estación.

Observabilidad

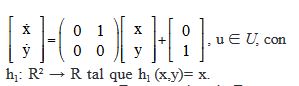

En esta sección analizamos el ejemplo del tren con dos funciones de observación: las proyecciones coordenadas. Más arriba estudiamos condiciones algebraicas para determinar la propiedad de observabilidad para la clase de los sistemas lineales de control sobre espacios euclidianos.Considérese el sistema de control lineal restricto ΣO1 con función de observación

De acuerdo al Te ore ma O1 debemos computar el rango de la matriz traspuesta de O. En este caso C= (1 0) y CA= (0 1). De modo que O1 posee rango máximo y el sistema es observable. En concreto, esto significa que para determinar cualquier trayectoria del sistema solo es necesario conocer su proyección sobre el eje x. En otras palabras, conociendo las distancias podemos conocer las velocidades. Sin embargo, la recíproca no es válida.

En efecto, considérese el sistema anterior pero con función de observación proyección en la segunda variable h2: R² → R. En este caso el rango de O1 es 1 y el sistema no es observable. Es interesante observar que dados dos puntos p y q arbitrarios del plano pero con la misma altura, el sistema no permite distinguirlos a través de los controles bangbang. En realidad, cada control de este tipo entrega una familia de ‘parábolas paralelas’ centradas en el eje y. De modo que al proyectar simultáneamente las soluciones con condición inicial p y con condición inicial q sobre el eje y, éstas coinciden para cada tiempo positivo (y negativo!). De modo que el sistema no puede ser observable. La clase de inobservabilidad del origen es I(0,0)= eje x. De acuerdo al Te ore ma O1, la clase de inobservabilidad de cada estado del plano (x0, y0) ∈ R² viene dada por I(x0, y0)= (x0, y0) + eje x.

Comentario relativo a la extensión de los resultados mencionados

En Ayala y Tirao (1999) se introdujo la clase de los sistemas de control lineales sobre grupos de Lie, donde cada estado del sistema es una matriz. En Ayala et al., 2017) fue demostrado que para esta clase de sistemas los conjuntos de accesibilidad también se deforman continuamente con la métrica de Hausdorff. En Ayala y Jouan (2016) se estableció la estructura simpléctica asociada a esta clase de sistemas para obtener una versión específica del Principio del Máximo de Pontryagin. Finalmente, en Ayala et al.(2001) se obtuvieron las mismas propiedades de observabilidad descritas en el Te ore ma O1 para la clase mencionada y en Ayala y Hacibekiroglu (1997) se establecieron condiciones algebraicas y topológicas, caracterizando la observabilidad local.

REFERENCIAS

Axelby GS (1973) Roundtable discussion on the relevance of control theory. Automatica 9: 279281

Ayala V (1994) Controllability of nilpotent systems. Banach Center Publ. Polish Acad. Sci. 32: 35 46.

Ayala V, Da Silva A (2016) A semigroup associated to a linear control system on a Lie group. Syst. Control Lett. 98(Dec): 3336.

Ayala V, Da Silva A (2017) Control sets of linear systems on Lie groups. Nonlin. Differ. Eq. Appl.24:8c. Springer. DOI 10.1007/s000 3001704305.

Ayala V, Hacibekiroglu A (1997) Local observability of invariant dynamics on compact Lie groups with square integrable output map functions. Comput. Math. Applic. 34(12): 6170.

Ayala V, Jouan P (2016) Almost Riemannian structures and linear control systems on Lie groups. SIAM J. Contr. Optimiz. 54(5): 29192947.

Ayala V, Kawan C (2014) Topological conjugacy of real projective f lows. J. Lond. Math. Soc. 90: 4966.

Ayala V, San Martín L (2001) Controllability properties of a class of control systems on Lie groups. Lect. Not. Contr. Inf. Sci. 258: 8392.

Ayala V, Tirao J (1999) Linear control systems on Lie groups and controllability. Amer. Math. Soc. Ser. Symp. Pure Math. 64: 4764.

Ayala V, Zegarra R (2001) Controllabilidad de sistemas lineales sobre grupos de matrices, Cubo J. Math. 3:x171212.

Ayala V, Kizil E, Hacibekiroglu A (2001) Observability of general linear pairs. Comput. Math. Applic. 39: 35 43.

Ayala V, Rodriguez J, San Martin L (2009) Optimality on homogeneous space. An example on the real projective line. SIAM J. Contr. Optimiz. 29: 15151528.

Ayala V, San Martin L, Ribeiro V (2014) Controllability on Sl(2,C) with restricted controls. SIAM J. Contr. Optimiz. 52: 25482567.

Ayala V, Da Silva A, RománFlores H (2017) Continuity of reachable sets of restricted affine control systems. Chaos Solit. Fract. 94: 3743.

Bellman RE (1957) Dynamic Programming. Princeton University Press,Princeton, NJ, EEUU. Republished (2003) Dover, ISBN 0486428095.

Brézis H (1984) Análisis Funcional: Teoría y Aplicaciones. Theorem 1.6 (p. 5). Alianza. Madrid, España. 233 pp.

Brockett R (1972) System theory on groups and coset spaces. SIAM J. Contr. 10: 265284.

Colonius F, Kliemann W (2000) The Dynamics of Control. Birkhäuser. Definition 3.1.2 (p. 48). Boston, MA, EEUU.

Dubins L (1957) On curves of minimal lengths with a constraint on average curvature and with prescribed initial and terminal positions and tangents. Amer. J. Math. 79: 497516.

Gustavsson I (1975) Survey of application of identification in chemical and physical processes. Automatica 11: 324.

Hermann R, Krener A (1977) Nonlinear controllability and observability. IEEE Trans. Autom. Contr. AC22(5): 728 740.

Hilger KH, Hofmann JD, Lawson L (1985) Controllability of systems on a nilpotent Lie group. Contrib. Algeb. Geom. 20: 185190.

Jouan P (2010) Equivalence of control systems with linear systems on Lie groups and homogeneous spaces. ESAIM: Contr. Optimiz. Calc. Variat. 16: 956973.

Jouan P (2011) Controllability of linear systems on Lie group. J. Dynam. Contr. Syst. 17: 591 616.

Jurdjevic V (1997a) Geometric Control Theory. Cambridge University Press. Nueva York, EEUU. 354 pp.

Jurdjevic V (1997b) Optimal control problemson Lie groups: crossroads between geometry and mechanics. En Jakubczyk B, Respondek W (Eds.) Geometry of Feedback and Optimal Control. Decker. Nueva York, EEUU. pp. 257303.

Jurdjevic V, Kupka I (1981) Control systems on semisimple Lie groups and their homogeneous spaces. Ann. Inst. Fourier 31(4): 151179.

Jurdjevic V, Sussmann H (1972) Control systems on Lie groups. J. Diff. Eq. 12: 313 329.

Ledzewicz U, Schattler H (2002a) Optimal bangbang controls for a 2compartment model in cancer chemotherapy. J. Optimiz. Theory Applic. 114: 609637.

Ledzewicz U, Schattler H (2002b) Analysis of a cellcycle specific model for cancer chemotherapy. J. Biol. Syst. 10: 183206.

Ledzewicz U, Shattler H (2006) Optimal control for a bilinear model with recruiting agent in cancer chemotherapy. Proc. MTNS. Kyoto, Japan. pp. 478484.

Lee DH, Milroy IP, Tyler K (1982) Application of Pontryagin’s Maximum Principle to the semiautomatic control of rail vehicles. 2ndConf. Control Eng. 1982: Merging of Technology and Theory to Solve Industrial Automation Problems. Institution of Engineers. Barton, Australia. pp. 233236.

Leitmann G (1962) Optimization Techniques with Application to Aerospace Systems. Academic Press. Londres, RU. pp. 389445

Pesch HJ, Plail M (2009) The Maximum Principle of Optimal Control: A history of ingenious ideas and missed opportunities. Contr. Cybern. 38(4A): 973995.

Pesch HJ, Plail M (2012) The Cold War and the Maximum Principle of Optimal Control Docum. Math. (Extra Vol): 331343.

Pontryagin LS, Boltyanskii VG, Gamkrelidze RV, Mishchenko EF (1961) Matematicheskaya Teoriya Optimal’nykh Prozessov. Fizmatgiz, Moscow. Trad. inglesa (1962): The Mathematical Theory of Optimal Processes. Wiley. Nueva York, EEUU. 360 pp.

Shattler H, Ledzewicz U (2006) Drug resistence in cancer chemoteraphy as an optimal control problem. Discr. Cont. Dyn. Syst. Ser. B 6: 129150.

Schättler H, Ledzewicz U (2012) Geometric Optimal Control.Theory Methods and Examples. Interdisciplinary Applied Mathematics 38. Springer. 640 pp.

Shell K (1968) Applications of Pontryagin’s Maximum Principle to economics. Lect. Not. Operat. Res. Math. Econ. 10/11: 241292.

Subbaram D (2002) Optimal Control Systems. CRC. Boca Raton, FL, EEUU. p p. 315 360.

Sussmann H (1973) Orbits of families of vector fields and integrability of distributions. Trans. Amer. Math. Soc. 180: 171188.

Sussmann H (1975) A generalization of the closed subgroup theorem to quotients of arbitrary manifolds. J. Diff. Geom. 10: 151166.

Sussmann H, Willems C (1997) 300 Years of Optimal Control: From the Brachystochrone to the Maximum Principle. IEEE Contr. Syst. (Ju ne): 32 44.

Warner FW (1983) Foundations of Differentiable Manifolds and Lie Groups. Graduate Texts in Mathematics. Vol. 94. 41 pp. Springer. 276 pp.

Wonham WM (1979) Linear Multivariable Control: aA Geometric Approach. Applications of Mathematics. Vol. 10. Springer. 326 pp.