Ciencias Sociales, Humanidades y Artes

Recepción: 18 Abril 2024

Aprobación: 05 Agosto 2024

Publicación: 09 Septiembre 2024

DOI: https://doi.org/10.22201/enesl.20078064e.2024.26.88380

Resumen:

Objetivo: adaptar el instrumento para medir las competencias digitales originalmente propuesto por Carrera (2011), mediante una revisión y valoración teórica de los constructos que integran la escala de medida, denominada validación aparente y evaluar la validez de constructo de la herramienta en una población de estudiantes de sexto grado de educación primaria.

Diseño Metodológico: se realizó un estudio mixto con dos fases, primero se llevó a cabo un análisis de validez aparente para la definición del contenido y el ajuste semántico y sintáctico de las preguntas, seguido de una evaluación de la validez de constructo mediante análisis factorial exploratorio (afe), utilizando como método de extracción ejes principales con rotación oblicua. La confiabilidad se determinó mediante el coeficiente Alfa de Cronbach. En total, participaron 310 alumnos de 11 escuelas públicas.

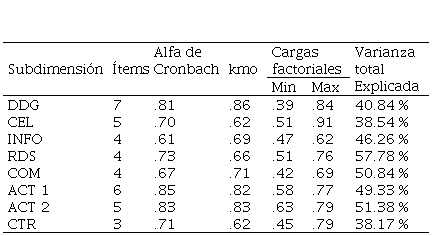

Resultados: se presenta un instrumento compuesto por 38 reactivos, divididos en ocho subdimensiones relacionadas con la apropiación de competencias digitales. La prueba kmo se encuentra en un rango de .62 a .86, la varianza total explicada en un rango de 38.17 % a 57.78 %, y las cargas factoriales son mayores a .30 en todos los factores. El índice alfa de Cronbach fue de .61 a .85.

Limitaciones de la investigación: la longevidad y vigencia de esta herramienta deben ser revisadas constantemente, el autorreporte como método de recolección de datos debe complementarse con otras técnicas.

Hallazgos: los resultados muestran que cinco de las dimensiones obtuvieron puntuaciones excelentes, respaldando la validez de la estructura factorial en esas dimensiones. Los análisis ofrecen una herramienta robusta y adecuada para la evaluación de las competencias digitales en niños de sexto grado de educación básica.

Palabras clave: análisis factorial, competencias digitales, educación básica, tecnologías de la información y la comunicación, evaluación de pruebas..

Abstract:

Purpose: to adapt an instrument for measuring the digital skills originally proposed by Carrera (2011) through a theoretical review and evaluation of the constructs that comprise a measurement scale known as face validity, and to assess the construct validity of the instrument through an elementary school’s sixth-grade population.

Methodological design: A two-phased mixed-methods study was applied to a population of 310 students from 11 public schools. First, an analysis of face validity was conducted to define the content and adjust the semantic and syntactic aspects of the questions, followed by an evaluation of construct validity through exploratory factor analysis (efa) using main axes with oblique rotation as the extraction method. Reliability was determined using Cronbach's Alpha Coefficient.

Results: A 38-item instrument divided into eight subdimensions related to the appropriation of digital skills is presented. The kmo test ranges from .62 to .86, the total explained variance ranges from 38.17% to 57.78%, and factor loadings are greater than .30 in all factors. Cronbach's Alpha index ranged from .61 to .85.

Research Limitations: The instrument’s longevity and validity must be continuously monitored. Additionally, self-reporting as a data collection method must be complemented with other techniques.

Findings: Results show that five of the dimensions obtained excellent scores, lending support to factor structure validity in those dimensions. The analyses conducted provide evidence of a robust and appropriate instrument for the evaluation of digital skills in sixth-grade children of basic education.

Keywords: Factor analysis, Digital Skills, Basic education, Communication and Information Technologies, measure validation..

Introducción

Antecedentes

En la era de la Sociedad de la Información y el Conocimiento (sic), las competencias digitales son habilidades esenciales para participar de manera efectiva en la vida personal, académica, profesional y social. Estas competencias están relacionadas con la capacidad de utilizar las tecnologías de la información y la comunicación (tic) para buscar, evaluar, procesar, crear y compartir información, así como para comunicarse y colaborar con otras personas en entornos digitales (Vardan et al., 2021). Desde inicios del siglo XX, órganos internacionales como la Organización para la Cooperación y el Desarrollo Económico (ocde), la Comisión Europea, y la Comisión Económica para América Latina y el Caribe (CEPAL) identifican y reconocen plenamente que el acceso y gestión efectiva de recursos digitales es un elemento catalizador de las desigualdades existentes y el cual debe ser caracterizado, medido y gestionado (CEPAL, 2021).

La pandemia del COVID-19 ha destacado la necesidad de fortalecer los medios, procesos y canales que faciliten el acceso democrático a recursos tecnológicos de información, y de fortalecer las competencias digitales de todos los miembros de la sociedad (Zelaya, 2020). La adquisición y desarrollo de competencias digitales es fundamental en la formación académica, la capacitación laboral y la educación continua, para garantizar una ciudadanía digital informada y participativa. De esto se desprende la necesidad de contar con instrumentos que permitan evaluar las competencias digitales de los individuos, a fin de detectar oportunamente aquellas áreas que requieren mayor desarrollo (Gómez et al., 2018; Tzafilkou et al., 2022).

En el año 2008, la Unión Internacional de Telecomunicaciones (uit), elaboró un índice para medir ciertos aspectos importantes de la brecha digital, agrupados en tres grandes dimensiones: acceso, utilización y conocimientos. Esta iniciativa fue un paso importante frente a la necesidad de tener un instrumento que permitiera hacer comparaciones entre diferentes regiones, observar la evolución de la brecha digital a través del tiempo y hacer visibles las interrelaciones de algunos de sus componentes (uit, 2009). Debido a obstáculos metodológicos y de disponibilidad de información, este índice dejó de utilizarse, y los intentos para echarlo a andar nuevamente no han sido exitosos (uit, 2020).

En este tenor, existe una gran diversidad y proliferación de estándares y procedimientos para medir o evaluar las competencias digitales, entre ellos el DigComp Frameworks for Citizens, herramienta oficial de la Unión Europea; el Digital Competency Strategy For Teachers y el National Educational Technology Standards for Students, escalas de medida utilizadas por el gobierno de Estados Unidos para evaluar las competencias digitales en docentes y estudiantes, respectivamente. Otro instrumento notable es el desarrollado por la Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura (unesco) unesco ICT Competency Framework for Teachers dirigido a docentes (Sillat, Tammets, y Laanpere, 2021), y el Digital Kids Asia-Pacific enfocado específicamente en niños del contexto asiático (Shin et al., 2019).

Evolución y Desafíos en la Medición de Competencias Digitales

Dado la importancia de las competencias digitales en la agenda global, han surgido numerosos enfoques teóricos que buscan comprenderlas, explicarlas y medirlas. En su teoría del recurso y la apropiación, Van Dijk (2020) describe cuatro fases primordiales relacionadas con el acceso y gestión de las tic: motivación, acceso físico, competencias digitales y uso.A continuación presentamos una revisión del concepto de competencias digitales, cuya adquisición y dominio es secuencial, y obedece a múltiples condiciones comúnmente relacionadas con el nivel socioeconómico, la escolaridad, la cultura, la política pública, los valores identitarios y el desarrollo profesional (Pedaste, Kallas, y Baucal, 2023).

Van Dijk (2020) distingue entre habilidades digitales y competencias digitales; indica que las habilidades se relacionan con las interacciones de los usuarios con los medios digitales, es decir, sus capacidades prácticas para realizar tareas específicas con las tic. En contraste, sugiere que las competencias están vinculadas a los conocimientos, no necesariamente a la aplicación práctica, sobre cómo deben llevarse a cabo dichas tareas. A menudo, las competencias digitales se definen como un conjunto de estándares operativos que listan una serie de funciones y tareas que una persona debe poder ejecutar de manera efectiva en ambientes digitales de trabajo y aprendizaje. Rantala (2010) hace una crítica al respecto y señala que tales conceptualizaciones desestiman el uso reflexivo y analítico de las tic. La competencia digital debe traducirse en la síntesis de habilidades, conocimientos y actitudes, en aspectos tecnológicos, multimedia de información, y de comunicación, es decir, a la utilización de recursos digitales de forma productiva, no meramente a su uso operacional (Gisbert y Esteve, 2016).

Salazar, Tobón, y Juárez (2018) mencionan dos grandes áreas de especificidad técnica y establecen que las competencias digitales comprenden diversos componentes relacionados con la alfabetización informacional y el manejo técnico de herramientas tecnológicas y digitales. Estos componentes están relacionados a las habilidades y conocimientos para acceder, gestionar, comunicarse, crear y evaluar a través de las tic o en entornos digitales (Avinç y Doğan, 2024; Cabero y Martínez, 2019). Todas estas áreas competenciales son mucho más cercanas a los constructos teóricos desde los que normalmente se aborda el análisis y medición de las competencias digitales.

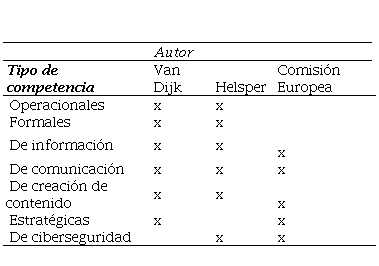

La propuesta teórica de Van Dijk (2020) desglosa las competencias digitales en las siguientes dimensiones: competencias operacionales, competencias formales, competencias de información, competencias de comunicación, competencias de creación de contenido, y competencias estratégicas. Helsper et al. (2021), ofrecen una versión muy similar: con la añadidura de la dimensión elementos de conocimiento digital, que incluye a la ciberseguridad y las acciones de autocuidado en espacios virtuales.

La categorización de Helsper et al. (2021) no menciona explícitamente la dimensión de competencias estratégicas, definida por Van Dijk (2020) como las capacidades para usar los medios digitales con propósitos específicos. Sin embargo, en un examen más profundo, la clasificación de Helsper apunta a que, fuera de la primera dimensión competencias operacionales, todas las capacidades aludidas en las demás dimensiones están orientadas a fines concretos.

El marco de referencia para las competencias digitales de la ciudadanía estandarizado por la Unión Europea (DigComp), establece cinco dimensiones de competencias digitales que, a grosso modo, coinciden con las de Helsper et al. (2021) y Van Dijk (2020). La ausencia en este modelo de competencias básicas (operacionales) podría atribuirse a que, al ser necesarias para la adquisición de las demás competencias, su inclusión en el modelo resultaría redundante. En la tabla 1 se muestra una síntesis de las clasificaciones de competencias digitales por autor.

Esquematización de las competencias digitales por autor

Fuente: elaboración propia con datos de Van Dijk (2020), Helsper et al. (2021) y el Centro de Investigaciones Comunes de la Comisión Europea (2022).

En torno a lo anterior, las competencias digitales operacionales se refieren a las capacidades básicas de gestionar dispositivos tecnológicos; comprenden habilidades como el encender/apagar un dispositivo, establecer interconexiones con otras tic, manejar teclados, bocinas, y demás elementos accesorios o periféricos. La capacidad de poder ejecutar estas acciones es un prerrequisito para la gestión de computadoras, celulares, tabletas, televisores, videojuegos y demás tic (Deursen y Van Dijk, 2008; Van Dijk, 2020). Con base en esta conceptualización se incluyeron subdimensiones referidas al uso de computadoras (DDG) y celulares (CEL) respectivamente.

El manejo de información o competencias informacionales es otro de los parámetros normalmente analizados en la medición de competencias digitales. Se refiere a la capacidad de los individuos de buscar, seleccionar y evaluar información. Por ejemplo, la habilidad de discernir si cierta información es falsa o verdadera, o de identificar información útil para los propósitos de una búsqueda (Helsper et al., 2021; Van Dijk, 2020). Este constructo está integrado al instrumento en la subdimensión Búsqueda de Información (INFO).

Las capacidades relacionadas a la comunicación e interacción con otros usuarios por medios digitales comprenden la identificación y familiarización con interfaces de plataformas y programas, así como con el uso de herramientas para el trabajo colaborativo. Comprenden también la capacidad de ejecutar acciones específicas como el contactar a otros usuarios, crear identidades virtuales, o emitir opiniones en foros públicos (Gisbert y Esteve, 2016; Starkey et al., 2021). En esta dimensión se incluyen elementos relacionados a la interacción en las redes sociales (RDS) y al uso de espacios virtuales para la comunicación (COM).

Helsper et al. (2021) indican que el conocimiento que tienen los usuarios acerca de acciones de riesgo en entornos virtuales, y su capacidad para proteger dispositivos, datos personales y privacidad son también un área competencial relevante dentro de la Sociedad de la información y del Conocimiento. Estas competencias están ligadas a la ciberseguridad, la netiqueta y, en general, al comportamiento de los usuarios en el internet (De León, Corbeil, y Corbeil, 2023). Estas consideraciones se reflejan en el instrumento en las subdimensiones ACT1, relacionadas a acciones de riesgo; y ACT2 referente a acciones de autocuidado.

La exposición y uso excesivos de dispositivos digitales están asociados, entro otros factores, a menores niveles de rendimiento académico (Gómez y Mediavilla, 2021; Hu et al., 2018), por lo que se consideró pertinente mantener la subdimensión CTR del instrumento original, la cual está relacionada al tiempo de exposición a diferentes tic que tienen los usuarios (Carrera et al., 2011).

Finalmente, se debe considerar que la recopilación de datos para evaluar competencias digitales se basa en dos métodos principales. En primer plano, la encuesta, generalmente diseñada en una escala Likert, donde los sujetos informan sobre su nivel autopercibido de competencia en diversas habilidades digitales. Segundo, las pruebas prácticas de desempeño técnico, en las que se asignan tareas específicas a los sujetos, quienes deben completarlas bajo observación mientras se documenta su desempeño (Allmann y Blank, 2021; Hobbs, 2017). En caso de la evaluación de competencias digitales en poblaciones infantiles, ambos métodos suponen desafíos tangibles relacionados con elementos de desarrollo cognitivo, compresión lectora, la percepción sobre las respuestas que se esperan de ellos y aspectos del orden conductual. El Fondo de las Naciones Unidas para la Infancia (UNICEF) reconoce estos retos y advierte que se debe tener particular cautela al evaluar competencias digitales en niños, incluso al utilizar el mismo instrumento que el organismo propone (Shin et al., 2019).

A partir de la revisión de literatura, en adelante se utiliza el concepto de competencias digitales en el sentido más amplio del constructo en español, que incluye la combinación de conocimientos, destrezas y actitudes en el uso y manejo de las tic (Centro de Investigaciones Comunes de la Comisión Europea, 2022).

Por otra parte, cabe resaltar que, en el contexto de la evaluación de competencias digitales, la longevidad de los instrumentos está determinada por el cambio tecnológico, la evolución y transformación de las tecnologías existentes y la creación constante de nuevas tecnologías (Dattée, FitzPatrick, y Weil, 2007). Esto trae consigo la necesidad imperante de mantener herramientas de medida actualizadas a la par de las nuevas tecnologías o de las innovaciones en las ya existentes. En este sentido, las competencias digitales que un individuo posee están condicionadas por los avances tecnológicos; para ser competente, el individuo deberá actualizarse y capacitarse de forma permanente (Rodríguez et al., 2016).

La mayoría de los instrumentos encontrados en la literatura relacionados con contextos académicos, están dirigidos a estudiantes universitarios o docentes, siendo menos frecuentes los orientados a estudiar poblaciones de niños (Cabezas-González et al., 2023; Pedaste, Kallas, y Baucal, 2023; Silva y Morales, 2022; Nascimbeni y Vosloo, 2019). En este sentido, es necesario desarrollar instrumentos que evalúen las competencias digitales en estudiantes de educación primaria, puesto que las tic se han convertido en pieza clave en el aprendizaje, la participación ciudadana y el desarrollo del individuo (Kontkanen et al., 2023; Li y Hu, 2022; Restrepo y Segovia, 2020).

Dadas estas limitaciones, el presente trabajo tiene como objetivo abordar las consideraciones pertinentes para la adaptación y validación de un instrumento destinado a evaluar las competencias digitales en estudiantes de sexto grado de educación primaria. Para lograrlo, el estudio se enfoca en dos objetivos principales. El primero consiste en adaptar el instrumento propuesto originalmente por Carrera (2011) para medir las competencias digitales, a través de una revisión y valoración teórica de los constructos que componen la escala de medida, proceso conocido como validación aparente. El segundo objetivo es evaluar la validez de constructo de la herramienta en una muestra de estudiantes de sexto grado de educación primaria.. Dado las limitaciones expuestas anteriormente, el presente trabajo se propone responder a la siguiente pregunta de investigación: ¿Qué consideraciones son pertinentes para la adaptación y validación de un instrumento para la evaluación de competencias digitales en estudiantes de sexto grado de educación primaria? Colocando como objetivo general el diseño y validación de una medida de competencia digital para alumnos de sexto grado de primaria. Para responder a este objetivo general, el presente estudio se plantea dos objetivos específicos: a) el primero es adaptar el instrumento para medir las competencias digitales originalmente propuesto por Carrera (2011), mediante una revisión y valoración teórica de los constructos que integran la escala de medida, denominada validación aparente; y b) el segundo es evaluar la validez de constructo de la herramienta en una población de estudiantes de sexto grado de educación primaria.

Diseño metodológico

Se plantea un diseño mixto de investigación. Desde el punto de vista cualitativo, se llevó a cabo un análisis conceptual de una herramienta de medida, con el propósito de adaptarla a una población objetivo (validación aparente). Desde el punto de vista cuantitativo, se llevaron a cabo análisis estadísticos descriptivos y análisis factorial exploratorio.

En primer lugar, se llevó a cabo la validez aparente. Para ello, se identificaron herramientas para la medición de competencias digitales a poblaciones juveniles e infantiles. En seguida, se excluyeron aquellas que por su complejidad no eran aptas para la muestra. Una vez elegido el instrumento, este fue revisado por expertos para identificar áreas temáticas que pudieran resultar confusas, desfasadas respecto al avance de la tecnología, o inadecuadas en torno al nivel de especialización para la población objeto.

Posteriormente, se concertaron citas con las escuelas participantes. Para el levantamiento de datos se pidió al docente de grupo que seleccionara alumnos al azar, a quienes se les explicó en qué consistía el proyecto y se enfatizó la importancia de que preguntaran y expresaran cualquier duda que tuvieran respecto a la redacción, diseño y contenido del instrumento. Hubo acompañamiento en todo momento por dos encuestadores y dos asistentes, quienes registraron de manera metódica las observaciones hechas por los participantes. A partir de esta etapa se tomaron decisiones estratégicas respecto a la muestra, el rediseño del instrumento y la adaptación de los contenidos.

Para la validación aparente participaron 30 alumnos de tres escuelas primarias de organización completa ubicadas en el estado de Sonora. En cada escuela se eligieron diez alumnos al azar, cinco de quinto y cinco de sexto grado. Las edades oscilaron entre los 10 y los 12 años. En esta fase del proceso participaron 17 mujeres y 13 hombres.

En segundo lugar, se llevó a cabo la validez de constructo. Para ello, se hizo contacto con las autoridades educativas en cada una de las primarias participantes, quienes fueron informados del propósito y logística de la aplicación de los cuestionarios. Los datos fueron recolectados entre diciembre del 2022 y febrero del 2023. La aplicación del instrumento fue dirigida por el encuestador y se realizó de manera presencial en una sola sesión de aproximadamente 45 minutos.

Para la validez de constructo se determinó una muestra constituida por 280 participantes, de los cuales 148 son mujeres y 132 hombres, todos cursando el sexto año de primaria. Del total de los encuestados 77.7 % declaró tener 11 años de edad, el rango general de la población es de 10-12 años; solo 1.4 % del total no está dentro de este grupo etario. Los participantes pertenecen a ocho escuelas primarias del estado de Sonora, todas de organización completa y financiadas por el sistema público.

Se descartaron en total 10 cuestionarios, excluyendo el del análisis a alumnos con diagnóstico de discapacidad intelectual (n=3), a quienes dejaron secciones incompletas (n=3), a quienes abandonaron la aplicación (n=2) y en casos donde se identificaron patrones de respuesta inconsistentes (n=2). Los datos fueron capturados en hojas de Excel e importados al paquete estadístico SPSS v26, en el cual se realizaron los análisis estadísticos.

La selección del instrumento base, Instrumento de Evaluación de Competencias Digitales para Adolescentes en Riesgo Social (Carrera et al., 2011),responde a que su diseño y objetivo considera específicamente la atención a niños y adolescentes en riesgo de exclusión social, comprende competencias digitales básicas cuyo dominio puede favorecer al desvanecimiento de brechas y obstáculos que limitan o condicionan el desarrollo y participación social de los estudiantes en situación de vulnerabilidad (Zelaya, 2020).

El diseño de la herramienta original comprende dos secciones dedicadas a recopilar datos atributivos de los participantes: a) datos personales, b) información general; y cuatro secciones más relacionadas específicamente con las competencias digitales, c) utilización de dispositivos digitales, d) utilización de aplicaciones multiplataforma, e) información y comunicación en red, y f) actitudes ante las tic, estas corresponden de manera general a las dimensiones propuestas teóricas previamente discutidas en la tabla 1.

Todas las partes fueron informadas de los propósitos de la investigación y las implicaciones de su participación. Se les expidieron formatos con datos de contacto de los responsables, especificaciones del tratamiento y manejo de su información, y la certeza de que podían retirarse del estudio en cualquier momento si así lo deseaban. El proceso de recolección de datos y la información almacenada se apegó de manera rigurosa a los lineamientos que propone la Sociedad Mexicana de Psicología (2007), para cuidar la integridad y bienestar de los participantes.

Resultados

Validación aparente

En el rediseño y actualización de la herramienta, hubo que agregar seis reactivos relacionados con las variables atributivas, con el propósito de caracterizar a los participantes respecto a su edad, sexo, afinidades académicas y hábitos de consumo de contenido digital. También se incluyeron seis reactivos probados y validados para evaluar el nivel socioeconómico, entre los cuales se incluye la tenencia de internet (Asociación Mexicana de Agencias de Inteligencia de Mercado y Opinión AC. [AMAI], 2020). A partir de una revisión exhaustiva del instrumento, se removieron reactivos cuyo nivel de especialización rebasa las competencias esperadas en el grupo etario objeto de la investigación, tales como manejo de bases de datos, hojas de cálculo, edición y producción de videos, programación, o gestión de software para fines de mercadotecnia (Rodríguez de Dios et al., 2016).

También se removieron secciones relacionadas con tecnología obsoleta o tecnología que ha sido integrada en otros dispositivos, específicamente los reactivos para las competencias en el manejo de reproductores de mp3 y de cámaras fotográficas digitales, las cuales están ahora integradas en los teléfonos móviles y tabletas y no requieren competencias técnicas adicionales. Por ejemplo, los reactivos “Hago fotos con una cámara digital” y “Grabo videos con una cámara digital” se unificaron en el reactivo “Saco fotos y videos con el celular”, ya que esta funcionalidad está ahora integrada en los elementos básicos de los teléfonos móviles.

Asimismo, se realizaron los ajustes semánticos y lexicográficos necesarios para la adaptación cultural del instrumento, modificando algunas palabras para que se ajustaran al vocabulario que comúnmente se emplea en la región. Por ejemplo, el vocablo “teléfono móvil” fue reemplazado por “teléfono celular”, que corresponde al uso local de la lengua; o las palabras “ordenador” y “portátil”, que en todos los casos correspondientes fueron sustituidas por “computadora” y “laptop”, vocablos pertenecientes al uso coloquial.

Hubo cambios menores al registro y uso del lenguaje en la enunciación de algunos de los ítems, pues se encontraron instancias reiteradas que obstaculizaban su comprensión. En las subdimensiones de actitudes se cambió la fórmula “soy consciente” por “sé y conozco” en los 4 ítems que la contenían. También se cambió la palabra “pautas” por “instrucciones” en el ítem “Sigo pautas, normas o reglas para saber si la información que encuentro por Internet es verdadera o falsa”; a pesar de que la palabra corresponde a la variante regional de la lengua, en repetidas ocasiones causó problemas de comprensión.

Los reactivos que resultaban redundantes o duplicados por el progreso e integración de las tecnologías también fueron retirados del instrumento, por ejemplo, para los reactivos originales “Envío y recibo mensajes de texto (SMS) en el teléfono móvil.” y “Recibo mensajes multimedia (MMS) con fotos, vídeo o sonido en el teléfono móvil” se integraron en un solo reactivo: “Envío y recibo mensajes con texto, fotos, videos, etc. por SMS, WhatsApp, Messenger, Instagram, etc.”, puesto que las aplicaciones y funcionalidades relacionadas con estas competencias están ahora integradas, o siguen patrones de procesos similares o intuitivos, por lo que no requieren conocimiento técnico específico.

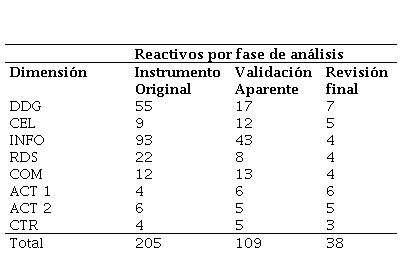

Adicionalmente, se tomó la decisión de que participarían únicamente alumnos de sexto grado, puesto que en todas las instancias en quinto grado se observó una marcada disparidad entre los alumnos respecto a los niveles de comprensión lectora y la capacidad de contestar la encuesta de manera independiente. En total se omitieron 43 reactivos por considerarse obsoletos, o fuera de las competencias digitales técnicas esperadas en el rango de edad de los participantes, 12 reactivos más fueron sintetizados o integrados a otros por considerarse redundantes. El instrumento desarrollado consta de 38 reactivos distribuidos en ocho dimensiones que se enlistan a continuación: DDG, utilización de dispositivos digitales; CEL, manejo de teléfonos móviles; INFO, búsqueda de información; RDS, uso de redes sociales; COM, comunicación en medios digitales; ACT 1, acciones de riesgo; ACT2, acciones de autocuidado –ciberseguridad–; CTR, control en el tiempo de uso y exposición a dispositivos digitales.

Validez estructural: Análisis Factorial Exploratorio

Para evaluar la solución factorial, se utilizó la prueba Kaiser-Meyer-Olkin (kmo) con la prueba de esfericidad de Barlett. En conjunto, estas pruebas son un indicador de que la solución factorial es adecuada (Pizarro y Martínez, 2020). La prueba kmo arroja puntuaciones de entre 0 y 1, siendo una puntuación mayor que .80 excelente, mayor que .50 aceptable y menor que .50 inaceptable. Posteriormente, se revisó la varianza explicada por la solución final, que debe de ser mayor a 40 % y cuyos ítems deben de tener una carga factorial mayor que .30.

Se realizó el análisis factorial exploratorio mediante el método de extracción de ejes principales, utilizando una rotación oblicua para obtener el factor que explica la mayor varianza común; se eligió esta técnica partiendo desde la premisa que los factores están correlacionados (Denis, 2021). En la tabla 2 se muestran los resultados del afe.

Resultados del Análisis Factorial Exploratorio

Fuente: elaboración propia.

La información presentada en la tabla 2 indica que las dimensiones DDG, INFO, RDS, ACT1 y ACT2 muestran un resultado excelente en la prueba kmo. Todos los ítems de estas dimensiones muestran cargas factoriales por encima de .30 y una varianza explicada mayor de 40 %. En el caso de las dimensiones CEL y CTR el resultado de la prueba kmo fue aceptable, sin embargo, se observa que tanto las cargas factoriales como el porcentaje total de varianza explicada es bajo. En el caso de los factores CEL y CTR se observan varianzas totales por debajo del 40 % esperado, aunque muy cercanos a este porcentaje.

En cuanto a la confiabilidad de las escalas, en las subdimensiones DDG, CEL, RDS, ACT1, ACT2 y CTR, el Alfa de Cronbach se encuentra dentro de los parámetros aceptables (mayor que .70) (Oviedo y Campo-Arias, 2005). Para el caso de las dimensiones INFO y COM, los niveles están por encima .60, que a pesar de no ser óptimos suelen indicar una consistencia adecuada y ser aceptados en escalas de medición en ciencias de la educación (Taber, 2018). El coeficiente de confiabilidad, tomando en cuenta todos los ítems, es de .93.

Los procesos anteriormente abordados que corresponden a la validación de contenido, la validación aparente y la realización del análisis factorial exploratorio condujeron a la remoción y reducción de ítems en el instrumento. En la tabla 3, se muestra la síntesis de este proceso.

Distribución de Reactivos por Dimensión

Fuente: elaboración propia.

Discusión y conclusiones

Aunque las explicaciones teóricas de los cambios en la tecnología no son objeto de este trabajo, sus implicaciones prácticas y fácticas son de suma relevancia y deben considerarse en el rediseño y reconfiguración de escalas de medida. Estas pueden analizarse más profundamente desde la teoría de las sustituciones tecnológicas (Dattée et al., 2007), la obsolescencia programada (Jiménez, 2006), la teoría de los paradigmas tecnológicos (García y Salguero, 2020), entre algunas otras. La discusión de estas implicaciones en la constitución de los instrumentos de medida se retoma a continuación.

La validación del constructo es un proceso crucial en la investigación científica, ya que asegura que el instrumento mida realmente lo que se pretende medir, al tiempo que las modificaciones realizadas no alteren su estructura y propósito original (Lloret-Segura et al., 2014). En escalas de medida de competencias digitales este es un aspecto sumamente sensible, de particular importancia frente a la evidencia empírica hasta ahora presentada, es la teoría de la Convergencia Tecnológica, que explica el proceso de unificación, por lo general en un solo dispositivo, de tecnologías previamente distintas y separadas (Borés et al., 2003); o en palabras de uno de sus principales exponentes la “transformación de átomos a bites” (Negroponte, 1996, p. 1). En este trabajo se ejemplifica con la combinación de las tecnologías de los reproductores mp3 y las cámaras digitales, en la actualidad integrados en un solo dispositivo, los teléfonos inteligentes.

En primera instancia, la realización de la validación aparente busca evaluar la calidad superficial de los instrumentos, por lo general, basada en la apreciación subjetiva e intuitiva de los sujetos que la ejecutan, y cuya experiencia o familiaridad con el área de estudio no es de importancia significativa (Carvajal et al., 2011); es decir, es una prueba que apela al sentido común para que los ítems puedan ser entendidos de la forma esperada por la mayoría de los sujetos, estén estos o no familiarizados con el tema.

La validación aparente en poblaciones de niños es particularmente reveladora, sus habilidades cognitivas, de lenguaje y comunicación hacen que este proceso sea más espontáneo y transparente (Quezada y González, 2019), en el caso que atañe a esta investigación, pudo observarse que efectivamente, como se había presumido, los niños desconocían los constructos relacionados a las competencias técnicas para la elaboración de bases de datos o la producción de material audiovisual; por lo que se reafirmó la necesidad de retirarlos de la prueba.

Un aspecto clave observado durante la validación aparente fue una marcada disparidad en la comprensión lectora de los niños de quinto año respecto a los de sexto; esto puede atribuirse, más que al nivel de desarrollo cognitivo por la diferencia de edades, a los rezagos en el aprendizaje causados por el hiato instruccional durante la pandemia (Azevedo et al., 2022; González y Mejía, 2022; Villafuerte, 2020). La diferencia en comprensión lectora entre los grupos de quinto y sexto se observó en las tres escuelas visitadas. Con base en ello se tomó la decisión de solamente tomar como población objeto a los niños que cursaran el sexto grado.

Los ajustes semánticos y lexicológicos son otro punto clave en la adaptación de escalas de medida (Castelhano-Souza et al., 2018), si el grupo objeto de estudio reconoce la prueba como ajena a su contexto no la contestarán o lo harán con sesgos (Campos-Carreño et al., 2020). Bajo esta premisa se adaptaron todos los ítems donde aparecían las palabras “ordenador” y “móvil”, por las variantes del dialecto mexicano “computadora” y “celular”.

Ambuehl e Inauen (2022) enfatizan la importancia de contextualizar las escalas de medida a las condiciones situacionales de las poblaciones objetivo; aunque la herramienta fue diseñada para ser usada en diversos contextos, las condiciones, recursos y dinámicas sociales en áreas rurales son sustancialmente distintas a las urbanas, lo que puede afectar la interpretación y validez de los datos recopilados. Atendiendo a lo anterior, se efectuaron los cambios pertinentes aun cuando parecieran menores.

En cuanto a la validez estructural del instrumento, la prueba Keyser-Mayer-Olkin (kmo), en conjunto con la prueba de esfericidad de Barlett, permitieron verificar la idoneidad del análisis factorial, pero también se encontraron algunas dimensiones que requieren ajustes adicionales. Específicamente, los resultados muestran que las dimensiones DDG, INFO, RDS, ACT1 y ACT obtuvieron puntuaciones excelentes bajo este criterio, respaldando la validez de la estructura factorial en esas dimensiones. Sin embargo, se señala que las dimensiones CEL, y CTR, aunque aceptables en la prueba kmo, presentan varianza explicada por debajo del umbral deseado de 40 % (Denis, 2021).

La evaluación de la consistencia interna es otro aspecto esencial del proceso de validación (Cheung et al., 2023). Los resultados muestran que, en la mayoría de las dimensiones, los indicadores de fiabilidad se sitúan dentro de los parámetros aceptables, y reflejan una estructura confiable. Solo en los casos de INFO y COM, los niveles están ligeramente por debajo del umbral óptimo, pero se argumenta que, en ciencias de la educación, valores por encima de .60 son aceptables (Taber, 2018). Ya que el número de ítems es un aspecto que puede favorecer el índice alfa de Cronbach, futuros estudios podrían ampliar las escalas propuestas en este estudio. Por otra parte, el nivel de confiabilidad global del constructo, medido por el alfa de Cronbach general fue de .93, lo cual suele ser indicativo de un instrumento altamente fiable.

La validación del constructo presentada en este trabajo muestra un enfoque que garantiza la confiabilidad y validez del instrumento de medida. La combinación de pruebas estadísticas, análisis factorial exploratorio y evaluación de la consistencia interna proporciona una sólida base para la aceptación y aplicación del instrumento en la investigación de competencias digitales en las poblaciones objeto de este estudio. Aunque se han identificado áreas de mejora en las dimensiones CEL y CTR, la transparencia en la presentación de los resultados y la toma de decisiones respaldadas por la literatura científica fortalecen la credibilidad del trabajo.

La evidencia de validez del instrumento ofrece un sólido punto de partida en la evaluación de competencias digitales. Desde una perspectiva teórica, este estudio contribuye al campo de la evaluación educativa al proporcionar una herramienta confiable y válida para medir un aspecto clave en la educación contemporánea. Además, ofrece una base para investigaciones futuras sobre el desarrollo y la mejora de la gestión de recursos digitales dirigido a poblaciones infantiles. En términos prácticos, este instrumento puede ser utilizado por educadores y responsables de políticas educativas para evaluar el nivel de competencias digitales de los estudiantes, identificar áreas de mejora y diseñar intervenciones pedagógicas efectivas para promover un eficaz, democrático y responsable uso de la tecnología en diversos ámbitos de la vida pública y privada.

Alcances y limitaciones

Es imprescindible que continúen desarrollándose y validándose permanentemente instrumentos que midan las competencias digitales, el gran desafío subyacente está relacionado con la durabilidad de estos; la constante evolución de las tecnologías impide que cualquier progreso en este ámbito no sea perdurable o, en el mejor de los casos, solo lo sea parcialmente. Se recomienda realizar estudios longitudinales para evaluar la estabilidad y la validez predictiva del instrumento; adicionalmente, se propone desarrollar materiales de apoyo y capacitación para facilitar la implementación del instrumento en el ámbito educativo en formatos distintos a la encuesta impresa, como uso de soportes auditivos o audiovisuales interactivos que faciliten la integración y participación de sujetos con dificultades en la comprensión lectora. En este contexto, las investigaciones futuras en esta área serán determinadas y deberán alinearse al desarrollo, innovación y disponibilidad de tecnologías (Rodríguez et al., 2016).

Referencias

Allmann, K., y Blank, G. (2021). Rethinking digital skills in the era of compulsory computing: methods, measurement, policy and theory. Information, Communication & Society, 24 (5), 633-648. https://doi.org/10.1080/1369118X.2021.1874475

Asociación Mexicana de Agencias de Inteligencia de Mercado y Opinión AC. (2022). Cuestionario para la Aplicación de la Regla AMAI 2022. Recuperado de https://www.amai.org/descargas/CUESTIONARIO_AMAI_2022.pdf

Ambuehl, B., y Inauen, J. (2022). Contextualized Measurement Scale Adaptation: A 4-Step Tutorial for Health Psychology Research. International Journal of Environmental Research and Public Health, 19 (19).https://doi.org/10.3390/IJERPH191912775/S1

Avinç, E., y Doğan, F. (2024). Digital literacy scale: Validity and reliability study with the rasch model. Education and Information Technologies. https://doi.org/10.1007/s10639-024-12662-7

Azevedo, J. P., Gutierrez, M., de Hoyos, R., y Saavedra, J. (2022). The Unequal Impacts of COVID-19 on Student Learning. En F. M. Reimers (Ed.), Primary and Secondary Education During Covid-19: Disruptions to Educational Opportunity During a Pandemic (pp. 421-459). Cambridge, USA : Springer International Publishing. https://doi.org/10.1007/978-3-030-81500-4_16

Borés, C., Saurina, C., y Torres, R. (2003). Technological convergence: a strategic perspective. Technovation, 23 (1), 1-13. https://doi.org/https://doi.org/10.1016/S0166-4972(01)00094-3

Cabero, J., y Martínez, A. (2019). Las tic y la formación inicial de los docentes. Modelos y competencias digitales. Profesorado, Revista de Currículum y Formación del Profesorado, 23 (3), 247-268. https://doi.org/10.30827/profesorado.v23i3.9421

Cabezas-González, M., Casillas-Martín, S., y García-Valcárcel Muñoz-Repiso, A. (2023). Theoretical Models Explaining the Level of Digital Competence in Students. Computers, 12 (5). https://doi.org/10.3390/computers12050100

Carrera, X., Vaquero, E., y Balsells, M. À. (2011). Instrumento de evaluación de competencias digitales para adolescentes en riesgo social. Edutec. Revista Electrónica de Tecnología Educativa, a-154. https://doi.org/10.21556/edutec.2011.35.410

Carvajal, A., Centeno, C., Watson, R., Martínez, M., y Sanz Rubiales, Á. (2011). ¿Cómo validar un instrumento de medida de la salud? Anales del Sistema Sanitario de Navarra, 34, 63-72.http://scielo.isciii.es/scielo.php?script=sci_arttext&pid=S1137-66272011000100007&lng=es&tlng=es.

Castelhano-Souza, M., Costa Mendes, I. A., Martins, J. C. A., Trevizan, M. A., Souza-Júnior, V. D., y de Godoy, S. (2018). Semantic validation of the short versions of the Empathy-Systemizing Quotient Scales. Revista Latino-Americana de Enfermagem, 26, 1-6. DOI: 10.1590/1518-8345.2606.3044

Campos-Carreño, M. L., Velasco, C. B., y Araya, J. P. (2020). Adaptación y validación de escalas de medición en el trabajo. Parte 2: eficacia colectiva. Información tecnológica, 31, 43-52. http://dx.doi.org/10.4067/S0718-07642020000600043

Centro de Investigaciones Comunes de la Comisión Europea. (2022). Marco de Competencias Digitales para la Ciudadanía - Con nuevos ejemplos de conocimientos, habilidades y actitudes (Junta de Castilla y León). Unión Europea (2022) https://somos-digital.org/wp-content/uploads/2022/04/digcomp2.2_castellano.pdf

Comisión Económica Para America Latina y el Caribe [CEPAL] (2021). Datos y hechos sobre la transformación digital. Séptima Conferencia Ministerial sobre la Sociedad de la Información de América Latina y el Caribe. https://www.cepal.org/sites/default/files/publication/files/46766/S2000991_es.pdf

Cheung, G. W., Cooper-Thomas, H. D., Lau, R. S., y Wang, L. C. (2023). Reporting reliability, convergent and discriminant validity with structural equation modeling: A review and best-practice recommendations. Asia Pacific Journal of Management.https://doi.org/10.1007/s10490-023-09871-y

Dattée, B., FitzPatrick, D., y Weil, H. (2007). The dynamics of technological substitutions. https://papers.ssrn.com/sol3/papers.cfm?abstract_id=904671

De León, L., Corbeil, R., y Corbeil, M. E. (2023). The development and validation of a teacher education digital literacy and digital pedagogy evaluation. Journal of Research on Technology in Education, 55 (3), 477-489. https://doi.org/10.1080/15391523.2021.1974988

Denis, J. D. (2021). Factor Analysis. En J., Denis (Ed.). Applied ((Univariate, Bivariate, and Multivariate Statistics: Understanding Statistics for Social and Natural Scientists, with Applications in SPSS and R. pp. 449-496. Nueva Jersey: Willey. https://doi.org/https://doi.org/10.1002/9781119583004.ch14

Deursen, A. J. A. M., y Van Dijk, J. A. G. M. (2008). Measuring digital skills. Performance tests of operational, formal, information and strategic. Internet skills among the Dutch population. ICA Conference.Turin Italy. https://www.utwente.nl/en/bms/vandijk/news/measuring_digital_skills/MDS.pdf

García, M. J., y Salguero, S. W. (2020). Un análisis crítico del cambio tecnológico desde la perspectiva de Giovanni Dosi: trayectorias y paradigmas tecnológicos. Revista Iberoamericana de Ciencia, Tecnología y Sociedad - CTS, 15 (43). https://ojs.revistacts.net/index.php/CTS/article/view/145

Gisbert, M., y Esteve, F. (2016). Digital Leaners: la competencia digital de los estudiantes universitarios. La Cuestión Universitaria (7), 12. https://polired.upm.es/index.php/lacuestionuniversitaria/article/view/3359/3423

Gómez-Fernández, N., y Mediavilla, M. (2021). Exploring the relationship between Information and Communication Technologies (ICT) and academic performance: A multilevel analysis for Spain. Socio-Economic Planning Sciences, 77, 101009. https://doi.org/https://doi.org/10.1016/j.seps.2021.101009

Gómez, D. A., Alvarado, R. A., Martínez, M., y Díaz de León, C. (2018). La brecha digital: una revisión conceptual y aportaciones metodológicas para su estudio en México. Entreciencias: Diálogos en la Sociedad del Conocimiento,6. https://doi.org/10.22201/enesl.20078064e.2018.16.62611

González, J. L., y Mejía, G. (2022). Desventajas educativas, sociales y tecnológicas en tiempos de pandemia: La interseccionalidad en las estudiantes de una unidad UPN en la Ciudad de México. Revista Latinoamericana de Estudios Educativos (México), LII(3), 371-392. https://doi.org/10.48102/rlee.2022.52.3.505

Helsper, E., Schneider, L., Deursen, A. J. A. M., y van Laar, E. (2021). The youth Digital Skills Indicator. https://doi.org/10.5281/zenodo.4476540

Hobbs, R. (2017). Chapter 13 - Measuring the Digital and Media Literacy Competencies of Children and Teens. En F. C. Blumberg y P. J. Brooks (Eds.), Cognitive Development in Digital Contexts (pp. 253-274). San Diego: Academic Press. https://doi.org/https://doi.org/10.1016/B978-0-12-809481-5.00013-4

Hu, X., Gong, Y., Lai, C., y Leung, F. K. S. (2018). The relationship between ICT and student literacy in mathematics, reading, and science across 44 countries: A multilevel analysis. Computers & Education, 125, 1-13. https://doi.org/https://doi.org/10.1016/j.compedu.2018.05.021

Jiménez, A. (2006). Preservación digital vs obsolescencia de la información. Apertura, 6 (3), 101-107. https://www.redalyc.org/articulo.oa?id=68800309

Kontkanen, S., Pöntinen, S., Kewalramani, S., Veresov, N., y Sari, H.-N. (2023). Children’s digital competence in early childhood education: A comparative analysis of curricula. Eurasia Journal of Mathematics, Science and Technology Education, 19, em2215. https://doi.org/10.29333/ejmste/12798

Li, X., y Hu, R. (2022). Developing and validating the digital skills scale for school children (DSS-SC). Information, Communication & Society, 25 (10), 1365-1382. https://doi.org/10.1080/1369118X.2020.1864002

Lloret-Segura, S., Ferreres-Traver, A., Hernández-Baeza, A., y Tomás-Marco, I. (2014). El Análisis Factorial Exploratorio de los Ítems: una guía práctica, revisada y actualizada. Anales de Psicología, 30, 1151-1169. https://dx.doi.org/10.6018/analesps.30.3.199361

Nascimbeni, F., y Vosloo, S. (2019). Digital Literacy for Children Exploring definitions and frameworks. https://www.unicef.org/globalinsight/media/1271/file/%20UNICEF-Global-Insight-digital-literacy-scoping-paper-2020.pdf

Negroponte, N. (1996). The DNA of Information. En A. A. Knopf (Ed). Being Digital (p. 1). Kent, Great Britain Knopf Doubleday Publishing Group.

Oviedo, H. C., y Campo-Arias, A. (2005). Aproximación al uso del coeficiente alfa de Cronbach. Revista Colombiana de Psiquiatría, 34 (4), 572-580. https://www.redalyc.org/pdf/806/80634409.pdf

Pedaste, M., Kallas, K., y Baucal, A. (2023). Digital competence test for learning in schools: Development of items and scales. Computers y Education, 203, 104830. https://doi.org/https://doi.org/10.1016/j.compedu.2023.104830

Pizarro, K., y Martínez, E. O. (2020). Análisis factorial exploratorio mediante el uso de las medidas de adecuación muestral KMO y esfericidad de bartlett para determinar factores principales. Journal of Science and Research: Revista Ciencia e Investigación, 5, (1), 903-924. https://doi.org/10.5281/zenodo.4453224

Quezada, A. M., y González, S. (2019). Validación de apariencia de la prueba general para la evaluación del desarrollo (EVADE) en niños, niñas y adolescentes entre los 6 y 14 años. Boletín médico del Hospital Infantil de México, 76 (6), 273-280.https://doi.org/10.24875/BMHIM.19000024

Rantala, L. (2010). Chapter 6 - Digital literacies as school practices. En A. Lloyd y S. Talja (Eds.), Practising Information Literacy (pp. 121-141). Wagga Wagga, Australia: Chandos Publishing.. https://doi.org/https://doi.org/10.1016/B978-1-876938-79-6.50006-6

Restrepo, S., y Segovia, Y. (2020). Diseño y validación de un instrumento de evaluación de la competencia digital en Educación Superior. Ensaio: Avaliação e Políticas Públicas em Educação, 28, 932. https://www.scielo.br/j/ensaio/a/drhg5xNnxgyHXQs9JcCwHQS/abstract/?format=html&lang=es

Rodríguez, I., Igartua, J. J., y González, A. (2016). Development and validation of a digital literacy scale for teenagers. Proceedings of the Fourth International Conference on Technological Ecosystems for Enhancing Multiculturality, Salamanca, España. https://doi.org/10.1145/3012430.3012648

Salazar, E., Tobón, S., y Juárez, L. (2018). Diseño y validación de una rúbrica de evaluación de las competencias digitales desde la socioformación. Apuntes Universitarios. Revista de Investigación, 8, 24.https://www.redalyc.org/articulo.oa?id=467657107002

Starkey, L., Shonfeld, M., Prestridge, S., y Cervera, M. G. (2021). Special issue: Covid-19 and the role of technology and pedagogy on school education during a pandemic. Technology, Pedagogy and Education, 30 (1), 1-5. https://doi.org/10.1080/1475939X.2021.1866838

Shin, T. S., Hwang, H., Park, J., Teng, J. X., y Dang, T. (2019). Digital Kids Asia-Pacific. Insights into Children’s Digital Citizenship.https://unesdoc.unesco.org/ark:/48223/pf0000367985

Sillat, L., Tammets, K., y Laanpere, M. (2021). Digital Competence Assessment Methods in Higher Education: A Systematic Literature Review. Education Sciences, 11, 402.

Silva, J., y Morales, E. M. (2022). Assessing digital competence and its relationship with the socioeconomic level of Chilean university students. International Journal of Educational Technology in Higher Education, 19 (1), 46. https://doi.org/10.1186/s41239-022-00346-6

Sociedad Mexicana de Psicología. (2007). Código ético del psicólogo. México: Trillas.

Taber, K. S. (2018). The Use of Cronbach’s Alpha When Developing and Reporting Research Instruments in Science Education. Research in Science Education, 48 (6), 1273-1296. https://doi.org/10.1007/s11165-016-9602-2

Tzafilkou, K., Perifanou, M., y Economides, A. A. (2022). Development and validation of students’ digital competence scale (SDiCoS). International Journal of Educational Technology in Higher Education, 19 (1), 30. https://doi.org/10.1186/s41239-022-00330-0

Unión Internacional de Telecomunicaciones [uit]. (2009). El nuevo índice de la uit mide el desarrollo de las tic en 154 países. Actualidades de la uit. https://www.itu.int/itunews/manager/display.asp?lang=es&year=2009&issue=03&ipage=36

Unión Internacional de Telecomunicaciones [uit]. (2020). Meeting of the Expert Group on Telecommunication/ICT Indicators (EGTI). https://www.itu.int/en/ITU-D/Statistics/Documents/events/egh2020/IDI2020

Van Dijk, J. (2020). The Digital Divide. Cambridge, UK : Polity Press.

Vardan, M., Gamidullaeva, L., Finogeev, A., Chernyshenko, S., Chernyshenko, V., Amirov, D., y Potapova, I. (2021). Big Data and Internet of Things (IoT) Technologies' Influence on Higher Education: Current State and Future Prospects. International Journal of Web-Based Learning and Teaching Technologies, 16, 137-157. DOI:10.4018/IJWLTT.20210901.oa8

Villafuerte, P. (2020). Educación en tiempos de pandemia: COVID-19 y equidad en el aprendizaje. Observatorio. https://observatorio.tec.mx/edu-news/educacion-en-tiempos-de-pandemia-covid19

Zelaya, L. A. C. (2020). Subalternidad en Costa Rica: brechas educativas y oportunidades en una sociedad globalizada y digital. InterSedes: Revista de las Sedes Regionales, XXI (44), 222-237. https://dx.doi.org/10.15517/isucr.v21i44.43945

Notas de autor

-

Bautista, G. ., Vera, J. Á., y Tánori, J. (2024). conducta prosocial, desconexión moral y empatía en observadores en situaciones de violencia escolar. Psykhe, 33(1). https://doi.org/10.7764/psykhe.2021.36971.

-

Lagarda, Á. E., Vera, J. Á., Zurita, Ú. y De Gunther, L. (2024). Enfrentamiento docente como mediador entre apoyo social y eficacia colectiva en violencia escolar. Revista Colombiana de Educación, (90), 355-374. https://doi.org/10.17227/rce.num90-16088.

-

Navarro, C. D., Bauman, S., Vera, J. Á., y Lagarda, A. E. (2023). Psychometric Properties of a Cyberaggression Measure in Mexican Students. Behavioral Sciences, 14 (1), 19. https://doi.org/10.3390/bs14010019.

-

Sainz, M. A., Vera, J. Á., Peña, M. O., y Tánori, J. (2024). Variables sociodemográficas y percepción de prejuicios de las personas con discapacidad. Ciencias Psicológicas, 18 (1), e-3109. https://doi.org/10.22235/cp.v18i1.3109

-

Sainz, M. A., Vera, J. Á., Tánori, J., y Peña, M. O. (2023). Escala de apoyo social hacia alumnos con discapacidad en educación superior. Validez de contenido. Innovación Educativa, 23 (93), 52-73. https://www.ipn.mx/assets/files/innovacion/docs/Innovacion-Educativa-93/Escala-de-apoyo-social-hacia-alumnos-con-discapacidad.pdf

-

Sainz, M. A., Vera, J. Á., y Tánori-Quintana, J. (2022). Características métricas de la escala de actitudes hacia las personas con discapacidad (EAPD). Revista Evaluar, 22 (2), 14-29. https://doi.org/10.35670/1667-4545.v22.n2.38683

jose.vera@unison.mx

Información adicional

Paginación electrónica: e25.88380

Información adicional

redalyc-journal-id: 4576