Miscelánea

Esta obra está bajo una Licencia Creative Commons Atribución-NoComercial-CompartirIgual 4.0 Internacional.

Recepción: 10 Octubre 2025

Revisado: 25 Noviembre 2025

Aprobación: 08 Febrero 2026

Publicación: 01 Marzo 2026

DOI: https://doi.org/10.17163/uni.n44.2026.08

Resumen: La irrupción de herramientas de inteligencia artificial (IA) generativa plantea retos, dilemas éticos y morales, necesidades de nuevos marcos regulatorios e implementación de novedosas rutinas de trabajo, especialmente en el ámbito de la comunicación política e institucional. Este artículo realiza un estudio exploratorio sobre el uso y aplicaciones de estas herramientas por parte de los diputados/as del Parlamento de Galicia (España), destacando entre sus objetivos determinar el grado de uso, identificar las más utilizadas, las principales ventajas e inconvenientes, las labores parlamentarias en las que más se emplean, hallar posibles diferencias entre tendencias ideológicas y relacionar su uso con el fenómeno de la desinformación. Para ello se llevó a cabo una revisión bibliográfica y se contrastaron las hipótesis de partida con las respuestas de un cuestionario online remitido a los 75 diputados/as del Parlamento gallego y con los resultados del análisis mediante ChatGPT y GPTZero al que fue sometida una muestra de diversas iniciativas de todos los grupos parlamentarios, las tratadas en los plenos del mes de junio de 2025, a fin de determinar el porcentaje de texto generado por IA y de desinformación presente en esa muestra. Los resultados y conclusiones evidencian el uso generalizado de la IA en la cámara legislativa gallega, pero en porcentajes bajos y con unos límites éticos que consisten en recurrir a ella únicamente como base de un trabajo que cuenta con un control y una aportación fundamentalmente humana. Los diputados/as, además de utilizar esta herramienta, se muestran favorables, en general, a su regularización, reclaman más formación específica en la materia y es ChatGPT el software dominante, siendo anecdótico el uso de otras herramientas de IA.

Palabras clave: Inteligencia artificial generativa, ChatGPT, DeepSeek, desinformación, discurso, política, parlamento, Galicia.

Abstract: The emergence of generative artificial intelligence (AI) tools poses challenges, ethical and moral dilemmas, the need for new regulatory frameworks, and the implementation of novel work routines, especially in the field of political and institutional communication. This article conducts an exploratory study on the use and application of these tools by members of the Parliament of Galicia (Spain). Its objectives include determining the degree of use, identifying the most frequently used tools, their main advantages and disadvantages, the parliamentary tasks in which they are most frequently used, identifying possible differences between ideological tendencies, and relating their use to the phenomenon of disinformation. To this end, a bibliographic review was carried out and the initial hypotheses were compared with the responses to an online questionnaire sent to the 75 members of the Galician Parliament and with the results of the analysis using ChatGPT and GPTZero to a sample of various initiatives from all parliamentary groups, those discussed in the plenary sessions of June 2025, in order to determine the percentage of AI-generated text and disinformation present in that sample. The results and conclusions show the widespread use of AI in the Galician legislative chamber, but at low percentages and with ethical limits that consist of using it only as a basis for work that has fundamentally human control and contribution. The members of parliament, in addition to using this tool, are generally in favor of its regulation, demand more specific training on the subject, and ChatGPT is the dominant software, with the use of other AI tools being anecdotal.

Keywords: Generative artificial intelligence, ChatGPT, DeepSeek, disinformation, speech, politics, parliament, Galicia.

Forma sugerida de citar: (APA)

Puentes-Rivera, I., Fernández-Souto, A. B. y Vázquez-Gestal, M. (2026). Desinformación e inteligencia artificial en el discurso político: uso de IA generativa en el Parlamento de Galicia (España). Universitas XX1, 44, pp. 205-231. https://doi.org/10.17163/uni.n44.2026.08

Introducción y estado de la cuestión

Aunque existen múltiples modelos extensos de lenguaje (LLM por sus siglas en inglés), ChatGPT de origen estadounidense, es uno de los más visibles y usados, mientras que DeepSeek representa una variante más reciente. ChatGPT fue lanzado en 2022 y alcanzó 100 millones de usuarios mensuales en solo dos meses (Baum y Villasenor, 2023). DeepSeek es un modelo similar, presentado en 2025, pero más restringido en algunos entornos institucionales y gubernamentales por los temores que su vinculación al gobierno de la República Popular China genera en algunos Estados desde el punto de vista de la seguridad nacional (Deepes, 2025). Ambos sistemas se diseñaron para generar texto coherente y contextual, capaces de apoyar desde redacción de discursos hasta respuestas automatizadas (Foos, 2024).

Desde su presentación en noviembre de 2022, ChatGPT ha protagonizado una explosión de estudios e investigaciones académicas en el ámbito de las ciencias sociales. Se verificaron 156 publicaciones indexadas en Scopus sobre esta herramienta entre noviembre 2022 y abril 2023 y más de 4600 durante todo el año 2023, con más de 2600 en los primeros meses de 2024 (Marino y Giglietto, 2024), lo que da buena idea de ese interés masivo por su aplicación al análisis discursivo, experimentos sociales y encuestas digitales, entre otras utilidades.

Por su parte, DeepSeek, el modelo de IA desarrollado en China, ha sido objeto de estudio en revistas como Nature (Conroy y Mallapaty, 2025), centrándose en este caso más la producción científica, como se ha apuntado, en su impacto geopolítico. Algunos documentos oficiales e investigaciones, de origen fundamentalmente estadounidense, destacan preocupaciones sobre DeepSeek en relación con la extracción ilegal de conocimientos de OpenAI, empresa desarrolladora de ChatGPT, censura automatizada y transferencia de datos sensibles a infraestructuras asociadas al Gobierno chino (Congreso de los Estados Unidos, 2025; Mok, 2025). Existe, en todo caso, también una línea de investigación que destaca las ventajas de DeepSeek desde el punto de vista de la democratización en el acceso global a IA avanzada (Baydemir, 2025).

Desinformación, inteligencia artificial y discurso político

La desinformación se ha consolidado como una amenaza global a la integridad del debate público y la democracia (Csernatoni, 2024), especialmente con el auge de la inteligencia artificial (IA) y los modelos generativos, que permiten producir y amplificar información falsa a gran escala y con alta persuasión. En particular, se ha observado que los modelos extensos de lenguaje (LLM), como ChatGPT, pueden inundar medios y espacios sociales con contenido que difumina lo real de lo fabricado ad hoc, erosionando la confianza ciudadana (Kreps y Kriner, 2024).

Autores como López Borrull y Lopezosa (2025) analizan 64 estudios académicos publicados entre 2021 y 2024 sobre este asunto y confirman la naturaleza ambivalente de la IA generativa (IA-G), que puede tanto diseminar desinformación como ofrecer herramientas para detectarla, identificando seis áreas clave: desinformación política, educativa y científica, fact checking automatizado, alfabetización mediática y deepfakes. Por su parte, Raman et al. (2024) realizan un análisis de casi 10 000 publicaciones entre 2013 y 2022 en el que muestran cómo las fake news vinculadas con IA generativa han escalado notablemente en los últimos años, destacando la necesidad de estudios centrados en verificación automatizada y ética digital.

Por su naturaleza de garante de la conformación de una opinión pública formada, pilar esencial de cualquier democracia real, es en el ámbito de la comunicación política, junto con los medios de comunicación, donde estos riesgos y debates se manifiestan de un modo más patente. En el ámbito político, la comunicación ha evolucionado también para incluir estrategias sofisticadas de microtargeting y generación de contenido personalizado mediante IA, con un riesgo claro de erosión de la confianza y representatividad democrática por la generación masiva de contenido engañoso (Kreps y Kriner, 2024). Estudios recientes demuestran que ChatGPT y otros modelos pueden inclinar debates hacia posturas particularizadas, especialmente cuando conocen datos demográficos de la audiencia, llegando a ser más persuasivos que los propios seres humanos; un nivel de persuasión que plantea riesgos evidentes de manipulación informativa y polarización (Davis, 2025).

La posibilidad de generar mensajes altamente personalizados mediante IA permite diseñar discursos políticos que apelan a creencias específicas del público objetivo, aumentando su efecto persuasivo. Los modelos generativos pueden emitir hallucinations (información coherente pero falsa) que, sin la supervisión humana adecuada, pueden introducir errores factuales en discursos políticos redactados mediante IA. Además, ciertos estudios identifican sesgos políticos implícitos en las respuestas de estos modelos, que podrían influir en el contenido generado para parlamentos o gabinetes institucionales (Motoki et al., 2025).

La irrupción de la inteligencia artificial generativa está redefiniendo, por tanto, la producción y transmisión del discurso político. Estas tecnologías permiten generar contenido textual persuasivo, personalizado y en masa, lo cual genera nuevos riesgos de desinformación intencional o accidental, a lo que se suma la capacidad de los modelos generativos para aumentar el volumen y la calidad de contenidos falsos o engañosos.

Sin embargo, autores como Simon et al. (2023) enmarcan estas preocupaciones sobre la IA en “una antigua y amplia familia de pánicos morales en torno a las nuevas tecnologías” y argumentan que el impacto sobre el consumo real de desinformación podría ser más limitado de lo esperado, pues la demanda no necesariamente aumenta con la oferta y la mayoría de usuarios sigue consumiendo contenidos de medios de comunicación, tamizados por las rutinas profesionales y la curación de contenidos.

En el lado de la perspectiva positiva sobre la IA, utilizándola incluso para combatir la desinformación, destacan iniciativas como Full Fact (fullfact.org), NewsGuard (newsguardtech.com) y herramientas impulsadas por proyectos europeos como REVEAL (revealdata.com), AI4TRUST (cordis.europa.eu/project/id/101070190) o VERA.ai (veraai.eu), que utilizan IA para detectar, clasificar y rastrear narrativas falsas en tiempo real. Esta doble capacidad de generar, pero también detectar contenido falso subraya la necesidad de enfoques contextuales y supervisión humana, empleando la IA como asistencia o herramienta, pero con un control finalmente racional.

En este sentido, estudios de opinión como el realizado a la población andaluza y referenciado por Garriga et al. (2024) reflejan que, aunque el 86 % de la ciudadanía considera que la IA facilita la producción de fake news, un 54 % cree que también puede ayudar a combatirlas, lo que deja abierta la puerta del apoyo ciudadano a modelos híbridos de vigilancia y verificación automatizada (fact checking automatizado), siempre acompañados de supervisión humana.

En el ámbito político, algunos estudios exploran también cómo periodistas y actores políticos utilizan modelos generativos para redactar discursos, anuncios o contenido en redes sociales. Simon et al. (2023) destacan cómo los medios de comunicación institucionales y las campañas electorales podrían aumentar la velocidad y escala de distribución de mensajes falsos, aunque también se benefician de la IA en la producción de contenidos veraces. Para estos autores muchas preocupaciones en torno a la IA son especulativas y no están sustentadas por evidencia empírica sólida. Sería más realista, por tanto, enfocar la atención en fortalecer el ecosistema informativo mediante refuerzo de instituciones periodísticas, alfabetización digital y regulación adecuada de estas tecnologías que combatirlas frontalmente, sin más.

En relación con esto, cabe destacar que en diciembre de 2024 el Consello da Xunta de Galicia, órgano ejecutivo del gobierno autonómico gallego, aprobó el Proyecto de Ley para el desarrollo e impulso de la IA en Galicia, convirtiéndose en la primera región europea en impulsar una legislación específica sobre inteligencia artificial (Xunta de Galicia, 2024). Este proyecto, transformado en ley el 24 de abril de 2025 (DOG, 2025), no nombra explícitamente ChatGPT u otros LLM, ni aborda directamente la generación automatizada de contenido político, pero establece la implantación de mecanismos de evaluación de impacto en derechos fundamentales, oficinas de supervisión bajo control humano, emisión obligatoria de informes, aplicación del principio de transparencia y un registro público de sistemas de IA utilizados por la administración, además de la creación de un Comisionado en IA. Todos estos elementos proporcionan un marco institucional robusto para exigir transparencia en las comunicaciones públicas generadas mediante IA, incluyendo aquellas emanadas del Parlamento de Galicia y del resto de instituciones. Todo ello revela una predisposición institucional a evitar riesgos de generación automatizada de texto no verificado, lo cual tiene implicaciones directas para futuras aplicaciones parlamentarias y la comunicación política en general; reconociendo la potencia disruptiva de modelos de lenguaje, como ChatGPT, y buscando evitar el uso indiscriminado de los mismos, que podría derivar en discursos no contrastados o manipulaciones discursivas.

En resumen, podríamos sintetizar el impacto de la inteligencia artificial generativa en el discurso político en los siguientes aspectos:

- 1. Aumento del volumen de producción y mejor personalización o individualización de los públicos: la IA permite producir discursos altamente adaptados al público y reproducirlos a gran escala, lo que puede amplificar la persuasión de mensajes engañosos.

- 2. Errores no intencionales y sesgos: sin supervisión humana, los modelos pueden incluir información incorrecta o ideológicamente sesgada.

- 3. Contrapeso mediante la IA aplicada a la verificación: existen ya herramientas avanzadas para clasificar y frenar la desinformación, aunque requieren de mayor impulso institucional.

- 4. Necesidad de aplicación ética en el discurso político: partidos políticos, gabinetes e instituciones públicas pueden utilizar la IA como ayuda para la redacción y creación de diferentes materiales, pero esto requiere el desarrollo y aplicación de estándares éticos y de transparencia.

- 5. Necesidad de evidencias empíricas y regulación específica: se debe equilibrar el miedo excesivo al impacto de las tecnologías basadas en IA con políticas públicas efectivas y estudios críticos, que contemplen los riesgos, pero también los beneficios del uso de la inteligencia artificial en el discurso y el debate político.

Uso de la inteligencia artificial en la política parlamentaria y los gabinetes de comunicación

Más de 20 parlamentos en todo el mundo —entre ellos el Parlamento Europeo y los de Brasil, Canadá, Dinamarca, Estonia e Italia— investigan o están implementando el uso de inteligencia artificial con fines de asistencia parlamentaria (IPU, 2024). Estas aplicaciones incluyen, entre otras, la generación de textos, el análisis automatizado de discursos o transcripciones y el apoyo a las consultas ciudadanas.

En el caso concreto de los parlamentos, estudios como el de Evkoski y Pollak (2023) demuestran cómo modelos de lenguaje permiten analizar y predecir inclinaciones políticas en discursos parlamentarios mediante machine learning explicable. Por su parte, otras investigaciones recientes analizan cómo ChatGPT puede exhibir sesgos políticos y una desalineación con valores sociales predominantes, rechazando con frecuencia la generación de determinados contenidos y tendiendo a representar perspectivas consideradas mainstream (Motoki et al., 2025).

Esto resulta especialmente relevante en contextos parlamentarios, donde los modelos extensos de lenguaje podrían contribuir a automatizar y estandarizar discursos, preguntas y respuestas, en detrimento del pluralismo ideológico.

En el caso concreto de España existen pocos estudios vinculados a la desinformación en ámbitos locales y regionales o autonómicos y, de los que hay, un buen número están centrados en episodios de desinformación vinculados a contextos políticos específicos como el proceso independentista en Cataluña (Aparici et al., 2019), convocatorias electorales concretas (Rivas-de-Roca et al., 2022), prácticas y rutinas en los gabinetes de comunicación institucionales (Vázquez-Gestal et al., 2024) o investigaciones generales sobre los estudios de desinformación en España (Rúas-Araújo y Paniagua-Rojano, 2023; Morais y Piñeiro, 2025). No se ha hallado en la producción científica analizada, ninguna investigación centrada en la aplicación de herramientas de IA al discurso y trabajo parlamentario. En este sentido, el presente estudio se configura como pionero, al abrir una línea de investigación en el ámbito de los parlamentos autonómicos. Tan solo cabe destacar una publicación de la Asamblea de Madrid que, entre otros aspectos, reflexiona sobre la “seguridad jurídica en el uso de la IA en el ámbito parlamentario” (De Alba Bastarrechea, 2025).

En el terreno institucional, muchos gabinetes de comunicación han incorporado la IA a sus rutinas de trabajo diarias para, entre otras tareas, redactar comunicados, preparar respuestas a la prensa, generar resúmenes informativos y argumentarios, o monitorizar redes sociales en tiempo real. Existe evidencia a nivel global de su uso regular en campañas políticas y en oficinas de prensa institucional de todo tipo (López Borrull y Lopezosa, 2025), recurriéndose a la IA generativa para redactar correos de campaña, anuncios o discursos (Foos, 2024). Asimismo, en el ámbito científico, proyectos desarrollados por periodistas e investigadores de datos han combinado ChatGPT con trabajo humano para el análisis de la retórica política (Troboukis et al., 2024).

No existen estudios sobre el uso de IA generativa en las instituciones públicas o los gabinetes de comunicación institucional del ámbito de la comunidad autónoma de Galicia. Cabe destacar, no obstante, de modo indirecto la realización de campañas educativas como AulaCheck, promovida por la Xunta de Galicia y FECYT: Fundación Española para la Ciencia y Tecnología (Xunta de Galicia, 2024), que demostraría implícitamente una preocupación o sensibilización por combatir bulos utilizando herramientas basadas en inteligencia artificial y fomentando el pensamiento crítico entre estudiantes gallegos, además de una conciencia institucional sobre los riesgos de la IA en el discurso público.

Hasta la fecha, no existen tampoco publicaciones formalmente indexadas con entrevistas directas a diputados/as gallegos sobre el uso de ChatGPT o IA en su trabajo. No obstante, de entrevistas a expertos en medios de comunicación y de la propia Declaración institucional en favor de un desarrollo ético y centrado en el ser humano en Galicia (Parlamento de Galicia, 2022) se pueden extraer declaraciones de intenciones útiles y reveladoras. Así, en una entrevista televisada, Teresa Rodríguez de las Heras, experta en IA de la Comisión Europea, enfatiza la importancia de supervisión y transparencia en el uso parlamentario de IA para evitar diseminación de fake news (RTVE, 2023); en su intervención ante la Comisión Mixta de Seguridad Nacional del Parlamento de España evidenció que la inteligencia artificial generativa puede influir en la deliberación legislativa, riesgo que podría extrapolarse claramente al Parlamento de Galicia.

En relación con la Declaración institucional del Parlamento de Galicia, antes referenciada, el apoyo conjunto, explícito o implícito, de todos los grupos demuestra una apuesta compartida de los diferentes diputados/as por la necesidad de supervisión y calidad en el uso de herramientas automatizadas de redacción parlamentaria, alineándose con las directrices europeas en esta materia. Aunque no se aborden directamente casos de desinformación, esta disposición normativa sugiere un contexto que anticipa problemas comunicativos derivados del uso de IA no regulada.

Por último, de modo complementario, cabe destacar que la literatura sobre redes sociales en España señala que grupos políticos como VOX utilizan sus perfiles en redes sociales para difundir discursos polarizados sustentados en desinformación y estrategias de manipulación (Teruel y García, 2025; Olmos, 2023). En el caso de Galicia estas dinámicas podrían adquirir formas específicas en campañas vinculadas a inmigración o género, en línea con patrones observados también en el ámbito internacional (Díaz et al., 2023). Son múltiples los casos virales de responsables políticos que usaron en sus medios sociales discursos altamente generativos en mensajes virales, que luego pusieron en cuestión la autoría humana del contenido. Estas dinámicas se podrían replicar en el contexto gallego.

Límites éticos y morales en los usos de la inteligencia artificial

El uso de IA en política genera, sin duda, dilemas éticos relacionados con transparencia, responsabilidad de contenidos, privacidad de datos, parcialidad ideológica, reducción del pluralismo político o equidad, entre otros (Kreps y Kriner, 2024; Baum y Villasenor, 2023). Además, la mayoría de marcos éticos existentes carecen de mecanismos vinculantes, lo que limita su efectividad real a la voluntariedad de cada cual.

En el ámbito de la Unión Europa, el marco regulatorio común, como la Ley de Inteligencia Artificial (Diario Oficial de la Unión Europea, 2024) o el Código de Buenas Prácticas de la UE en materia desinformación (Comisión Europea, 2022), impulsan obligaciones de transparencia, detección de contenido generado por IA, etiquetado y rendición de cuentas; sin embargo, el cumplimiento y la adhesión efectiva por parte de los Estados miembros siguen siendo un desafío y un ambicioso objetivo pendiente de cumplimiento efectivo (Csernatoni, 2024).

De acuerdo con todo ello, los límites éticos sobre la IA y, en particular, sobre su aplicación en la esfera política e institucional, giran en torno a tres ejes claves:

- 1. Transparencia y responsabilidad: la falta de claridad y de herramientas adecuadas a día de hoy para determinar de modo unívoco si un mensaje fue generado por IA socava la responsabilidad comunicativa (Yip y Balagué, 2023).

- 2. Privacidad y soberanía de datos: DeepSeek, por ejemplo, plantea dilemas de transferencia transfronteriza, seguridad geopolítica y posible violación del RGPD: Reglamento General de Protección de Datos de la UE (Mok, 2025).

- 3. Neutralidad ideológica: en la medida en que la IA opta por contenidos más generalistas y mainstream, huye de ciertos contenidos más alternativos o minoritarios desde el punto de vista social y electoral, lo que puede restringir la deliberación parlamentaria y el pluralismo ideológico (Motoki et al., 2025).

En el caso concreto de Galicia, además, la Declaración institucional en favor de un desarrollo ético y centrado en el ser humano en Galicia (Parlamento de Galicia, 2022), ya comentada, revela la posición de los grupos parlamentarios (PP, BNG y PSdeG-PSOE) a favor de valores como el respeto a los derechos fundamentales y la gobernanza ciudadana. Esto configura, sobre el papel, unos límites éticos unánimemente compartidos para limitar el uso de IA generativa en discursos políticos sin supervisión humana o sin la transparencia adecuada.

Materiales y métodos

Objetivos e hipótesis

La investigación que fundamenta este artículo parte del objetivo general (OG) de analizar el uso de la inteligencia artificial en el trabajo parlamentario y su posible relación con la desinformación. Objetivo general que se concreta en los siguientes objetivos específicos:

OE1: determinar el grado de uso de la IA en ese ámbito.

OE2: identificar las más herramientas de IA más utilizadas en el Parlamento de Galicia.

OE3: conocer las principales ventajas e inconvenientes de su uso.

OE4: las labores parlamentarias en las que más se emplean.

OE5: hallar posibles diferencias entre tendencias ideológicas.

OE6: relacionar su uso con el fenómeno de la desinformación.

Entre las hipótesis de partida destacan:

H1: la IA generativa, como ChatGPT o DeepSeek, se ha convertido ya en una herramienta de trabajo habitual en parlamentos.

H2: los parlamentos, incluido el de Galicia, están adoptando IA generativa como herramienta para generar textos e intervenciones.

H3: los diputados/as no reconocen de forma general su uso.

H4: este se hace de manera poco planificada y poco profesional.

H5: el uso de IA puede traducirse en un mayor nivel de desinformación.

Método

Para la realización de esta investigación se siguió una metodología mixta, basada en técnicas cualitativas y cuantitativas. En primer lugar, se llevó a cabo una revisión bibliográfica con asistencia de inteligencia artificial, utilizando la versión de pago de ChatGPT ofertada por la Universidad de Vigo a su personal investigador (ChatGPT Plus 5), para obtener un repaso más exhaustivo de las principales referencias relacionadas con el objeto de estudio, que fueron posteriormente sometidas a un proceso de revisión y verificación por parte de los autores.

En segundo lugar, a fin de contrastar, los resultados de este vaciado hemerográfico y de obtener un mejor conocimiento del objeto de estudio, junto con una mayor calidad de los resultados y conclusiones, se optó por una triangulación metodológica, que incluye un cuestionario online de 25 preguntas, remitido a los 75 diputados/as del Parlamento de Galicia en el mes de julio de 2025,[1] obteniéndose 12 respuestas, lo que significa un 16 % del total; junto con un análisis de todas las iniciativas escritas (proposiciones de ley, proposiciones no de ley, preguntas e interpelaciones) que los cuatro grupos parlamentarios (PP: Partido Popular, BNG: Bloque Nacionalista Galego, PSdeG-PSOE: Partido de los Socialistas de Galicia y DO: Democracia Ourensana, integrado este último en el Grupo Mixto) trataron en las dos sesiones plenarias de junio de 2025 (10-11 y 24-25 de junio), extraídas del orden del día disponible en el portal web del Parlamento de Galicia (parlamentodegalicia.gal). Esta documentación fue sometida a un doble análisis, por una parte, se calculó con ayuda del ChatGPT de la Universidad de Vigo y del software GPTZero (app.gptzero.me) el porcentaje de probabilidades de que en dichos documentos se incluyese texto generado con asistencia de IA y, por otra, con la ayuda del mismo ChatGPT se halló el nivel de desinformación presente en los mismos textos. Conviene destacar que, si bien estas dos herramientas no están validadas científicamente para este fin, el carácter exploratorio del estudio y el objeto del mismo, centrado en la IA, sugieren la oportunidad de emplearlas a modo de comprobar cómo pueden contribuir a ello.

El recurso a GPTZero deriva, en todo caso, de una consulta realizada a ChatGPT sobre programas adecuados para calcular la generación de texto mediante IA y, sobre todo, de la consulta de fuentes especializadas (Fernández, 2025).

Finalmente, se relacionaron los resultados obtenidos por los diferentes métodos y se extrajeron las conclusiones que figuran en el apartado correspondiente.

Tabla 1

Muestra obtenida para el estudio

Análisis y resultados

Cuestionario online realizado a los diputados/as del Parlamento de Galicia sobre el uso que hacen de la IA generativa

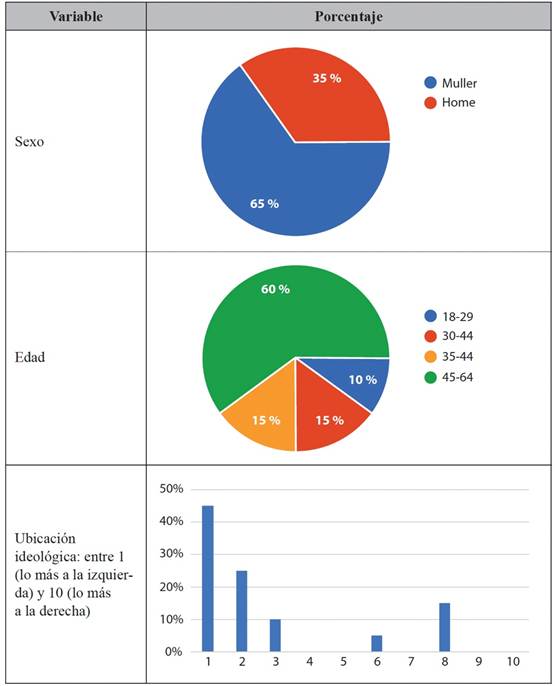

Lo primero que cabe destacar es que no se observan diferencias significativas ni por sexo ni por franjas de edad en relación con el uso de la IA generativa: tanto en hombres como en mujeres, así como entre diputados/as más jóvenes y de mayor edad, se registran casos de utilización y también de rechazo de esta tecnología. Tampoco se aprecian diferencias desde el punto de vista ideológico, ya que se identifican casos de uso y de no uso tanto en la izquierda como en la derecha del arco parlamentario. No obstante, conviene precisar que el cuestionario fue respondido mayoritariamente por diputados/as situados entre la extrema izquierda y el centroizquierda.

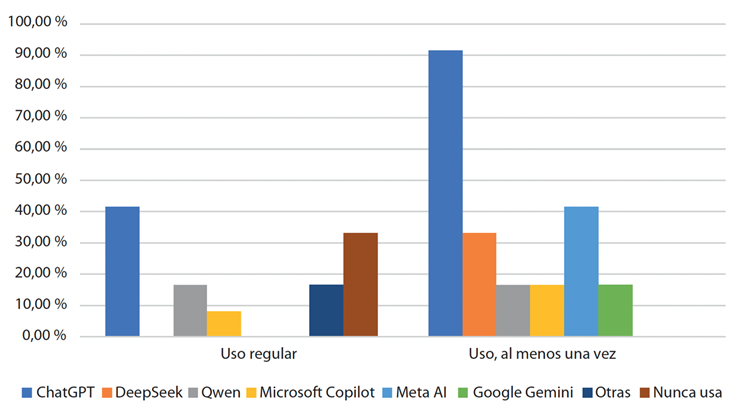

ChatGPT es con diferencia la herramienta de IA generativa más identificada (100 %), seguida de Meta AI, vinculada a WhatsApp (58 %) y DeepSeek (42 %), pero de las 21 sugeridas en el cuestionario son identificadas hasta diez diferentes. En cuanto al uso de IA en su labor parlamentaria, un 33 % de los diputados/as declara no recurrir nunca a ella, frente al doble, un 66 %, que sí admite usarla con regularidad, mayoritariamente (86 %) en versiones gratuitas. Es ChatGPT la herramienta más utilizada de modo habitual (42 %), seguida de Qwen (17 %) y de Microsoft Copilot (8 %). Destaca el nulo uso (0 %) que se hace de DeepSeek. En todo caso, al margen del uso regular, el 100 % de los diputados/as sí reconoce haber usado alguna vez la IA generativa, principalmente ChatGPT (92 %), Meta AI (42 %) y DeepSeek (33 %).

Gráfico 1

Uso de herramientas de IA en el Parlamento de Galicia

Entre las razones que determinan la preferencia por una herramienta u otra no hay una única que prevalezca sobre el resto, señalándose entre las más importantes el ser la única que se conoce, la que ofrece resultados más profesionales y ajustados a lo que se necesita, la que ofrece resultados más fiables, el hecho de citar las fuentes de las que obtiene la información o la facilidad de interaccionar en una lengua determinada, particularmente el gallego. Extremo este último al que se le proporciona especial importancia y que genera un consenso amplio (9,25 sobre 10) a la hora de apoyar que el Gobierno de Galicia destine recursos a favorecer que todas estas herramientas de IA generativa sean usables en gallego.

En cuanto a la frecuencia de uso, la mayoría (83 %) recurre a la IA varias veces al mes, mientras que un 17 % lo hace varias veces al año; nadie afirma utilizarla a diario, ni siquiera varias veces por semana. Tanto ChatGPT como otras herramientas mencionadas se emplean para tareas muy diversas: desde la elaboración de proposiciones, la preparación de intervenciones orales y la generación de contenidos para redes sociales (incluidos memes), hasta la formulación de réplicas in situ durante los debates o la preparación de intervenciones en medios de comunicación.

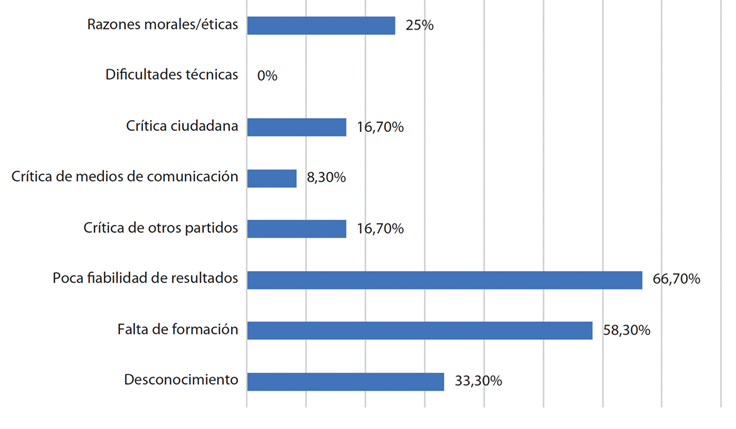

En cuanto a las razones por las que no se usa de modo regular la IA o, aun usándola, suponen un freno para no recurrir a ella con mayor regularidad, los diputados/as destacan mayoritariamente tres, el temor a la fiabilidad de los resultados que proporcionan herramientas como ChatGPT (67 %) y la inseguridad que les proporciona la falta de formación o desconocimiento sobre su manejo (66 %); destacan también las razones morales o éticas (25 %).

Gráfico 2

Frenos al uso de herramientas de IA generativa en el trabajo parlamentario

En relación con la falta de formación específica, llama la atención que el 75 % de los parlamentarios/as nunca hayan recibido formación en IA.

Del 25 % que sí la ha recibido en alguna ocasión, un 17 % la buscó por su cuenta, mientras que a un 8 % le fue proporcionada por diversas instituciones; sin embargo, ninguno/a declara haber recibido este tipo de formación ni por parte del Parlamento de Galicia ni de su propia formación política. No es de extrañar, por tanto, que el 92 % de los diputados/as reclame formación en el uso de la inteligencia artificial aplicada a su trabajo: el 50 % considera que debería ser su partido político quien la proporcione, y el 33 % que esta responsabilidad correspondería al Parlamento de Galicia.

Del mismo modo, prácticamente la totalidad (92 %) afirma que ninguna entidad o institución, y en particular la cámara gallega, le facilita acceso a estas herramientas. En cambio, un 67 % desearía que sí fuese así, repartido entre quienes opinan que debería ser el Parlamento quien garantizase el acceso a versiones de pago o profesionales —por ejemplo, de ChatGPT— (33 %) y quienes consideran que esta tarea debería asumirla su partido político (25 %).

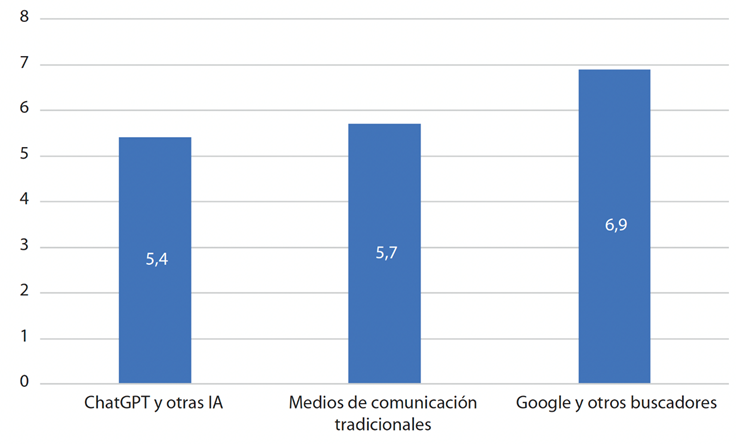

Resulta interesante conocer también la percepción positiva o negativa que los diputados/as tienen de esta tecnología como oportunidad de desarrollar mejor su trabajo parlamentario, valorando este aspecto con una nota media de 6,6 sobre 10, relativamente positiva, por tanto. En cambio, cuando se les pregunta sobre la relación entre IA y desinformación, la mayoría creen que ambos fenómenos están relacionados, otorgándole un peso de 7,8 sobre 10 a esta relación; razón por la que una amplia mayoría de las respuestas (75 %) son favorables a que la Unión Europea y los Estados miembros destinen recursos a desarrollar herramientas propias de IA generativa, al margen de las impulsadas por Estados Unidos y China.

Aun así, los parlamentarios le otorgan una fiabilidad de 5,4 sobre 10 a los resultados de las herramientas de IA que ellos/as emplean, frente al 6,9 de los datos proporcionados cuando realizan búsquedas en Google y al escaso 5,7 de los datos que obtienen a través de los medios de comunicación tradicionales.

Gráfico 3

Percepción de la fiabilidad (sobre 10) de los datos obtenidos por diferentes fuentes para la realización del trabajo parlamentario

Análisis de probabilidad de presencia de texto generado por IA en las iniciativas parlamentarias

Tal y como se indica en el apartado de metodología, se seleccionó una muestra de diversas iniciativas parlamentarias de los diferentes grupos políticos. Muestra que fue sometida a un análisis con ChatGPT y GPTZero, software recomendado por el propio ChatGPT como por diversas publicaciones especializadas (Fernández, 2025), con el fin de detectar las probabilidades de que un texto —o partes del mismo— hayan sido generados mediante inteligencia artificial.

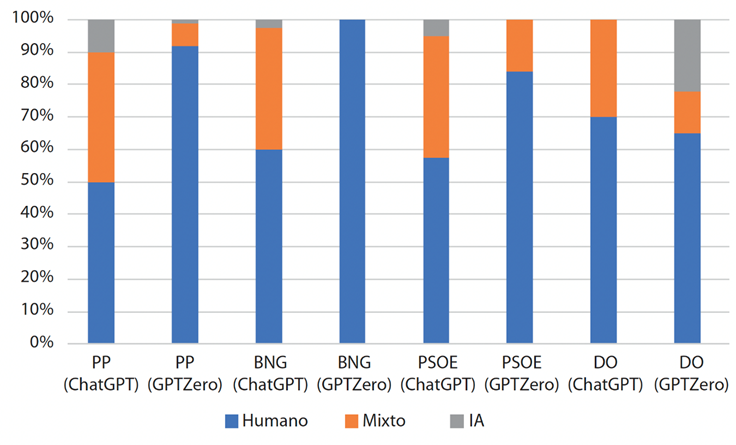

Gráfico 4

Probabilidades de generación de texto por IA en las iniciativas de los grupos parlamentarios, según ChatGPT y GPTZero

Como se puede observar, los resultados que ofrecen ambas herramientas para el análisis de los mismos textos son absolutamente dispares, lo que evidencia las dificultades de detección de texto generado por IA y la escasa fiabilidad de las herramientas disponibles en la actualidad. Resultan llamativos los casos del PP y del BNG, en el primero de ellos GPTZero atribuye un porcentaje de creación humana del 92 % y ChatGPT lo baja al 50 %, calculando un 40 % de probabilidades de generación mixta entre IA y humana; en el segundo, GPTZero proporciona una certeza absoluta (100 %) de generación exclusivamente humana y ChatGPT de solo el 60 %.

El único resultado fiable que puede extraerse de este análisis, es aquel en el que ambas herramientas coinciden, aunque con matices: el bajo porcentaje de probabilidades que atribuyen a todos los partidos de recurrir únicamente a la IA. De este modo, se refuerza la idea de un uso probable de ChatGPT y otras herramientas como apoyo para la búsqueda de materia prima o como base para la elaboración de textos que, a partir de lo generado por la IA, son posteriormente complementados, matizados y enriquecidos por una persona, dotándolos de coherencia y sentido. Esta interpretación, además, se corresponde con los resultados obtenidos en el formulario online remitido a los diputados/as.

Es interesante recoger aquí los aspectos que ChatGPT reconoce analizar para intentar averiguar la presencia de IA en un texto, entre los que destacan: errores y formulaciones retóricas humanas, complejidad técnica y jurídica, estilo político-partidario, especificidad política y territorial, etc.

Conviene destacar, no obstante, la advertencia de GPTZero al escanear los textos analizados de que está todavía perfeccionando su aprendizaje del gallego, por lo que “los resultados pueden ser imperfectos”, no así ChatGPT, que se reconoce ya bastante entrenado y competente en este idioma, aunque afirma que posee algunas limitaciones para captar matices, debido al menor volumen de documentación que posee en gallego frente a otros idiomas.

Presencia de desinformación en los textos analizados

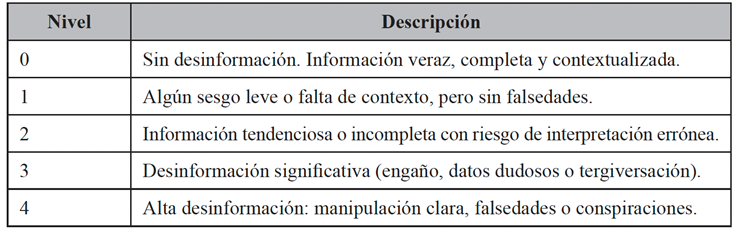

Para calcular la presencia de desinformación en la muestra de iniciativas parlamentarias analizadas, dada la naturaleza de este trabajo y las tendencias actuales en verificación (Cuartielles et al., 2023), se recurrió a un análisis con ChatGPT (versión de pago de la Universidad de Vigo), que trabaja con una escala estimativa de cinco niveles de desinformación.

Tabla 2

Escala estimativa de ChatGPT para calcular el nivel de desinformación

Nota. ChatGPT.La conclusión de ChatGPT es que ninguno de los textos parlamentarios analizados contiene desinformación grave o deliberada (niveles 3 o 4). Todos muestran un sesgo político claro, como es natural en contextos parlamentarios, pero se mantienen dentro de los márgenes de discurso legítimo y verificado.

Este resultado ofrecido por ChatGPT sería coherente con lo señalado en el apartado anterior, puesto que, en la medida en la que no se observa un porcentaje elevado de generación de texto exclusivamente con IA —fuente importante de desinformación, como se ha apuntado en el marco teórico—, cabría esperar que el nivel de esta fuese, en consecuencia, reducido. Es cierto que el ser humano, sin asistencia de la inteligencia artificial, puede ser también generador de desinformación, pero estudios previos sobre la política autonómica gallega revelaban ya escasos niveles de desinformación en el discurso de los principales partidos políticos (Puentes-Rivera y Fontenla-Pedreira, 2024).

Conclusiones y discusión

La hipótesis general de este trabajo plantea que la IA generativa, como ChatGPT o DeepSeek, se ha convertido ya en una herramienta de trabajo habitual en parlamentos y gabinetes de comunicación políticos en todo el mundo. Por extrapolación y por los resultados obtenidos en este trabajo, con las limitaciones propias de su carácter exploratorio y de la representatividad de la muestra obtenida, se entiende que en el Parlamento de Galicia los grupos políticos del Partido Popular (PP), Bloque Nacionalista Galego (BNG), Partido dos Socialistas de Galicia-PSOE (PSdeG-PSOE) y Grupo Mixto (integrado a día de hoy por el único diputado de Democracia Ourensana) utilizan dicha tecnología de forma regular como base para la elaboración de textos (preguntas, intervenciones orales, notas de prensa, etc.) y diversas tareas administrativas.

Aunque todavía no existen estudios específicos sobre Galicia, la tendencia global observada en parlamentos internacionales, la persuasividad demostrada de la IA en debates públicos y la adopción creciente de estas herramientas por parte de los partidos políticos en campañas y gabinetes de comunicación constituyen un marco teórico plausible para trasladar esta hipótesis al caso gallego. La evidencia académica sobre la expansión del uso de ChatGPT, la presencia de sesgos políticos, la persuasión algorítmica y la incorporación institucional de la IA generativa en la comunicación política respaldan de forma robusta la hipótesis de que los parlamentos —incluido el de Galicia— están integrando esta tecnología como una herramienta habitual en su discurso y práctica cotidiana. Esta hipótesis queda, además, confirmada por las respuestas aportadas por los diputados/as sobre el recurso a la IA en su trabajo diario.

Asimismo, la Declaración institucional a favor de un desarrollo ético y centrado en el ser humano en Galicia (Parlamento de Galicia, 2022) y la aprobación por unanimidad de la Ley 2/2025, de 2 de abril, para el desarrollo e impulso de la inteligencia artificial en Galicia evidencian que los grupos parlamentarios (PP, BNG, PSdeG-PSOE y DO) están comprometidos con principios de ética, fiabilidad, responsabilidad y un uso de la IA orientado a la ciudadanía. Este marco, aunque de carácter normativo, sugiere también un entorno consciente de los procesos de automatización, incluso en tareas como la redacción de discursos o la gestión de consultas internas.

Cabe destacar, además, a modo de conclusiones más específicas, que:

ChatGPT es claramente la herramienta de IA más utilizada en el trabajo parlamentario, prácticamente la única, llamando la atención que nadie use DeepSeek de modo regular, lo que demuestra que, al margen de la repercusión mediática de su lanzamiento, es la tecnología norteamericana y no la china la única presente.

La legislación autonómica pionera demuestra que Galicia se posiciona activamente ante la adopción institucional de IA. Aunque es necesario profundizar más en el uso de ChatGPT por parte de los diputados y diputadas, el entorno legal favorece ya una adopción formal y regulada de la misma.

La existencia de trabajos académicos específicos sobre ChatGPT y el discurso político en Galicia, como este que se impulsa desde la Universidade de Vigo, es una confirmación de que el tema ya se estudia en el entorno local, aportando soporte a la hipótesis de un uso investigador y preventivo de la IA.

La universidad semeja también el ámbito adecuado para suplir una carencia y un deseo señalado por la práctica totalidad de los diputados/as del Parlamento de Galicia, recibir formación específica y profesional en el manejo de la IA y su aplicación a la actividad parlamentaria; lo que supone una oportunidad y un reto para la propia institución universitaria.

Al margen del deseo personal de los diputados/as, esa formación de calidad vinculada a la universidad y otras instituciones de referencia es clave también para la calidad democrática, ya que con ello se garantizará que los parlamentarios/as usen la IA de modo profesional en su trabajo, más allá del uso cotidiano que pueda hacer la ciudadanía en general.

La educación y sensibilización ciudadana, impulsadas por la Xunta de Galicia y el Gobierno de España a través de programas como AulaCheck, refuerzan que la sociedad gallega y sus instituciones consideran relevante la alfabetización digital frente a posibles riesgos de IA mal empleada.

La participación de todos los grupos del Parlamento (PP, BNG, PSdeG-PSOE y DO) en la declaración conjunta sobre IA ética de 2022 y el hecho de que ninguno de ellos votase en contra de la Ley para el desarrollo e impulso de la inteligencia artificial en Galicia, sugiere consenso, por lo menos discursivo y ético, entre las diferentes formaciones de la asamblea legislativa gallega sobre la necesidad de supervisión y calidad en el uso de herramientas automatizadas de redacción parlamentaria, generando un contexto favorable para poder dotarse en un futuro de regulación específica sobre el uso de la IA generativa en la comunicación institucional y política de Galicia y sus aplicaciones en el trabajo de los grupos y los diputados/as en el Parlamento gallego.

Todo ello evidencia un estado de opinión en el que la IA genera preocupación y reflexión interna y pública, combinada con la percepción de beneficios evidentes en su aplicación como herramienta de asistencia en el trabajo diario.

Así las cosas, aun sin investigaciones previas publicadas en revistas indexadas, el contexto formal refuerza la hipótesis principal de una adopción institucional consciente del uso de la inteligencia artificial en diferentes tareas relacionadas con la acción política parlamentaria.

En conclusión, tanto las evidencias cualitativas como las cuantitativas refuerzan la hipótesis de que los diputados/as del Parlamento de Galicia, de todos los grupos políticos, están adoptando la IA generativa, como ChatGPT, en su labor diaria, pues los discursos institucionales, la legislación autonómica y las respuestas de los propios diputados/as al cuestionario remitido, reflejan un ecosistema informativo compatible con su uso regulado y reflexionado, dentro de unos estándares éticos compatibles con el pluralismo ideológico y político, recurriendo a estas herramientas simplemente como base inicial para la redacción y elaboración de diferentes documentos, intervenciones y otros materiales, que son perfeccionados y acabados siempre, en todo caso, con intervención humana. No se detecta, por tanto, un uso perverso de la IA, como sería la redacción de textos basados exclusivamente en ella, sino un uso racional e inteligente, concebida como tecnología de apoyo y asistencia al trabajo parlamentario.

De cara a futuras investigaciones, sería recomendable realizar entrevistas semiestructuradas con los diputados/as del Parlamento de Galicia, que vayan más allá del cuestionario online y permitan obtener un conocimiento más detallado de sus motivaciones e intenciones, incorporando al estudio, además, a los/as asistentes parlamentarios y a los gabinetes de comunicación, responsables en muchas ocasiones de redactar los textos, intervenciones, etc. que luego los diputados/as manejan en público.

Podría optarse, igualmente, por realizar un análisis de contenido automatizado de publicaciones en redes sociales de cuentas oficiales o privadas de parlamentarios/as gallegos, para identificar patrones típicos de IA, como coherencia extrema, estilo repetitivo, ausencia de errores tipográficos, etc. ya que su actividad en redes determina una buena parte de su influencia en la opinión pública.

Por último, resultaría recomendable también ampliar la investigación a otros parlamentos autonómicos y a las Cortes Generales, a fin de poder realizar luego un estudio comparado y obtener una radiografía completa del uso y aplicaciones de la IA generativa en el parlamentarismo español; además de manejar muestras más representativas que permitan trascender el carácter exploratorio de este estudio y completar con control humano, de modo cualitativo, el análisis de desinformación y uso de IA, no solo recurriendo a la propia IA para ello, a fin de evitar un círculo en el que sea la propia IA la determina el uso o no de IA.

Apoyos y soporte financiero de la investigación

Entidad: Xunta de Galicia

País: España

Ciudad: Pontevedra

Proyecto subvencionado: No se incluye en versión anonimizada

Código de proyecto: No se incluye en versión anonimizada

Referencias bibliográficas

Aparici, R., García-Marín, D. y Rincón-Manzano, L. 2019. Noticias falsas, bulos y trending topics. Anatomía y estrategias de la desinformación en el conflicto catalán. Profesional De La información, 28(3). https://doi.org/10.3145/epi.2019.may.13

Baum, J. y Villasenor, J. 2023, mayo 8. The politics of AI: ChatGPT and political bias. Brookings. https://bit.ly/4787CcV

Baydemir, R. 2025. Artificial intelligence wars in global technology: ChatGPT vs. DeepSeek. En Proceedings of the 6th International Conference on Innovative Academic Studies (pp. 370-375). https://bit.ly/45iD067

Comisión Europea 2022, junio 16. 2022 Strengthened Code of Practice on Disinformation. Comisión Europea. https://bit.ly/3UBx17h

Congreso de los Estados Unidos 2025. DeepSeek Unmasked: Exposing the CCP´s Latest Tool for Spying, Stealing and Subverting U.S. Export Control Restrictions. Comnittee on The Strategic Competition between the United States and Chinese Communist Party. https://bit.ly/4moP2BY

Conroy, G. y Mallapaty, S. 2025. How China created AI model DeepSeek and shocked the world. Nature, 638, 300. https://doi.org/10.1038/d41586-025-00259-0

Csernatoni, R. 2024, December 18. Can democracy survive the disruptive power of AI? Carnegie Endowment for International Peace. https://bit.ly/4l4qaOu

Cuartielles, R., Ramon-Vegas, X. y Pont-Sorribes, C. 2023. Retraining fact-checkers: The emergence of ChatGPT in information verification. Profesional de la información, 32(5). https://doi.org/10.3145/epi.2023.sep.15

Davis, N. 2025, mayo 19. AI can be more persuasive than humans in debates, scientists find. The Guardian. https://bit.ly/4mnSU68

De Alba Bastarrechea, E. 2025. La inteligencia artificial en la transformación digital de los parlamentos: en busca de un modelo ad hoc de gobernanza. Asamblea. Revista Parlamentaria De La Asamblea De Madrid, 48, 161-193. https://doi.org/10.59991/rvam/2025/n.48/1025

Deepes. 2025, junio 26. DeepSeek AI enfrenta bloqueos internacionales: lista de países y motivos. Deepes. https://bit.ly/4medBRO

Diario Oficial de la Unión Europea. 2024. Reglamento (UE) 2024/1689 del Parlamento Europeo y del Consejo, de 13 de junio de 2024, por el que se establecen normas armonizadas en materia de inteligencia artificial y por el que se modifican los Reglamentos (CE) n.° 300/2008, (UE) n.° 167/2013, (UE) n.° 168/2013, (UE) 2018/858, (UE) 2018/1139 y (UE) 2019/2144 y las Directivas 2014/90/UE, (UE) 2016/797 y (UE) 2020/1828 (Reglamento de Inteligencia Artificial) (Texto pertinente a efectos del EEE). Diario Oficial de la Unión Europea, 13 de junio de 2024. https://bit.ly/3H022Pl

Diez‑Gracia, A., Sánchez‑García, P. y Martín‑Román, J. 2023. Disintermediation and disinformation as a political strategy: use of AI to analyse fake news as Trump’s rhetorical resource on Twitter. Profesional de la Información, 32(5). https://doi.org/10.3145/epi.2023.sep.23

DOG: Diario Oficial de Galicia. 2025. Ley 2/2025, de 2 de abril, para el desarrollo e impulso de la inteligencia artificial en Galicia. DOG, 66, 4 de abril, 20464. https://bit.ly/40J7ZH2

Evkoski, B. y Pollak, S. 2023, mayo 8. XAI in computational linguistics: Understanding political leanings in the Slovenian Parliament. arXiv. https://bit.ly/46AWsNE

Fernández, F. 2025, mayo 8. Detector de ChatGPT: 9 servicios y apps para saber si un texto ha sido generado por la IA de OpenAI. Xataca. https://bit.ly/4l1tBp9

Foos, F. 2024. The Use of AI by Election Campaigns. LSE Public Policy Review, 3(3), 8. https://doi.org/10.31389/lseppr.112

Garriga, S., Beauvais, M. y Queralt Jiménez, I. 2024. Unmasking AI’s role in the age of disinformation: Friend or foe? Media and Communications, 6(1), 19. https://bit.ly/40FihIb

IPU: Inter-Parliamentary Union. 2024, mayo 31. Updates on AI from the parliamentary community. IPU: Inter-Parliamentary Unionhttps://bit.ly/3U5973W

Kreps, S. y Kriner, D. 2024. How AI Threatens Democracy. Journal of Democracy, 34(4), 122-131. https://bit.ly/3HaXmpO

López‑Borrull, A. y Lopezosa, C. 2025. Mapping the impact of generative AI on disinformation: Insights from a scoping review. Publications, 13(3), 33. https://doi.org/10.3390/publications13030033

Marino, G. y Giglietto, F. 2024. Integrating large language models in political discourse studies on social media. Sociologica, 18(2). https://bit.ly/4mnOtrT

Mok, C. 2025, febrero 5. Taking stock of the DeepSeek shock. Stanford FSI Cyber Policy Center. https://bit.ly/3IS6wrS

Morais, R. y Piñeiro-Naval, V. 2025. Presencia de los aspectos regionales y locales sobre desinformación en la producción científica en España y Portugal: revisión del estado de la cuestión. Doxa Comunicación, 41, 341-368. https://doi.org/10.31921/doxacom.n41a2905

Motoki, F., Pinho Neto, V. y Rangel, V. 2025. Assessing political bias and value misalignment in generative artificial intelligence. Journal of Economic Behavior & Organization, 234. https://doi.org/10.1016/j.jebo.2025.106904

Olmos Alcaraz, A. 2023. Desinformación, posverdad, polarización y racismo en Twitter: análisis del discurso de Vox sobre las migraciones durante la campaña electoral andaluza (2022). Methaodos. Revista de Ciencias Sociales, 11(1), m231101a09. https://doi.org/10.17502/mrcs.v11i1.676

Parlamento de Galicia. 2022, junio 15. Declaración institucional do Parlamento de Galicia en favor dunha intelixencia artificial ética e centrada no ser humano en Galicia. Parlamento de Galicia. https://bit.ly/3H42n3y

Puentes-Rivera, I., Fontenla-Pedreira, J. y Rúas-Araújo, J. 2024. Desinformación y compromiso digital en la comunicación desarrollada durante los comicios al Parlamento de Galicia 2024. ICOMTA’24 – IV Conferencia Internacional de Comunicación y Tecnologías Aplicadas. Lima (Perú): Universidad Peruana de Ciencias Aplicadas.

Raman, R. et al. 2024. Fake news research trends, linkages to generative artificial intelligence and sustainable development goals. Heliyon, 10(3). https://doi.org/10.1016/j.heliyon.2024.e24727

Rivas-de-Roca, R., Morais, R. y Jerónimo, P. 2022. Comunicación y desinformación en elecciones: tendencias de investigación en España y Portugal. Universitas-XXI, 36, 71-94. https://doi.org/10.17163/uni.n36.2022.03

RTVE. 2023, marzo 31. Podemos apoyarnos en la inteligencia artificial para tomar decisiones políticas. RTVE.es. https://bit.ly/4lUlTi9

Rúas-Araújo, J. y Paniagua-Rojano, F.J. 2023. Aproximación al mapa sobre la investigación en desinformación y verificación en España: Estado de la cuestión. ICONO 14. Revista Científica De Comunicación Y Tecnologías Emergentes, 21(1). https://doi.org/10.7195/ri14.v21i1.1987

Simon, F. M., Altay, S., y Mercier, H. 2023, octubre 18. Misinformation reloaded? Fears about the impact of generative AI on misinformation are overblown. Misinformation Review. https://bit.ly/45ci1BY

Teruel Rodríguez, L. y García Faroldi, L. 2022. Los medios de comunicación ante la desinformación: inteligencia artificial, discursos de odio, teorías de la conspiración y verificación. Universidad de Málaga. https://bit.ly/46SNMm7

Troboukis, T., Kiki, K., Galanopoulos, A., Sermpezis, P. Karamanidis, S., Dimitriadis, I. y Vakali, A. 2024, octubre 17. Towards Hybrid Intelligence in journalism: findings and lessons learnt from a collaborative analysis of greek political rhetoric by ChatGPT and Humans. arXiv. https://doi.org/10.48550/arXiv.2410.13400

Vázquez-Gestal, M. Fernández-Souto, A.B. y Puentes-Rivera, I. 2024. La desinformación y la transparencia de las instituciones públicas españolas a través de las estructuras de sus gabinetes de comunicación. Revista Española de la Transparencia, 20, 157-181. https://doi.org/10.51915/ret.360

Xunta de Galicia. 2024. Combate la desinformación con AulaCheck.. EspazoABALAR. https://bit.ly/41eJEZF

Xunta de Galicia. 2024, 2 de diciembre. Rueda anuncia que Galicia se convierte en la primera región europea que regula por ley el uso de la inteligencia artificial. Xunta de Galicia. https://bit.ly/45rAZFM

Xunta de Galicia. 2024, December 2. Galicia se convierte en la primera región europea que regula por ley el uso de la inteligencia artificial. https://bit.ly/4mF5k9Z

Yip, K. y Balagué, C. 2023. ChatGPT research: Evidence-based controversies, regulations, and solutions. SciencesPo. https://bit.ly/4fd2Htc

Información adicional

redalyc-journal-id: 4761

Enlace alternativo

https://revistas.ups.edu.ec/index.php/universitas/article/view/11244 (html)