Avaliação educacional: fundamentos e políticas da educação básica e superior

Avaliação educacional no Brasil para além dos testes cognitivos1

Educational evaluation in Brazil beyond cognitive tests

Avaliação educacional no Brasil para além dos testes cognitivos1

Revista de Educação PUC-Campinas, vol. 23, núm. 1, 2018

Programa de Pós-Graduação em Educação da Pontifícia Universidade Católica de Campinas

Recepção: 18 Julho 2017

Revised document received: 25 Setembro 2017

Aprovação: 15 Outubro 2017

Resumo: O texto, com base em revisão da bibliografia, analisa o movimento da avaliação educacional no Brasil e discute uma proposta de incluir no processo avaliativo outros aspectos que não somente os resultados dos testes. Inicialmente, destaca o movimento das políticas educacionais brasileiras em direção aos testes cognitivos, principal instrumento das avaliações educacionais produzidas pelos diferentes níveis de governo. Aborda os principais movimentos que permitiram o desenvolvimento da avaliação, tanto aqueles relativos à construção de seus instrumentos, como a discussão da legislação educacional. Também destaca os princípios basilares do Sistema de Avaliação da Educação Básica, e como esse instrumento foi-se modificando ao longo do tempo para permitir a criação de um indicador educacional como o Índice de Desenvolvimento da Educação Básica, e para a definição de metas por escolas. Por fim apresenta a proposta do Sistema Nacional de Avaliação da Educação Básica, proposto pelo Plano Nacional de Educação, que amplia a avaliação para outras dimensões, que não apenas os resultados nos testes, e cria um comitê de governança, trazendo outros atores, além do governo federal, para a discussão sobre os seus instrumentos e os usos de seus resultados.

Palavras-chave: Avaliação educacional, Ideb, Saeb, Sinaeb.

Abstract: Based on a bibliographic review, the text analyzes the movement of educational evaluation in Brazil and discusses a proposal to include aspects other than test results in the evaluation process. Initially, the text highlights the movement of Brazilian educational policies towards cognitive tests, the main instrument of educational evaluations produced by different governmental levels. It addresses the main movements that allowed the development of evaluations, including those related to the construction of instruments and the discussion of the educational legislation. It also highlights the basic principles of the Basic Education Assessment System (Sistema de Avaliação da Educação Básica), and how this instrument was modified both to allow the creation of an educational indicator such as the Index of Basic Education Development (Índice de Desenvolvimento da Educação Básica), and for the definition of goals by federal schools. Finally, it presents the proposal of the National System of Evaluation of Basic Education, (Sistema Nacional de Avaliação da Educação Básica), proposed by the National Education Plan (Plano Nacional de Educação), that extends evaluation to other dimensions beyond the results in the tests, and creates a governance committee, bringing other actors, in addition to the federal government, to discuss their instruments and the uses of their results.

Keywords: Educational evaluation, Ideb, Saeb, Sinaeb.

Introdução

Não é possível analisar o crescimento da avaliação educacional no Brasil sem levar em consideração a ampliação da expertise no desenvolvimento de testes cognitivos, levado a efeito entre os anos 1960 e 1980. Nos anos 1960 surgem os grandes concursos vestibulares para acesso aos principais cursos de educação superior. No estado de São Paulo criam-se o Centro de Seleção de Candidatos às Escolas Médicas e Biológicas (Cescem), o Centro de Seleção de Candidatos às Escolas de Economia e Administração e o Mapofei3, que agregava os cursos de engenharia e demais áreas de exatas. À exceção do último, em que os testes eram construídos com itens abertos, os dois primeiros usavam itens de múltipla escolha. O Cescem era organizado pela Fundação Carlos Chagas que viria a ter um papel importante no Sistema de Avaliação da Educação Básica, e que, dentre seus colaboradores, contava com Heraldo Marelin Vianna, considerado o pai dos testes cognitivos no Brasil, e Bernadete Gatti.

No Rio de Janeiro, no início dos anos 1970, criou-se o Centro de Seleção de Candidatos do Grande Rio (Cesgranrio), que também acabou unificando os diversos vestibulares naquele Estado. Nesse ano, inclusive, todos os jornais do País trouxeram uma imagem emblemática da unificação dos vestibulares no Rio: os candidatos fazendo os testes no estádio do Maracanã. Assim como a Fundação Carlos Chagas, o Cesgranrio também teve papel de destaque no desenvolvimento dos testes cognitivos.

Esses grandes vestibulares unificados alteraram a lógica anterior dos vestibulares, que exigiam uma nota mínima para o ingresso na faculdade, criando o que ficou conhecido como candidatos excedentes – aqueles que, apesar de terem atingido a nota mínima, não conseguiam matrícula, pois os aprovados excediam o número de vagas. A nova lógica era a da seleção de candidatos até o limite do número de vagas. O sucesso desse modelo e a utilização dos testes objetivos fizeram com que os itens de múltipla escolha passassem a ganhar destaque nos livros didáticos e começassem a ser amplamente utilizados pelos educadores (Gatti, 2002).

Para elaborar instrumentos cada vez mais sofisticados e confiáveis, capazes de dar conta do desafio de selecionar, entre milhares de candidatos, aqueles mais bem preparados para enfrentar a educação superior, foi necessário o desenvolvimento de equipes, com o objetivo de criar instrumentos de medida mais sofisticados e aprimorar a elaboração dos testes.

Além dos grandes vestibulares, Gatti (2009) destaca, também, duas outras iniciativas como importantes para o desenvolvimento dessa expertise: a criação, em 1966, do Centro de Estudos de Testes e Pesquisas Psicológicas, ligado à Fundação Getúlio Vargas do Rio de Janeiro, que chegou a montar testes para as últimas séries do Ensino Médio nas áreas de Língua Portuguesa, Matemática, Ciências da Natureza e Ciências Humanas; e os estudos desenvolvidos, a partir de 1974, por iniciativa do Programa de Estudos Conjuntos de Integração Econômica Latino-Americana, para testar o desempenho dos alunos das primeiras séries do Ensino Fundamental, abrangendo Língua Portuguesa (leitura e escrita) e Matemática.

Outra experiência importante ocorreu em 1980, na cidade de São Paulo, onde se desenvolveu uma pesquisa com o objetivo de verificar o desempenho dos alunos no que era conhecido como 1ª, 3ª, 5ª e 7ª séries do Ensino Fundamental e na 1ª série do Ensino Médio, envolvendo as áreas de Língua Portuguesa, Matemática e Ciências. O objetivo era utilizar os resultados no planejamento das atividades escolares e extraescolares (Gatti, 2002).

Outra ação importante foi o desenvolvimento do Programa de Educação Básica para o Nordeste Brasileiro (Edurural), implantando em 1980, com financiamento do Ministério da Educação (MEC) e do Banco Mundial. Esse programa tinha como objetivos expandir o acesso às quatro primeiras séries do ensino, diminuir as taxas de repetência e evasão e melhorar o rendimento escolar dos alunos. Para acompanhar a evolução do último objetivo, foram realizados três estudos em 1981, 1983 e 1985, em sessenta municípios de três estados, envolvendo seiscentas escolas e seis mil alunos, para medir o desempenho escolar das então 2ª e 4ª séries da escola primária em Português (leitura e interpretação, escrita e gramática) e Matemática, a cargo da equipe da Fundação Carlos Chagas, liderada pelo professor Heraldo Vianna e da qual fazia parte, entre outros pesquisadores, a professora Bernadete Gatti. Testava-se para acompanhar os resultados do programa que estava sendo implementado, utilizando-se os grupos que dele faziam parte e outros de controle, não havendo interesse em comparar e classificar as escolas.

Com a experiência adquirida no Edurural e na realização dos grandes vestibulares, a professora Bernadete (Gatti, 2013) lembra que ela e o professor Heraldo Vianna foram convidados, no começo de 1987, para discutir com Aloísio Sotero, então ministro da Educação durante o governo do general João Figueiredo, a possibilidade de realizar um diagnóstico sobre como estava a educação, de forma a se terem elementos para influir nos processos desenvolvidos por estados e municípios. Mesmo depois da indicação do novo titular da pasta, esses estudos preliminares tiveram prosseguimento e deram origem a três pesquisas realizadas em 1988: uma, envolvendo 4.518 crianças em dez cidades (Vianna; Gatti, 1988); outra, nesse mesmo ano, que testou 8.069 alunos em vinte cidades (Vianna, 1989); e uma terceira, com 14.868 crianças em 39 cidades (Vianna, 1990).

Em 1988, a Fundação Carlos Chagas firmou um contrato com o governo do estado do Paraná para a realização de uma pesquisa em sua rede de ensino, tendo como base o trabalho anteriormente desenvolvido para o Instituto Nacional de Estudos e Pesquisas Educacionais Anísio Teixeira (Inep). Segundo Vianna (1990, 2005), a pesquisa foi realizada em duas etapas, sendo avaliados quase trinta mil alunos em 29 cidades do estado.

Essas iniciativas foram decisivas para que se criassem as bases do conhecimento para a construção dos testes cognitivos que fariam parte das avaliações nacionais.

O desenho do SAEB e a realização dos dois primeiros ciclos de aplicação

Em meio ao processo de redemocratização do País, capitaneado pelos trabalhos da Assembleia Constituinte, e em um contexto de reformas políticas, sociais e econômicas, de reconfiguração do pacto federativo, com maior autonomia para estados e a entrada em cena dos municípios como entes da federação, incorporam-se novos atores e novas demandas sociais. Nesse cenário, com a experiência adquirida nos anos anteriores no desenvolvimento de testes cognitivos, agregando algumas pesquisas que estavam sendo realizadas pelo Instituto de Pesquisa Econômica Aplicada, surge a oportunidade de se instituir um sistema de avaliação para acompanhar a evolução das políticas educacionais.

Jacobo Waiselfisz, em entrevista, descreve como se iniciaram essas tratativas, de início para apresentar, à equipe que negociava o desenho do Projeto Nordeste, um programa do MEC financiado com recursos do Banco Mundial, uma avaliação que pudesse aquilatar os avanços do Projeto e de seu desejo de ampliar essa iniciativa para abranger diversas dimensões do processo educacional assim como todos os estados brasileiros (Waiselfisz; Horta Neto, 2016). Na época, Jacobo trabalhava no MEC em programas de educação rural, em um convênio que o Instituto Interamericano de Cooperação para a Agricultura tinha com o Ministério. O entrevistado descreve como, dada a falta de interesse da equipe do Banco em financiar uma avaliação mais ampla, conseguiu convencer a equipe do MEC a colocar em prática suas ideias de uma avaliação nacional. Muito ajudou nesse processo o fato de ele ter conseguido acesso a uma linha de financiamento de US$900 mil a fundo perdido, que poderia ser canalizado para financiar o Ministério nessa ação.

Convencido o Ministério e com recursos disponíveis, Jacobo buscou diversas pesquisas e estudos em andamento que pudessem ser utilizados para formar o desenho da avaliação nacional. Esse desenho está esquematizado no Quadro 1, que apresenta as dimensões da avaliação e os indicadores a partir dos quais se procuraria fazer os julgamentos de valor da realidade que seria medida e que fizeram parte da proposta inicial do Sistema de Avaliação da Educação Básica (SAEB).

É interessante notar que a palavra “sistema” está presente no SAEB não por um mero acaso, mas porque utiliza uma série de instrumentos que, integrados, referem-se a algumas das dimensões que tomam parte do processo educacional, na forma de um sistema. Além disso, analisando-se o Quadro 1, observa-se que o rendimento do aluno, que seria medido com os instrumentos desenvolvidos naquela época pela equipe da Fundação Carlos Chagas liderada por Heraldo Vianna, era apenas um dos elementos dessa avaliação. O rendimento do aluno fazia parte do eixo ‘Universalização com qualidade’, dentro da dimensão da ‘qualidade’ que envolvia além do indicador de rendimento do aluno, os indicadores de competência do professor, do custo-aluno direto e das condições do ensino. Também é possível observar que existiam outros dois eixos relacionados a outras dimensões, ‘Valorização do professor’ e ‘Gestão educacional’, que davam origem a outros indicadores. No total, o desenho original previu 23 indicadores, de forma a abarcar, a partir dos instrumentos existentes e das preocupações políticas da época, a multidimensionalidade do processo educacional.

| Eixo | Dimensão | Indicador |

|---|---|---|

| Universalização com qualidade | Escolarização | Matrícula Taxade escolarização real |

| Retenção | Taxas de evasão, aprovação e repetência | |

| Produtividade | Taxa de sobrevivência | |

| Qualidade | Rendimento do alunoCompetência do professorCusto-aluno diretoCondições do ensino | |

| Valorização do professor | Competência | Conteúdos e projeto pedagógico |

| Condições de trabalho | Níveis salariaisTaxas de professores concursadosVigência de Estatuto do Magistério | |

| Gestão educacional | Integração estado/município | Diagnóstico de gestãoEqualização custo-aluno |

| Descentralização | Diagnóstico de gestãoGrau de autonomia da escolaMelhoria da gestão escolar | |

| Desburocratização | Diagnóstico de gestãoRelação custo docente/não docente | |

| Eficiência | Diagnóstico de gestãoRacionalização de recursos | |

| Democratização | Diagnóstico de gestãoMelhoria da gestão escolar |

O foco, portanto, era bastante amplo, e a proposta bastante ambiciosa.

Para se aquilatar o tamanho do desafio colocado pela proposta, é preciso ter em conta que, no final dos anos 1980, a Internet ainda estava engatinhando no Brasil, que o país vivia as restrições da reserva de mercado de informática com a proibição da importação de computadores pessoais, que os recursos computacionais do Ministério e das Secretarias Estaduais de Educação eram praticamente inexistentes e que os dados estatísticos anuais da Educação Básica só eram concluídos alguns anos após terem sido coletados.

Em setembro de 1988, aconteceu a aplicação piloto nos estados do Paraná e Rio Grande do Norte. Como a equipe do MEC que estava à frente do SAEB tinha apenas quatro pessoas, era fundamental contar com as equipes estaduais. Além disso, segundo narra Jacobo em sua entrevista (Waiselfisz; Horta Neto, 2016), um dos pressupostos da avaliação era a descentralização das ações.

A primeira aplicação aconteceu no final de 1990. Para prepará-la, foi organizado um encontro, com duração de duas semanas, com a participação de dois servidores de cada uma das secretarias estaduais de Educação, para capacitar e discutir os instrumentos e chegar à sua versão final antes da aplicação. Jacobo, em sua entrevista, afirma que, para garantir a perenidade do sistema, foram produzidos manuais dos instrumentos, dos procedimentos e das técnicas de aplicação. Ao mesmo tempo constituíram-se equipes em cada estado, compostas de coordenador, aplicadores treinados localmente pelos dois servidores que participaram do encontro nacional e equipe de processamento de dados. Dessa primeira aplicação, só não participaram Piauí e Mato Grosso do Sul, por causa de greve dos professores, mas os dois estados fizeram a aplicação por conta própria no ano seguinte.

O Sistema de Avaliação de Educação Básica estava planejado para acontecer a cada dois anos, mas por falta de recursos não foi aplicado em 1992. A segunda aplicação aconteceu em 1993, financiada pelos próprios estados, pois o MEC não dispunha de orçamento para tal.

A instituição formal do SAEB foi fixada pela Portaria MEC nº 1.795, de 27 de dezembro de 1994 (Brasil, 1994). Determinava-se que o SAEB seria dirigido por um conselho, que deveria ter como principal competência elaborar o Plano Nacional de Avaliação da Educação Básica, definindo as diretrizes, normas básicas e objetivos específicos dos ciclos de avaliação, seus padrões de desempenho e qualidade, e os cronogramas e orçamentos de execução. Sua composição envolvia a Secretaria de Educação Fundamental do MEC, cujo titular seria seu presidente; o Inep; a Secretaria de Educação Média e Tecnológica; o presidente do Conselho Nacional de Secretários de Educação – Conselho Nacional de Secretários de Educação; o presidente da União dos Dirigentes Municipais de Educação – Undime; um representante dos secretários de educação dos municípios das capitais; e o presidente do Conselho de Reitores das Universidades Brasileiras. Havia também a determinação de se criar um Comitê Técnico-Científico composto por especialistas em planejamento e avaliação educacional, para assessorar no aprimoramento dos instrumentos. Portanto, a Portaria, editada nos últimos dias do governo Itamar Franco, garantia o caráter descentralizado e participativo que norteou o desenho inicial do SAEB.

Uma breve discussão sobre o surgimento da avaliação educacional na legislação

Quase ao mesmo tempo em que se implantava o SAEB, discutia-se a Lei de Diretrizes e Bases (LDB) da Educação, cujo tema foi tratado em dois distintos Projetos de Lei que se contrapunham.

O primeiro Projeto de Lei (nº 1.258) foi encaminhado à Câmara pelo deputado Otávio Elísio, do PSDB-MG, em 29 de novembro de 1988, pouco mais de dois meses depois da promulgação da nova Carta. Na justificativa do Projeto (Brasil, 1988), o deputado afirmava que a proposta estava fundamentada no estudo elaborado pela Associação Nacional de Pós-Graduação e Pesquisa, apresentado durante a XI Reunião Anual. No projeto, dividido em dez títulos e 83 artigos, não era feita nenhuma menção ao tema da avaliação.

O Projeto de Lei 1.258 foi alvo de intensa disputa e negociação, pois, além de modificações na forma como a educação escolar estava estruturada, criava um Sistema Nacional de Educação, responsável pela articulação das redes federal, estadual, municipal e particular, e transformava o Conselho Federal de Educação em órgão normativo, de nível nacional, em que um terço de seus membros seria indicado pelas entidades representativas do magistério. O fato é que, depois de muitas emendas, um terceiro substitutivo, com vinte capítulos e 152 artigos, relatado pela deputada Ângela Amin, do PPR-SC, foi aprovado em 13 de maio de 1993, quase cinco anos depois do começo de sua tramitação.

No projeto aprovado na Câmara, o tema avaliação foi destacado em oito artigos. Um deles, o artigo 9º, inciso X, determina que um dos princípios orientadores da organização da educação nacional é a “valorização do processo de avaliação institucional” (Brasil, 1993, p.7). O artigo 21, inciso III, determina que as instituições de educação básica devem observar como diretriz a avaliação de desempenho institucional. Portanto, a ênfase dada pelo projeto de lei não era nos testes avaliativos externos, mas sim em processos internos que contem com a participação da comunidade escolar, delegando ao Conselho Federal de Educação a definição das diretrizes para a avaliação das instituições de ensino.

Em paralelo, o senador Darcy Ribeiro, do PDT-RJ, apresentou, em concorrida sessão do Senado Federal, do dia 21 de maio de 1992, outro projeto de lei para a LDB. Tratava-se do Projeto de Lei 67, com dez títulos e 109 artigos. Em sua justificativa, destacou como maiores preocupações o ensino fundamental e a meta de escolarização em tempo integral (Brasil, 1992). O projeto original dedicava cinco artigos à avaliação. Um deles, o artigo 23, tratava da avaliação dos alunos na educação infantil, determinando que essa fosse feita mediante acompanhamento e registro do desenvolvimento da criança, e proibindo a utilização de provas, exames, graus e menções. No título que destacava a qualidade do ensino, em seu artigo 63, § 1º, alínea b, determinava que os sistemas de ensino estabelecessem a função de supervisão dessa qualidade, mediante a avaliação educacional.

Nesse ponto, os dois projetos – o da Câmara, que estava prestes a ser aprovado, e o do Senado – apresentam proposições diferentes para a avaliação das instituições escolares: no primeiro caso, centrado em um processo interno, com as diretrizes fixadas pelo Conselho Federal de Educação; e, no segundo, com características de supervisão em relação à qualidade do ensino ofertado.

Mas o grande divisor entre as duas propostas, em matéria de avaliação, aparece no artigo 64, que determinava que a União, em colaboração com os sistemas de ensino, deveria manter um processo nacional de avaliação do rendimento escolar em âmbito nacional. O § 1º desse artigo ressaltava que essa avaliação deve orientar a política educacional, e o § 2º determinava que a assistência financeira da União aos sistemas de ensino ficava condicionada à sua ativa colaboração na implantação e no desenvolvimento da avaliação. Dessa forma, sem que houvesse obrigatoriedade formal, o dispositivo praticamente obrigaria os outros entes da Federação a participarem do processo, já que a assistência financeira da União sempre foi significativa para grande parte dos sistemas de ensino.

Durante os debates que antecederam à leitura do projeto no plenário do Senado, o senador Darcy Ribeiro fez longo discurso. Uma parte dele tratou das razões que o levaram a incluir a avaliação externa em seu projeto. Segundo o autor, a avaliação externa seria

[...] indispensável a qualquer sistema de ensino.

Nesse momento, o Presidente dos Estados Unidos determinou a aplicação, em todo o sistema escolar de primeiro e segundo graus dos Estados Unidos, de uma prova de estado. Isso parece uma violência, sobretudo num País federativo em que os Estados são tão ciosos de sua independência, mas o Presidente George Bush considerou indispensável aplicar essa medida violenta como única forma de poder competir com o adiantamento muito maior do ensino no Japão e na Alemanha. Se isso é problema para os Estados Unidos, para poderem exercer-se plenamente na futura civilização, para nós o é em escala muitíssimo maior e muitíssimo mais grave

(Brasil, 1992, p.3705).O fato é indicativo de que um intelectual com larga tradição no pensamento de esquerda acabou se seduzindo por argumentos como o de que a avaliação seria o remédio para reverter a queda de desempenho dos alunos americanos frente aos de outros países e que, em nosso caso, conseguiria reverter os baixos indicadores educacionais. O trecho revela a confiança na velha crença de que existiriam soluções simples capazes de resolver problemas complexos.

Eis a contradição: o homem de esquerda que consegue claramente identificar os problemas da escola, relacionando as dificuldades de aprendizagem com a pobreza da população, é o mesmo que usa uma das principais bandeiras do neoliberalismo para controlar uma pretensa qualidade da escola que se almeja, ainda que com o argumento de orientar a política educacional. Os testes cognitivos, gradativamente, com o passar dos anos, e com a sucessão de partidos no governo federal, transformar-se-ão em um fetiche que acabará seduzindo as diversas administrações federais desde 1988, com diferentes perfis ideológicos.

Voltando à tramitação dos dois projetos, acabou prevalecendo aquele liderado por Darcy Ribeiro, com algumas adequações, entre elas a eliminação da determinação de que estados, DF e municípios que não colaborassem com a avaliação externa ficariam sem acesso à assistência financeira da União, uma obrigação disfarçada. O Projeto foi votado no Senado em fevereiro de 1996 e, em dezembro do mesmo ano, foi aprovado na Câmara.

O SAEB a partir de 1995

Em 1995, com a posse do presidente Fernando Henrique, novos estudos foram encomendados (Korte; Nash, 1995). Esses estudos foram a base para o aprimoramento dos instrumentos utilizados até então, inclusive com a criação de Matrizes de Referência e um novo desenho para o SAEB, do qual faziam parte os testes cognitivos e os questionários aplicados a alunos, professores e diretores de escola, com o objetivo de contextualizar o desempenho dos estudantes nos testes. Dessa forma, a avaliação da educação brasileira ficou reduzida a essas duas dimensões, apequenando-se quando comparada com o projeto original.

A partir do ciclo de 2005, a aplicação dos testes passou a ser censitária para os 5º e 9º anos do Ensino Fundamental das escolas públicas. Isso permitiu a divulgação dos resultados por escola, permitindo a incorporação da noção de accountability nas políticas educacionais brasileiras por meio de um indicador nomeado de Índice de Desenvolvimento da Educação Básica (IDEB). O IDEB, índice sintético que varia de zero a dez, é composto pelo produto de dois fatores: fluxo escolar, calculado com dados do Censo Escolar Nacional; e média padronizada das proficiências dos testes de Leitura e Matemática que fazem parte do SAEB (Fernandes, 2017). Essa noção de accountability, desenvolvida dentro de uma ótica neoliberal, acabaria também sendo adotada por um governo considerado de esquerda, como foi o governo Lula. Tudo indica que esse conceito, que atraiu Darcy e o governo do presidente Lula, parece ter o fetiche da bala de prata, aquele tiro certeiro que eliminará todos os problemas da educação.

A mais recente mudança no SAEB é a universalização da sua aplicação para a 3ª série do ensino médio a partir do ciclo de 2017, nesse caso englobando também as escolas particulares, por adesão. Com a centralidade que passou a ter o teste cognitivo após 1995, é importante analisar as variações que eles sofreram ao longo do tempo. Para isso, será feita uma comparação entre os diversos instrumentos que foram utilizados no período, a partir do Quadro 2.

| Atributos | 1995 | 2013 |

|---|---|---|

| Número de itens dos 5° e 9° anos do Ensino Fundamental (4a e 8a série) e da 3a série do Ensino Médio, para as duas áreas do conhecimento | 898 | 144 |

| Número de itens respondidos pelos alunos do 5° ano (4a série) do Ensino Fundamental | 30 | 44 |

| Número de itens respondidos pelos alunos do 9° ano (8a série) do Ensino Fundamental e da 3a série do Ensino Médio | 39 | 52 |

| Teste respondido pelo aluno | Língua Portuguesa ou Matemática | Língua Portuguesa e Matemática |

Pelos dados apresentados, percebe-se que a quantidade de itens testados caiu, para os anos escolares testados, cinco vezes, entre 1995 e 2013. Com isso, diminuiu-se a quantidade de descritores de habilidades testados assim como a quantidade de itens por descritor. Dessa forma, diminuiu-se a abrangência do teste, que acabou se concentrando em apenas algumas habilidades e com poucas opções para testá-las em diferentes aspectos. Com essa mudança simplificou-se o trabalho de elaboração de itens, já que uma quantidade menor deles era necessária a cada ciclo, mas o teste apequenou-se.

Outros dois aspectos são importantes. O primeiro é que aumentou em torno de 40% o número de itens que cada aluno passou a responder. O outro tem a ver com o fato de que em 1995 o teste a que cada aluno era submetido era ou de Matemática ou de Leitura, ao passo que agora o mesmo aluno responde a um teste com itens de Matemática e Leitura. Com isso, apesar de não existirem estudos sobre o tema, deve ter aumentado a pressão sobre os alunos, que não só estão respondendo a mais itens, mas também são avaliados em duas áreas de conhecimento. Essas duas mudanças foram implementadas principalmente para garantir que fosse possível fornecer o resultado por escola, desde que houvesse pelo menos vinte alunos matriculados no ano escolar avaliado. Ou seja, priorizou-se a possibilidade de ter um resultado por escola, mesmo com a diminuição da abrangência e com o aumento da pressão sobre os alunos.

Com os resultados sendo divulgados por escola, foi possível trabalhar na elaboração de um indicador educacional por escola, o IDEB.

O Índice de Desenvolvimento da Educação Básica

Um aspecto pouco explorado pelos governos e pela imprensa tem relação com as limitações tanto técnicas como políticas do IDEB. Exatamente por ter limitações, utilizá-lo como um indicador da qualidade da educação é algo que deve ser feito de forma criteriosa, e não indiscriminadamente, como vem acontecendo.

Com relação às limitações técnicas, elas dizem respeito a várias questões: os desempenhos nos testes de Leitura são numericamente superiores aos de Matemática (Soares, 2012), fazendo com que a média dos rendimentos das duas área, utilizada no cálculo do indicador, reflita mais o resultado de Matemática; a média de desempenho utilizada engloba situações muito díspares, com grupos de alunos com desempenhos muito altos e outro grupo com desempenhos muito baixos (Soares, 2009); a quantidade de ausências no dia da aplicação dos testes ocasiona que a proficiência medida padeça de alguma imprecisão; como o nível socioeconômico dos alunos tem um efeito muito forte sobre seu desempenho nos testes, a comparação entre os indicadores de escolas com alunos de diferentes níveis socioeconômicos apresenta distorções (Duarte, 2012).

Outra limitação, esta de ordem política, tem relação com o fato de o IDEB não contribuir para o fortalecimento de um necessário pacto federativo, em matéria educacional, que envolva os três entes da Federação. Isso porque as metas definidas para cada escola o foram de forma unilateral pelo Governo Federal, sem que houvesse negociação com as redes de ensino. Dessa forma, o Governo Federal dialoga diretamente com as escolas sem a intermediação dos governos subnacionais, que constitucionalmente são os responsáveis pela oferta da educação básica. E isso interfere no pacto federativo, na medida em que é através do relacionamento horizontal entre os três entes da Federação que se preserva a autonomia e a responsabilidade de cada um. Com isso, não se respeitam o planejamento e as necessidades dos estados e dos municípios e de seus órgãos gestores educacionais, pois o diálogo ocorre diretamente com a escola, independentemente da gestão dos sistemas.

Oliveira (2011) traz outro ponto de vista para essas ações que chegam diretamente à escola, sem a mediação dos órgãos intermediários, ao afirmar que estes buscam promover o desempenho escolar, dentro de uma ótica de fortalecimento da regulação. Sendo assim, o foco deixa de ser pedagógico, de ter como essencial o aprimoramento do processo educacional, passando a ser a busca por atingir e superar um número, a concretização dessa regulação.

Outro aspecto a ser considerado é a determinação, incluída nas normas legais, de se estabelecer o regime de colaboração em matéria educacional entre os entes federados. Apesar de não se ter clareza de como deva ser essa colaboração, o Artigo 211 da Constituição brasileira determina que os sistemas de ensino dos três entes da federação devam atuar em regime de colaboração. O Plano Nacional de Educação (PNE), que estipula as metas decenais para a educação brasileira (Lei 13.005/2014, de 25 de junho de 2014) determina que para a execução das metas instituídas devam ser constituídas instâncias permanentes de negociação, cooperação e pactuação em cada estado (Artigo 7º, § 6º). Dessa forma, a construção pactuada das ações, na área educacional, garantiria minimamente esse regime de colaboração.

Por outro lado, não contribui para o regime de colaboração o governo federal decidir, unilateralmente, medir o desempenho de todos os alunos da rede pública e divulgar os resultados por escola, sem negociar isso com os estados e municípios; da mesma forma, desenvolver materiais com orientações de como a escola deve lidar e o que fazer com os resultados obtidos, também. O Governo Federal nada mais faz do que expor uma situação, sem que esse nível de governo possa desenvolver diretamente qualquer ação para resolver os problemas apontados pelo teste: as professoras são contratadas pelos dois outros entes, que mantêm suas escolas e órgãos gestores; os currículos obedecem à legislação estadual e se relacionam com os projetos pedagógicos de cada escola. Apenas testar os alunos e divulgar os resultados não assegura as condições necessárias para melhorar a qualidade da educação.

Mesmo com suas limitações, o Ideb vem ganhando a cada dia mais destaque tanto na mídia como entre os gestores. Apesar de algumas ações estarem sendo tomadas no sentido de superar algumas das limitações do indicador, essas ações criam uma série de novas situações.

Para superar o problema das ausências dos alunos no dia de aplicação do teste – o que poderia indicar que a escola estaria selecionando apenas os melhores alunos para fazê-lo –, passou-se a exigir a presença de um percentual mínimo dos alunos regularmente matriculados. Iniciativas como essa caracterizam algo que Barroso (2005) definiu como “regulação das regulações” (p.734), na medida em que, dada a complexidade de situações, sempre serão necessárias novas formas de regular uma situação não prevista na regulação anterior. Campbell (1976) já afirmava que “quanto mais se usa um indicador social quantitativo para tomar decisões, mais ele estará sujeito à corrupção e mais ele distorcerá o processo social que se pretende monitorar” (p.49). Assim, apesar de o Inep monitorar a quantidade de alunos que participam do teste, com o objetivo de impedir que se engane o sistema, outras formas podem ser usadas para corromper a medida. A mais comum delas é preparar os alunos para os testes, o que reduz o currículo ensinado àquilo que é exigido no teste, com possíveis efeitos na aprendizagem dos alunos.

Esses fatos, longe de mostrarem que o indicador é inadequado para o que se propõe, revelam que uma série de cuidados deve ser tomada quando da utilização do Ideb como o indicador de qualidade da educação brasileira, deixando-se bem claras suas limitações no momento de sua divulgação.

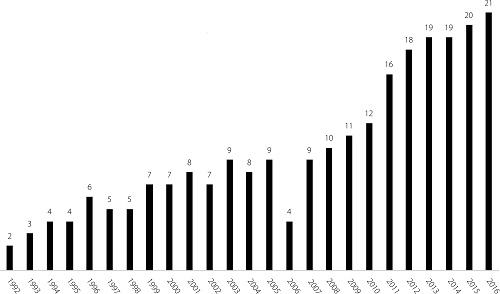

Uma proposta para superar as limitações do SAEB e do IDEB

O movimento em direção aos testes se propaga no Brasil, tanto em nível dos governos estaduais como municipais, e, com ele, cresce a utilização do ranqueamento das escolas – caminho trilhado a partir de três movimentos: identificar as escolas de melhor desempenho, consideradas como exemplos a serem seguidos; divulgar os resultados dos testes, acreditando que as famílias irão pressionar aquelas escolas com baixo desempenho a se superarem; criar competição entre as escolas por desempenhos cada vez melhores, estratégia típica do mundo empresarial em seu afã de eliminar concorrentes. Como consequência dessa propagação, o ranqueamento firma-se como uma necessidade para as políticas e como fator essencial para aprimorar o sistema educacional, levando os governos à utilização ampla dos testes e até mesmo à premição das escolas, professores e alunos (Horta Neto, 2013). No caso dos governos estaduais, esse aumento do uso dos testes pode ser observado na Figura 1, que indica o número de secretarias de educação estaduais que o utilizam.

Figura 1

Quantidade de estados que realizam avaliações próprias, por ano de realização.

Fonte: Horta Neto, Junqueira e Oliveira (2016).

Observa-se, pela Figura 1, que o número de estados que utilizavam sistemas próprios de avaliação entre 1992 e 2007 era relativamente pequeno e variava bastante, muito em função dos jogos políticos locais e dos recursos orçamentários disponíveis. No entanto, depois de 2007, coincidindo com o lançamento do IDEB e da pressão pelo cumprimento das metas estipuladas pelo Inep, vem aumentando progressivamente o número de estados que decidiram instituir sistemas próprios de avaliação. A maioria deles testa Matemática e Leitura, utiliza itens de múltipla escolha e faz uso de Matrizes de Referência semelhantes àquelas do teste federal. Portanto, repetem, em nível local, aquilo que já vem sendo feito em nível federal e também aumentam a frequência de aplicação, que passa a ser anual. Além disso, aplicam seus testes nos meses anteriores à aplicação do teste federal. Esse fato, aliado à utilização do mesmo modelo utilizado pelo Governo Federal, levanta o indício de que os testes estaduais são utilizados com o intuito de preparar os alunos para o teste nacional, já que muito poucas informações diferentes daquelas levantadas de forma censitária pelo Governo Federal podem ser obtidas pelos testes locais, não contribuindo assim para aprimorar as políticas educacionais estaduais.

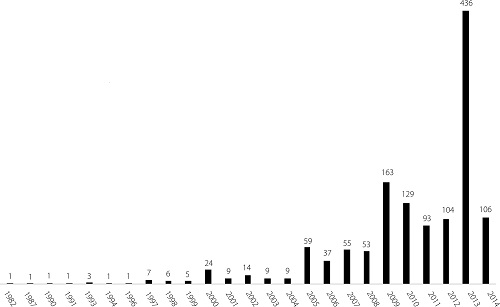

O mesmo movimento de ampliação do número de avaliações pode ser observado em relação aos municípios. Pesquisa conjunta envolvendo a Fundação Carlos Chagas e o INEP, desenvolvida em 2014, utilizou como um de seus instrumentos um survey eletrônico com 44 itens, respondido pelos dirigentes das secretarias municipais de educação de 4.309 municípios, o que equivale a 77% do total de municípios brasileiros (Bauer et al., 2015). A pesquisa tinha como objetivo levantar informações sobre o movimento em torno do uso das avaliações externas pela gestão municipal, fossem elas implantadas pelos próprios municípios, pelos governos estaduais ou pelo Governo Federal.

Um dos itens do Survey perguntava sobre se o município havia instituído uma avaliação externa própria. Do total de respondentes do Survey, 1.573 (37% do total) responderam afirmativamente. Outros 905 municípios (21% do total) responderam que não a possuíam, mas que pretendiam implantá-la. Assim, ao se somarem esses dois casos, chega-se a um expressivo número de 58% dos municípios que possuíam uma avaliação própria ou que pretendiam implantá-la. Destaca-se nesse percentual encontram-se municípios de diferentes tamanhos e com capacidades orçamentárias também distintas. Isso significa que, principalmente para os municípios menores, uma boa parte dos recursos financeiros da educação está sendo direcionada para a construção de testes, em detrimento de outras possíveis necessidades educacionais.

Dentre os 1.593 municípios que afirmaram ter instituído uma avaliação própria, 1.383 indicaram o ano em que ela foi implantada. Com base nesse resultado, foi elaborado o gráfico apresentado na Figura 2.

Figura 2

Quantidade de municípios com avaliação própria e ano em que declaram tê-la instituído

Fonte: Elaborado pelo autor (2017), com base em Bauer et al. (2015).

Analisando-se a Figura 2, observa-se que o movimento de implantação de avaliações externas próprias se acentua a partir de 2009, dois anos depois do lançamento do IDEB; vem crescendo a cada ano e alcança seu ápice em 2013, quando 403 municípios declaram ter iniciado naquele ano sua avaliação.

Dada a pouca capacidade técnica instalada nas secretarias municipais de educação, provavelmente as avaliações municipais devem padecer de limitações técnicas severas. Com isso, é bem provável que nos municípios se estejam repetindo os procedimentos utilizados pelo Governo Federal, inclusive com o uso de itens do SAEB tornados públicos, o que reforça a hipótese de utilização dessas avaliações como forma de preparar os alunos para o SAEB, com o objetivo de melhorar o Ideb dos municípios.

Assim, tudo indica que o aumento nas avaliações nos níveis subnacionais esteja baseado na crença de que o uso das avaliações externas, por si só, seja capaz de garantir a qualidade da educação. Assim, é ainda mais importante rediscutir o papel das avaliações e fazer isso à luz do que preconiza o Plano Nacional de Educação.

O Plano Nacional de Educação, em seu artigo 11, trata do SAEB e determina que devam ser produzidos dois tipos de indicadores: de rendimento escolar e de avaliação institucional. Ao fazer referência a indicadores, o Plano sinaliza para uma multiplicidade de fatores a serem medidos para aquilatar a qualidade educacional, indicando-a como multidimensional e apontando que cada fator por si só é importante para definir uma educação de qualidade. Em certa medida, esse artigo do PNE recupera e amplia os propósitos definidos para o SAEB no final dos anos 1980.

Com base nessas premissas, um grupo de pesquisadores da Diretoria de Avaliação da Educação Básica do Inep realizou uma série de debates com diversos especialistas e instituições durante o ano de 2015 e o início de 2016, os quais deram origem a uma proposta para a constituição do Sistema Nacional de Avaliação da Educação Básica (Sinaeb) (Santos; Horta Neto; Diniz, 2017). O texto, partindo do princípio de que o processo educacional é multidimensional, aponta que é necessário ampliar os instrumentos de medida e construir um conjunto amplo de indicadores que permitam abarcar um espectro maior de dimensões, além do desempenho dos alunos nos testes. A base para a construção da proposta foram as metas definidas pelo PNE. A síntese da proposta está expressa no Quadro 3.

| Diretriz | Dimensão | |

|---|---|---|

| Universalização do atendimento escolar | Acesso e Permanência | |

| Trajetória | ||

| Infraestrutura | ||

| Melhoria da qualidade do aprendizado | Aprendizagens | |

| Práticas Pedagógicas | ||

| Ambiente Educativo | ||

| Formação para o Trabalho e Cidadania | ||

| Valorização dos profissionais da educação | Formação Inicial e Continuada | |

| Carreira e Remuneração | ||

| Satisfação Profissional | ||

| Gestão democrática | Financiamento | |

| Planejamento e Gestão | ||

| Participação | ||

| Superação das desigualdades educacionais | Inclusão e Equidade | |

| Direitos Humanos, Diversidade e Diferença | ||

| Contexto Socioeconômico e Espacial | ||

| Intersetorialidade e Sustentabilidade |

Cada uma das dimensões proposta demanda ainda estudos específicos para o desenvolvimento de instrumentos de medida e o posterior desenvolvimento de indicadores. No entanto, rompe com a lógica de que um processo complexo e multidimensional, como o é o educacional, possa ser medido a partir de um único indicador.

Com base na proposta, o Ministério da Educação editou a Portaria MEC nº 369, de 5 de maio de 2016. Apesar de a Portaria incluir o “Índice de Diferença do Desempenho esperado e verificado”, algo que não fez parte da proposta original, o restante dela foi fiel ao estudo produzido.

Para cuidar das relações entre os diferentes entes da federação e ao mesmo tempo dar transparência ao processo avaliativo, foi previsto um comitê de governança composto por 11 membros, representando estados, municípios, entidades da sociedade civil e comunidade científica, com mandato de dois anos. O comitê teria como objetivo realizar a governança e supervisão do Sinaeb. Dessa forma, seriam discutidos democraticamente tanto a concepção como a aplicação dos instrumentos que fariam parte do Sistema. Além disso, nesse espaço também seria discutido de que forma os resultados das avaliações locais seriam incorporados aos indicadores a serem criados. Assim, a multiplicidade de avaliações existentes poderia ser discutida e utilizada de forma a não reproduzir o que é feito pelo governo federal, mas podendo medir outras competências e habilidades, bem como outras áreas do conhecimento.

Com a troca de governo, depois do processo de impeachment da presidente Dilma, a Portaria anterior foi revogada pela Portaria MEC nº 981, de 28 de agosto de 2016. A justificativa utilizada foi a de que “as revisões da Base Nacional Comum Curricular (BNCC) ainda estão em curso”.

Com isso, perdeu-se uma excelente oportunidade de ampliar o espectro das avaliações.

No entanto, apesar de a justificativa utilizada para barrar o Sinaeb ter sido as revisões da BNCC, o Ministério da Educação publicou a Portaria MEC nº 564, de 20 de abril de 2017, em que ampliou a aplicação do SAEB para todas as escolas de Ensino Médio, inclusive as da rede privada que desejarem participar dos testes e se dispuserem a pagar por isso. Nesse caso específico, amplia-se a avaliação, mesmo que a BNCC para o ensino médio esteja ainda longe de ser finalizada, em contradição com o argumento utilizado para revogar a portaria que instituiu o Sinaeb.

Considerações Finais

Nos últimos tempos, a avaliação se tornou sinônimo de política educacional. E isso é um equívoco tremendo. A avaliação é um instrumento importantíssimo para aprimorar os processos educacionais e políticas públicas da área, mas é apenas um instrumento. Uma política educacional é algo muito mais amplo que isso, envolve uma série de programas, projetos, intersetorialidades e deve apontar de forma inequívoca aonde se quer chegar, e não apenas definir metas de aprendizado, como vem acontecendo desde o primeiro governo Luis Inácio Lula da Silva.

O que se assiste nos anos 2000 no Brasil é uma busca por resultados, na maior parte das vezes, vazios de significado e conteúdo. Resultados educacionais descolados dos processos que os engendraram não podem ser entendidos como algo que faça parte do processo educacional. É preciso avançar e combater aquilo que o pesquisador finlandês Sahlberg (2012) alcunhou de “GERM”, abreviatura de Global Education Reform Movement. Segundo o autor, esse germe tem causado uma epidemia que se espalha e infecta os sistemas de ensino, fazendo com que as escolas fiquem doentes, os professores não se sintam bem e os alunos aprendam menos. Este texto, ao revisar alguns dos estudos que tratam da avaliação educacional, procurou indicar aspectos desse fenômeno no Brasil e apontou saídas para superar o problema.

A proposta do Sinaeb, apontando para as múltiplas dimensões do processo educacional e propondo um conjunto maior de indicadores a partir dos quais se possam fazer juízos de valor sobre a qualidade educacional é uma tentativa de ampliar a discussão para além de um indicador único, como o Ideb. Além disso, busca trazer outros atores para a discussão dos instrumentos que serão utilizados e dos usos de seus resultados, de forma que a avaliação seja realmente nacional, envolvendo toda a nação e seus diferentes atores, e não apenas uma ação do governo federal. Esse nível de governo tem um papel preponderante na melhoria da qualidade da educação básica, que vai além de apenas apontar fracassos ou sucessos a partir de um indicador: tem o dever de liderar um movimento democrático e participativo de discussão de uma verdadeira política educacional.

Referências

Barroso, J. O estado, a educação e a regulação de políticas públicas. Educação e Sociedade, v.26, n.92, p.725-751, 2005.

Bauer, A. et al. Avaliação em larga escala em municípios brasileiros: o que dizem os números? Estudos em Avaliação Educacional, v.26, n.62, p.326-352, 2015.

Brasil. Portaria MEC nº 1.795, de 27 de dezembro de 1994. Cria o Sistema Nacional da Educação Básica. Diário Oficial da União, Brasília, 28 dez. 1994, n.246, Seção 1, p.91-92. Disponível em: <http://pesquisa.in.gov.br/imprensa/jsp/visualiza/index.jsp?jornal=1&pagina=91&data=28/12/1994>. Acesso em: 20 maio 2017.

Brasil. Lei nº 9.394, de 20 de dezembro de 1996. Estabelece as diretrizes e bases da educação nacional. Diário Oficial da União, Brasília, 23 dez. 1996. Seção 1, p.27833-27841.

Brasil. Projeto de Lei do Senado nº 67, de 1992. Estabelece as diretrizes e fixa as bases da educação nacional. Diário do Congresso Nacional, Brasília, 21 maio 1992. Seção 1, p.3702-3727.

Brasil. Projeto de Lei nº 1.258, de 1988. Diário do Congresso Nacional, Brasília, 29 nov. 1988. Seção 1, p.4267-4271.

Campbel, D.T. Assessing the impact of planned social change. [S.I.:s.n.], 1976. Available from: <https://www.globalhivmeinfo.org/CapacityBuilding/Occasional%20Papers/08%20 Assessing%20the%20Impact%20of%20Planned%20 Social%20Change.pdf>. Cited: May 20, 2017.

Duarte, N. Política social: um estudo sobre educação e pobreza. 1996. 253 f. Tese (Doutorado em Política Social) – Universidade de Brasília, Brasília, 2012.

Fernandes, R. A universalização da avaliação e a criação do Ideb: pressupostos e perspectivas. Em Aberto, v.29, n.96, p.177-193, 2017.

Gatti, B.A. Avaliação educacional: pontuando uma história de ações. EccoS. Revista Científica, v.4, n.1, p.17-41, 2002.

Gatti, B.A. Avaliação de sistema educacionais no Brasil. Sísifo: Revista de Ciências da Educação, v.1, n.9, p.7-18, 2009.

Gatti, B.A. Possibilidades e fundamentos de avaliações em larga escala: primórdios e perspectivas. In: Bauer, A.; Gatti, B.A.; Tavares, M.R. (Org.). Vinte e cinco anos de avaliação de sistemas educacionais no Brasil: origens e pressupostos. Florianópolis: Insular, 2013. p.47-69.

Horta Neto, J.L. As avaliações externas e seus efeitos sobre as políticas educacionais: uma análise comparada entre a União e os estados de Minas Gerais e São Paulo. 2013. 358 f. Tese (Doutorado em Política Social) – Universidade de Brasília, Brasília, 2013.

Horta Neto, J.L.; Junqueira, R.D.; Oliveira, A.S. Do Saeb ao Sinaeb: prolongamentos críticos da avaliação da educação básica. Em Aberto, v.29, n.96, p.177-193, 2016.

Intituto Nacional de Estudos e Pesquisas Educacionais Anísio Teixeira. Sistema Nacional de Avaliação da Educação Básica Sinaeb: proposta preliminar. Brasília: Inep, 2016.

Korte, R.C.; Nash, B.E. Review of the Sistema Nacional de Avaliação da Educação Básica (Saeb). Brasília: Inep, 1995.

Oliveira, A.P.M. A Prova Brasil como política de regulação da rede pública do Distrito Federal. 2011. 276 f. Dissertação (Mestrado em Educação) – Universidade de Brasília, Brasília, 2011.

Santos, A.A.; Horta Neto, J.L.; Diniz, R.J. Sistema Nacional de Avaliação da Educação Básica, Sinaeb: proposta para atender ao disposto no Plano Nacional de Educação. PNE em Movimento, 1, n.7, p.1-56, 2017. Disponível em: <https://www.academia.edu/35177789/Sistema_Nacional_de_Avalia%C3% A7%C3%A3o_da_Educa%C3%A7%C3%A3o_B%C3%A1sica_Sinaeb_proposta_para_atender_ao_disposto_no_Plano_Nacional_de_ Educa%C3%A7%C3%A3o>. Acesso em: 18 nov. 2017.

Sahlberg, P. How GERM is infecting schools around the world? [S.I.:s.n.], 2012. Available from: <http://pasisahlberg.com/text-test/>. Cited: May 20, 2017.

Soares, J.F. Índice de Desenvolvimento da Educação Básica de São Paulo (Idesp). Perspectiva, v.23, n.1, p.29-41, 2009.

Soares, J.F. Enem no Ideb? Oportunidade ou manipulação? [S.I.: s.n.], 2012. Disponível em: <http://www.schwartzman.org.br/sitesimon/?p=3855⟨=pt-br&utm_source=feedburner&utm_medium=email&utm_campaign=Feed%3A+SimonsSite+%28Simon%27s+Site%29>. Acesso em: 20 maio 2017.

Vianna, H.M. Avaliação do rendimento de alunos de escolas de 1º grau da rede pública: um estudo em 20 cidades. Educação e Seleção, n.20, p.5-56,1989.

Vianna, H.M. Avaliação do rendimento de alunos de escolas públicas da rede pública: um estudo em 15 capitais e 24 outras cidades. São Paulo: Fundação Carlos Chagas, 1990.

Vianna, H.M. Fundamentos de um programa de avaliação educacional. Brasília: Liber Livro, 2005.

Vianna, H.M.; Gatti, B.A. Avaliação do rendimento de alunos de escolas de 1º grau da rede pública: uma aplicação experimental em 10 cidades. Educação e Seleção, n.17, p.5-52, 1988.

Waiselfisz, J.J.; Horta Neto, J.L. As origens do Saeb. Em Aberto, v.29, n.96, p.177-193, 2016.

Notas